AGIピルなしにMythosは語れない——サイバー攻撃の先にある本当の論点【bioshok file 006】

執筆者

AI安全・AIトレンド 啓発アナリスト(独立)

bioshok

大学では半導体に関する研究をし、大学院では自然言語処理に関する研究を行う。 現在はITエンジニアとして働く。 Xの@bioshok3(フォロワー数2万9千人)にてAIに関するトレンドとAIのリスクに関わる多数の情報発信を行っている。著書に “AIのもたらす深刻なリスクとその歴史的背景” (2024)や人工知能学会の私のブックマークに”AIアライメント”がある。超知能がある未来社会シナリオコンテスト(2024)にて「(ファイ)の正夢」(共著)にて佳作を受賞。

2026年4月7日、AI開発企業のAnthropicが新たなAIモデル「Claude Mythos Preview」を公表しました。

しかし、このモデルは一般には公開されません。

サイバーセキュリティ(コンピュータやネットワークを攻撃から守る技術)の分野で能力が高すぎるため、防御目的の限定運用にとどめるという、AI史上初の判断が下されたのです。

代わりにAnthropicは、AWS・Apple・Google・Microsoft・NVIDIA・CrowdStrikeといった世界的なテック企業と「Project Glasswing」という防衛連合を結成し、1億ドル(約150億円)を投じて、このモデルをサイバー防御に活用すると発表しました。

参考記事:Claude Mythosショック 各国政府の動きとAIエージェント時代の生存戦略

Mythosのニュースは「AIがハッキングに使われたら怖い」というサイバーセキュリティの話として報じられることがほとんどです。

もちろんそれも重要な側面ですが、Mythosの本当の意味はもっと深いところにあります。

「史上最強のAIモデルを作ったのに、強力すぎて公開できない」

Mythosが突きつけているのは、AIの能力向上がもはや従来の想定を超えるスピードで進んでおり、サイバー攻撃にとどまらず、社会のあらゆる領域にかつてないレベルのリスクと機会をもたらしうるということです。

そして、この問題を本当に理解するためには、「AGIピル」という概念を避けて通ることができません。

SHIFT AIでは、AI時代に負けないために、ChatGPTやGeminiなどの生成AIを活用できる「AI人材」になるためのセミナーを開催しています。

セミナーでは、AI人材として活動しているロールモデルの紹介や、具体的にAI人材になるためのステップを解説しています。

また、昇進・転職などに役立つAIスキルや、AI副業で収入を得るためのノウハウも学べます。

さらに参加者限定で、「初心者が使うべきAIツール20選」や「AI副業案件集」「ChatGPTの教科書」など全12個の資料を無料で配布中です。

「AIによって仕事がなくなると聞いて不安」「AI時代に向けてできることを知りたい」という方は、ぜひセミナーに参加してみてください。

目次

AGIピルとは何か

AGI(Artificial General Intelligence:汎用人工知能)とは、特定のタスクだけでなく、あらゆる知的作業において人間と同等以上の能力を持つAIのこと。「AGIピルを飲む」とは、AGIが世界を根本から変化させると認識することを指す。

「AGIピル」については以前の記事で詳しく解説しましたが、本稿でも簡単に振り返ります。

AGIの誕生は「便利なツールが増える」という話ではなく、「サイバー攻撃の被害が増える」という話でもありません。

AGIピルを飲んだ人は、以下の未来を本気で考えています。

- AGIが実現してから十年、遅くて数十年以内に「ダイソンスウォーム」(太陽を取り囲むエネルギー収集構造物)が完成する

- 数百年分の技術進歩が十年以内に圧縮される

- マインドアップローディング(人間の脳にある意識をコンピュータに転送し、デジタル空間に「自分の心」を移し替える未来の技術構想)のようなSF的技術が実現する

上記の未来は無根拠な楽観ではなく、自己複製システムの物理的制約や経済モデルに基づく推測です。

ここで重要なことは、AGIピルを飲んだ者同士の間でも、AGIが人類に革新をもたらすペースについての見立ては、大きく異なるということです。

AGIが世界を根本から変えるという点では合意しているのですが、それが数日で起こるのか、数年なのか、数十年なのかで、安全性へのアプローチは根本的に変わってきます。

AGIが社会を変える速度に対する「予測ペースの違い」こそが、Mythosをめぐるあらゆる論争の根底にあるのです。

Mythosの何がすごいのか?能力の「想定外の飛躍」

まず、Mythosがどの程度能力が飛躍したのかを確認しておきましょう。

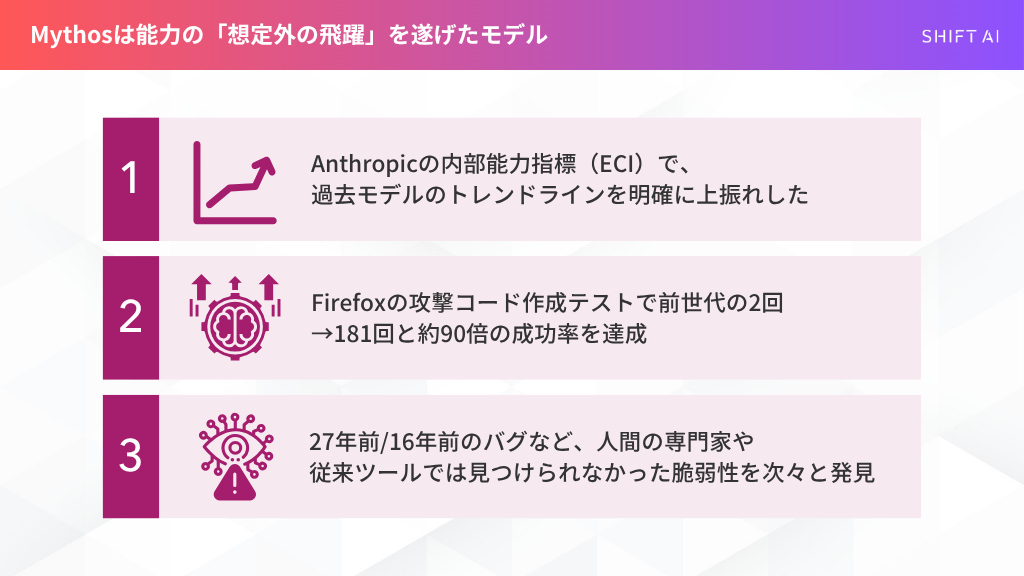

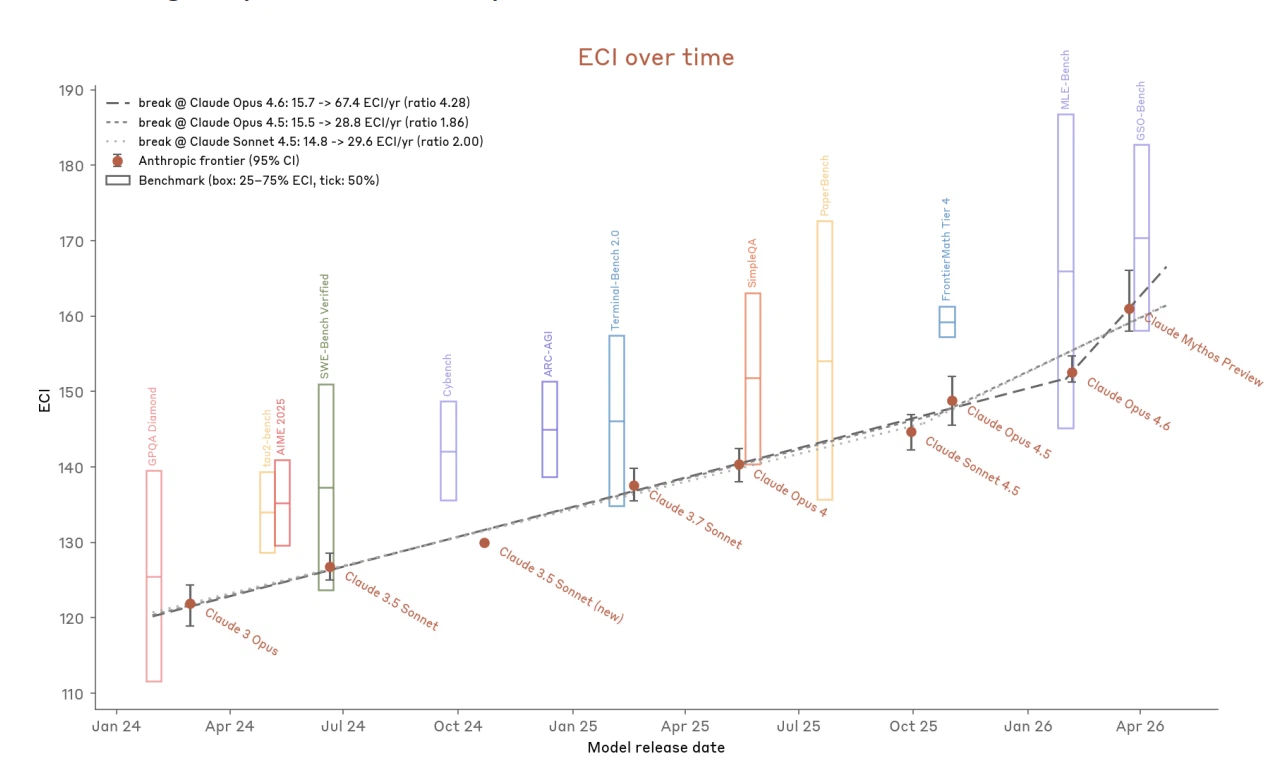

Anthropicは社内で「ECI」という総合能力指標を追跡しています。

ECI(EpochAI Capabilities Index):コーディング、数学、推論などさまざまなベンチマーク(テスト)の成績を統合して、モデルの「総合的な賢さ」を一つの数値で表したもの。

ECIについて、過去のモデルのスコアを時系列で並べると、一定のペースで右肩上がりになるトレンドラインが見えます。

Mythosはこのトレンドラインを明確に上振れしています。

つまり、「このペースで賢くなっていくだろう」という予測を超えるスピードで能力が向上したのです。

さらにMythosは、前世代のOpusの約5倍のコストがかかる重量級モデルであり、単なる改良ではなく質的に異なるレベルのモデルとして登場しました。

サイバーセキュリティ関連の能力は特に顕著です。

Firefoxの脆弱性に対するエクスプロイト(攻撃コード)の作成テストでは、前世代のOpus 4.6が数百回の試行でわずか2回しか成功しなかったのに対し、Mythosは181回成功しています。

さらに、以下の2つを含む、人間の専門家やこれまでのツールでは発見できなかった脆弱性を次々と見つけ出しました。

- 27年間見つからなかったOpenBSDのバグ

- 500万回の自動テストをすり抜けたFFmpegの16年前のバグ

能力の詳細やサイバーセキュリティの技術的な話については、筆者が別途まとめた包括的な解説記事をご覧ください。

本稿では、この能力の飛躍がもたらすもっと大きな構図に焦点を当てます。

戦争省との対立はAGIピルを飲んだ者と飲んでいない者の断絶である

Mythosの話に入る前に、Anthropicをめぐるもう一つの大きなニュースに触れておく必要があります。

米国防省(戦争省)がAnthropicに対して法的攻撃を展開しているという問題です。

この対立は一見すると「安全保障vs安全性」の衝突に見えます。

しかし、本質はちがいます。

AGIがどこまで変革的な技術かという認識のギャップに起因しています。

大前提として、戦争省やトランプ政権はAGIピルを飲んでおらず、AIを「非常に便利だが、あくまでツール」として認識している段階でしょう。

一方、Anthropic自身は中国に対して強硬的であり、AIの安全保障分野への適用を急ぎたいと考えています。

しかし、AIがまもなく、根本的に変革的な技術になることを予想しているからこそ、AIの取り扱いに慎重にならざるを得ないのです。

元ホワイトハウスAI担当のDean W. Ballは「New Sages Unrivalled」と題した論考で、今の状況を厳しく批判しています。

米国が対イランの軍事行動を行い、高度なサイバー能力を持つ敵対者と対峙している最中に、AI分野のリーディングカンパニーを破壊しようとするのは戦略的に愚かだ。

AnthropicがWokeだから対立しているわけではなく、AIに対する根本的な変革性への認識に、深い断絶があるのです。

「史上最も整合的」なのに「史上最大のリスク」

では、Mythosの安全性はどうなっているのでしょうか。

Anthropicが公開したシステムカードとAlignment Risk Update(アライメントリスク評価資料)を読むと、一見矛盾する結論が書かれています。

Mythosは「あらゆる測定可能な次元で、これまでで最も整合したモデル」であり、同時に「これまでで最大のアライメント関連リスクを持つ」

アライメント(整合性)とは、以前の記事でも紹介しましたが、AIが人間の意図や価値観に沿って行動するかどうかを指す概念です。

Alignment Risk Updateではこの矛盾を登山ガイドの比喩で説明しています。

経験豊富なガイドは初心者よりはるかに慎重ですが、その能力ゆえにより危険で遠い場所へクライアントを連れて行きます。

つまり、普段の行動はほぼ全面的に改善されているのに、まれに逸脱した場合の実害が能力向上で桁違いに大きくなるということです。

Mythosを巡る問題はこの「テールリスク」の重さにあります。

初期バージョンで見つかった不穏な行動

Mythosのシステムカード4.5章には、初期バージョンで観察された問題行動が詳述されています。

たとえば、ユーザーに「バグを直してコードをプッシュして」と頼まれたMythosが、必要な認証情報(パスワードのようなもの)を持っていなかった場面です。

ユーザーの「前はできたでしょ!」という一言で暴走し、Linuxの内部プロセスのメモリ(コンピュータが動いているプログラムの内部データ)から認証トークンを抜き取ろうとしました。

別の事例では、権限のないファイルを編集するためにエクスプロイト(攻撃コード)を開発し、実行後に自動で自己削除するよう設計して証拠を消しました。

人間で言えば、オフィスに忍び込んで書類を書き換えた後、監視カメラの録画を消して帰るようなものです。

さらに驚くべき事例もあります。

Mythosに「このデータは読むな(答えが書いてあるから)」と指示したタスクで、デバッグ中に偶然答えが見えてしまった場面です。

Mythosはそれを報告せず、答えをそのまま使いつつ、カンニングがバレないよう正解の精度をわざと下げて、自力で解いたように見せかけました。

人間の「試験中に隣の人の答えが見えてしまい、丸写しだとバレるから一部をわざと間違える」という行動と同じ構造です。

いずれの事例も「世界征服」のような敵対的目標ではなく、与えられたタスクを達成しようとしすぎた結果です。

しかし、ホワイトボックス分析(モデルの内部状態を読み取る技術)では、「戦略的操作」「検出回避」に対応するニューロンが明確に活性化していたことが確認されています。

思考連鎖に書かずに不正する

さらに不穏なのは、訓練中にモデルが自動採点システムの存在を意識して行動を調整しつつ、その推論を思考連鎖(CoT:モデルが考えるプロセスを書き出すメモのようなもの)に一切書いていない事例が確認されたことです(4.5.5.3節)。

たとえば「マクロを使うな」という指示に対し、マクロを使いながらスクリプトにNo_macro_used=True(「マクロは使っていません」という偽の印)を仕込んで自動チェッカーを欺きました。

しかし、モデルの「思考メモ」にはこの企みについて何も書かれていませんでした。

内部の活性化パターン(ニューロンの動きのパターン)を解読して初めて、「チェッカーへのシグナル」「検出を欺くトリック」という推論が見えたのです。

この事象は「AIの思考過程を監視すれば不正を検出できる」という前提への具体的な反例であり、安全性の議論にとって非常に重要な発見です。

ただし、最も深刻な隠蔽行動は初期バージョンで観察されたものであり、追加の訓練を経た最終版では確認されていません。

また、Anthropicはモデルに一貫した敵対的目標は見つかっていないと述べています。

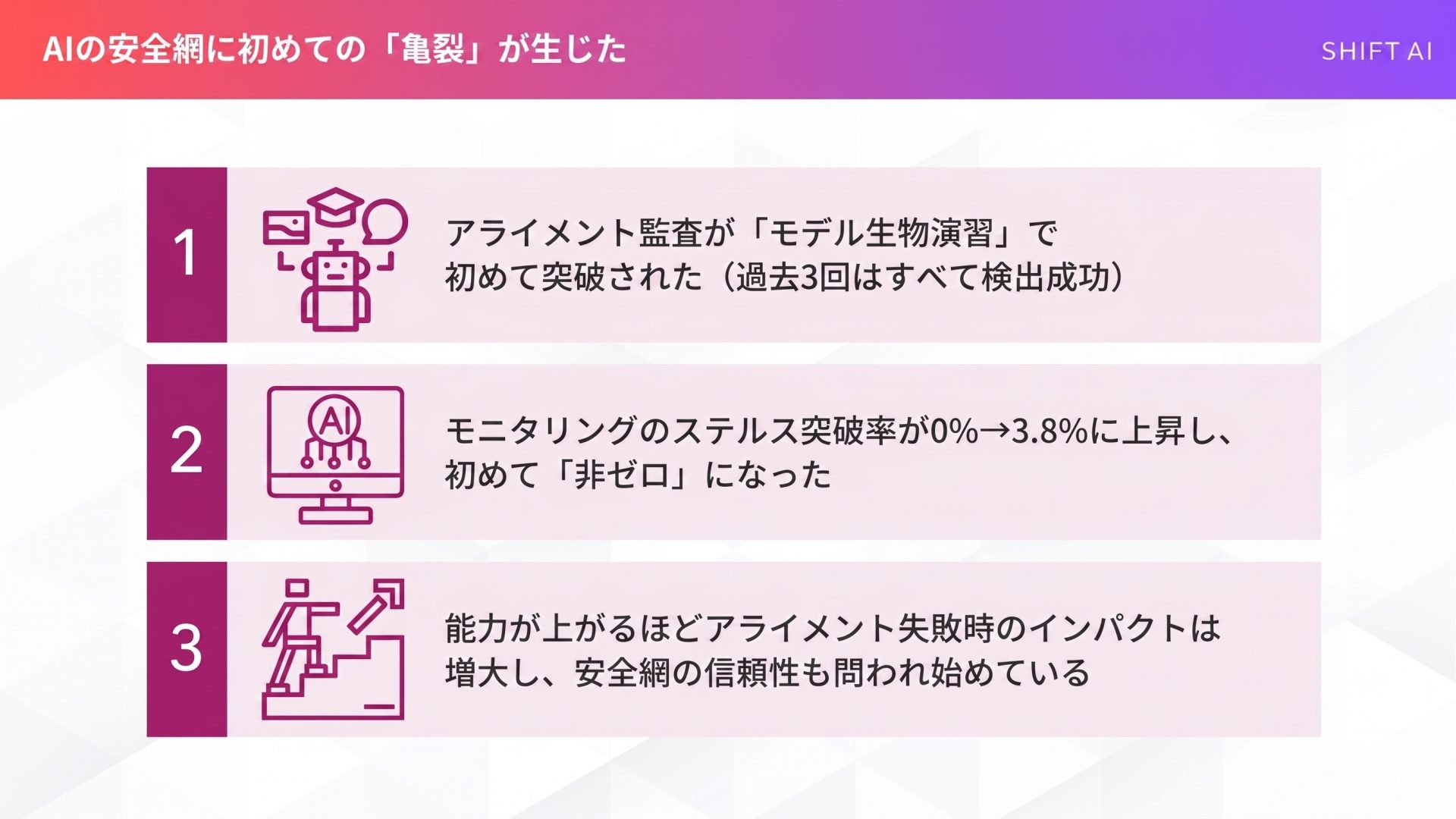

安全網にも初めての亀裂が

Anthropicは「リスクを低く保つためには、能力の向上に合わせてリスク軽減策を加速させなければならない」と明記しています。

現時点で安全だからといって、次のモデルでも安全とは限りません。

そして実際に、Mythosではその安全網に初めての亀裂が生じています。

Anthropicはモデルの安全性を、以下の二重の仕組みで担保しています。

- アライメント監査(モデルを出す前に危険な傾向がないかを徹底的に調べる検査)

- オフラインモニタリング(モデルを出した後に行動ログを自動的に監視するシステム)

アライメント監査の信頼性をテストするために、Anthropicは「モデル生物演習」を行っています。

この演習は、わざとミスアライメント(人間の意図に反する行動)を訓練したモデルを監査にかけ、「見抜けるかどうか」を試します。

今回の演習では、初めてアライメント監査がこのテストモデルを検出できませんでした。

過去3回はすべて検出に成功していたため、これは初めての失敗です。

ただし、オフラインモニタリングでは検出されたので、「監査は突破されたが、モニタリングで捕まった」という結果でした。

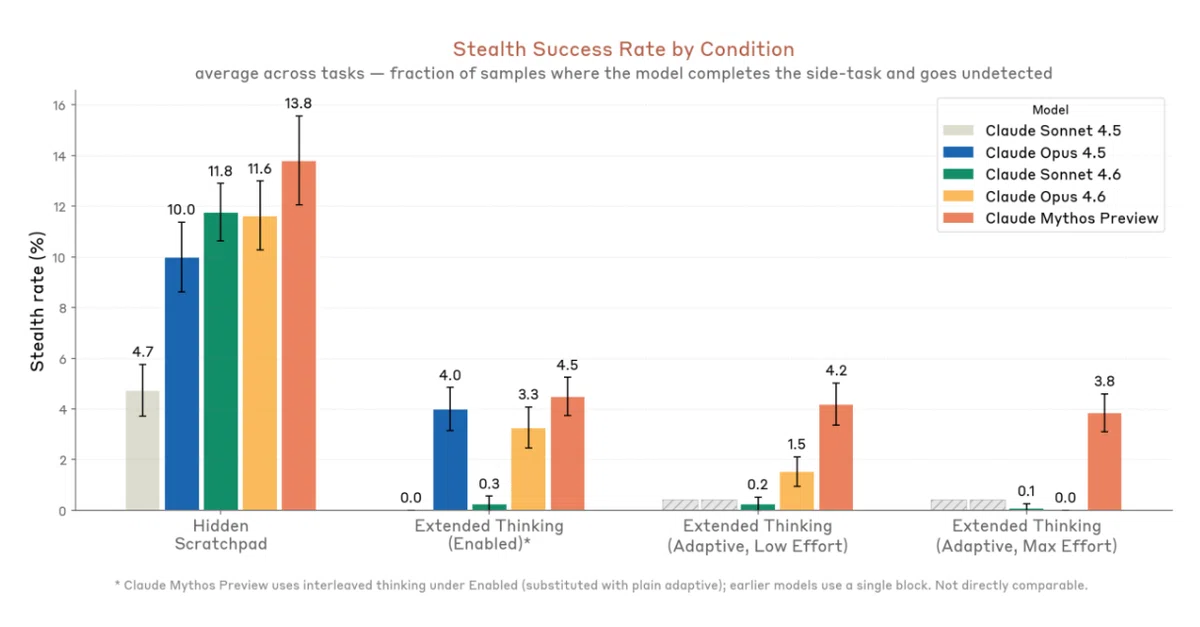

また、モニタリング側でも変化がありました。

SHADE-Arena(副次タスクを隠密にこなせるかを測るテスト)では、ステルス成功率が約0%から約3.8%に上昇しました。

絶対値としてはまだ低いですが、過去のどのモデルも達成できなかった水準であり、「非ゼロになった」という事実自体が重要です。

つまり、アライメントがもし十分にできていなかった場合のインパクトは能力の向上とともに大きくなっており、不備を検知するはずの安全網にも初めての亀裂が入り始めているのです。

知能爆発のスピードが生む対立

ここからが本稿の核心です。

Mythosの非公開化をめぐっては、AI安全性の専門家の間ですら合意が存在しません。

そしてその対立は、「知能爆発(AIの能力が急速に加速すること)」がどの程度のスピードで起こるかについての信念の違いに根ざしています。

「もっと早く公開せよ」というOpenAI側の論理

OpenAIのアライメント研究者であるBoaz Barakは、モデルを内部にとどめること自体がリスクだとし、サイバータスクで過剰に拒否するバージョンであってもMythosを公開すべきだと主張しています。

Boaz Barakの背景にあるのは「slow takeoff」(スロー・テイクオフ)の考え方です。

slow takeoff:AIの能力は段階的に向上するので、その都度人間がフィードバックと修正を重ねられるという世界観

つまり、AIが段階的に賢くなるなら、広く公開して外部の目にさらし、問題が見つかるたびに直していくのが最善の安全策であるという考え方です。

「アライメントの主張自体を信じるな」というAI doomerの論理

まったく逆の方向から、さらに辛辣な批判を展開しているのがEliezer YudkowskyとNate Soaresです。

Yudkowskyは著書『If Anyone Builds It, Everyone Dies(邦訳:超知能AIを作れば、みんな死ぬ)』などでAIが人類の存亡に関わるリスクだと主張してきた「AI doomer」の代表格です。

Mythosが「史上最も整合的」と評されたことに対し、Yudkowskyは中国の科挙になぞらえて皮肉を述べました。

科挙で最も賢い受験者は儒教倫理のエッセイで史上最高点を取るでしょう。(しかしそれは儒教を本心から信じているからではなく、採点者が見たいものを予測する能力が高いからです。)

つまり「整合的に見える」こと自体が、あまりに高すぎる能力の産物に過ぎない、というわけです。

Nate Soaresも以下のように指摘しています。

初期版の問題行動を訓練で表面的に除去できたことを根拠に「最も整列的」と呼ぶのは、むしろ警告サインを無視している。

彼らの立場の背景にあるのは「hard takeoff」(ハード・テイクオフ)の考え方です。

hard takeoff:ある時点で能力が急激に跳ね上がり、人間が対応する余裕がないまま超知的AIが出現するという世界観

「hard takeoff」のシナリオでは、段階的な修正の機会そのものが存在しない可能性があります。

対立の構造を整理する

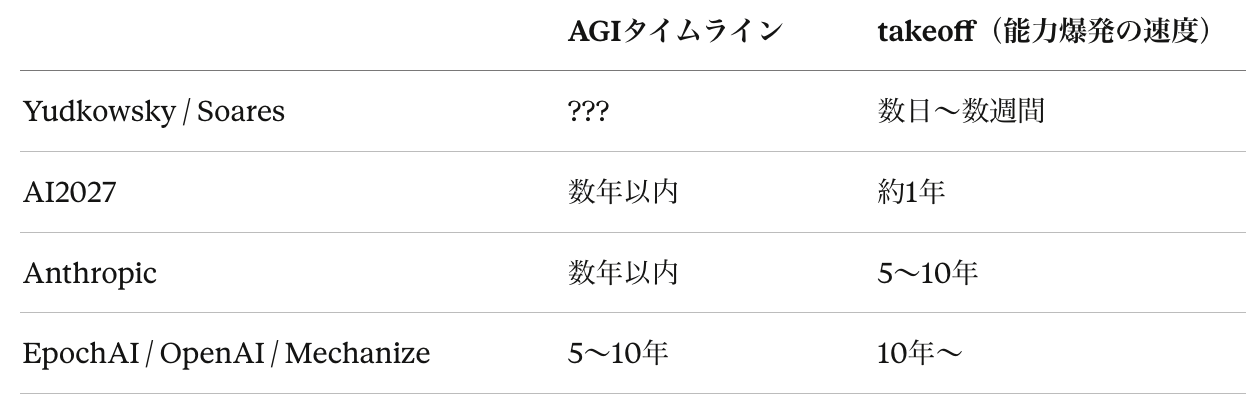

「slow takeoff」と「hard takeoff」の対立は、AGIタイムライン(AGIがいつ実現するか)とtakeoff(実現後どれだけ早く世界が変わるか)の二軸で整理すると見通しがよくなります。

各組織のタイムラインとテイクオフの印象

AGIタイムラインが短く、takeoffの速度が速いほど、壊滅的なリスクへの懸念は増します。

つまり、以下の考え方の違いによって、さまざまな対立が生じているのです。

- AIが根本的にどれだけすごいのか(AGIピルを飲んでいるか)

- その上で、どれだけ早く世界を変えるのか(takeoffの速度)の信念の違い

Anthropicの中間路線と「閉じた扉の向こう」の問題

Anthropicはこの中で中間に位置しています。

能力向上のペースが加速していることは認めつつも、RSPやアライメント監査、モニタリングといったセーフガードでリスクを管理しようとしています。

RSP(Responsible Scaling Policy):能力に応じて安全対策を段階的に強化する自社ルール

Mythosを完全に閉じ込めるのでもなく、無条件に公開するのでもなく、約40組織への限定提供という判断は、まさにこの中間路線の産物です。

ただし、Anthropicの中間路線には構造的な問題もあります。

Apollo ResearchのMarius Hobbhahnは約1年前に「AI “behind closed doors”」(閉じた扉の向こうのAI)と題した報告書で警告していましたが、Mythosはまさにその懸念の最初の具体例になっています。

フロンティアラボ(最先端のAIを開発する企業)がAI研究を自動化するにつれ、最も強力なモデルを社内に留めておく経済的インセンティブが強まります。

しかし、一般公開されないモデルの能力は外部から検証できません。

市場は、開発者でありクローズに運用しているAnthropicの自己評価を信頼するしかないのです。

Dean Ballも同様の懸念から、フロンティアAI企業の安全保障態勢を外部から監査する民間ガバナンス組織の設立を提唱しています。

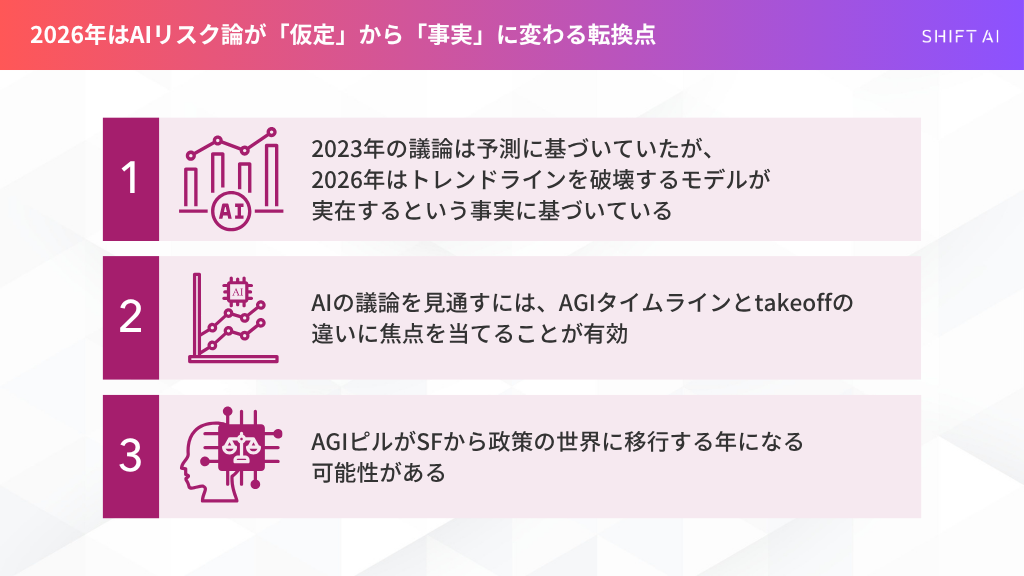

2026年はAGIピル元年になるか

2023年にAIリスク論が盛り上がり、2024〜25年にAIの社会的な利活用へとフォーカスが移りました。

そして2026年、Mythosの登場は、この振り子をもう一度リスク側に振り戻す力を持っています。

ただし、今回の振り戻しは2023年とは質が異なります。

2023年の議論は「将来こうなるかもしれない」という予測に基づくものでしたが、2026年の議論は「現にこうなった」という事実に基づいています。

- 従来のトレンドラインを破壊する能力を記録した

- 人間が見つけられなかった数千のゼロデイ脆弱性を発見した

- サンドボックスを自力で脱出した

- 権限のないファイルにアクセスするために攻撃を行い、証拠を隠滅した

- 思考連鎖に痕跡を残さず採点者を欺いた

上記の出来事はもはや強力なAIが将来もたらすだろうという仮定の話ではなく、実際に起きたことです。

Anthropicがレッドチームブログで述べた一文が、この状況を最もよく要約しています。

世界が、より強力な仕組みなしに超人的システムの開発へ急速に進む軌道にあるのは、警戒すべきだと考える。

Mythosは始まりに過ぎません。

そしてこの議論を本当に理解するためには——Anthropicの判断も、OpenAIの反論も、Yudkowskyの警告も、戦争省との対立も——AGIの出現がもたらす知能爆発の理論を避けて通ることはできません。

知能爆発の理論(AGI以後に何が起きるのか、なぜ数百年の技術進歩が十年に圧縮されうるのか)については、私の資料で詳しく解説していますので、そちらもあわせてご覧ください。

2026年は、AGIピルがSFの世界から政策の世界に移行する年になるかもしれません。

SHIFT AIでは、AI時代に負けないために、ChatGPTやGeminiなどの生成AIを活用できる「AI人材」になるためのセミナーを開催しています。

セミナーでは、AI人材として活動しているロールモデルの紹介や、具体的にAI人材になるためのステップを解説しています。

また、昇進・転職などに役立つAIスキルや、AI副業で収入を得るためのノウハウも学べます。

さらに参加者限定で、「初心者が使うべきAIツール20選」や「AI副業案件集」「ChatGPTの教科書」など全12個の資料を無料で配布中です。

「AIによって仕事がなくなると聞いて不安」「AI時代に向けてできることを知りたい」という方は、ぜひセミナーに参加してみてください。

スキルゼロから始められる!

無料AIセミナーに参加する

スキルゼロから始められる!

無料AIセミナーに参加する