AGIピルとは何か【bioshok file 005】

執筆者

AI安全・AIトレンド 啓発アナリスト(独立)

bioshok

大学では半導体に関する研究をし、大学院では自然言語処理に関する研究を行う。 現在はITエンジニアとして働く。 Xの@bioshok3(フォロワー数2万9千人)にてAIに関するトレンドとAIのリスクに関わる多数の情報発信を行っている。著書に “AIのもたらす深刻なリスクとその歴史的背景” (2024)や人工知能学会の私のブックマークに”AIアライメント”がある。超知能がある未来社会シナリオコンテスト(2024)にて「(ファイ)の正夢」(共著)にて佳作を受賞。

今「AGIピル」を飲んだ人たちによる、急峻に変わる世界の未来シナリオが現実味を帯びつつあります。

早ければ2027年、遅くとも2030年代前半までに、あらゆる人間よりも賢いAIシステムが開発され、その後数年以内に超知能へと進化し、人類全体の知性を凌駕していく。

同時に、AGI/超知能を巡る米中競争が激化し、台湾有事や第三次世界大戦のリスクが高まる。軍拡/経済競争の中でAGIが制御不能になり得て、さらにオープンウェイトAGIの悪用によって世界はかつてない脆弱性を抱えることになる。

しかし、そのすべてを乗り越えた先には、狩猟採集時代から現代への変化と同じような人類史の変革が短期間で訪れ、不死、マインドアップロード、エネルギー問題の解決、そして多惑星間種族への飛躍が待っている。

AGI/超知能は人類を「文字通り」滅ぼすのか、それとも繁栄へと導くのか――。

あまりAI動向を毎日追っていない人からすると、「そんなSFっぽいことが起きるはずがない」と感じられる方も多いかもしれません。

しかし、実際はこのナラティブがここ数年、一部テクノロジー界隈を中心に急速に広がりつつあります。

そして、早ければわずか数年で始まる、このようなSF的な未来観を信じることを 「AGIピルを飲む(AGI pilled)」 と呼びます。

この呼び方は、シリコンバレーのテック界隈で使われる非公式なスラングです。

今回は、AGIピルを飲んだ人たちが今後の未来をどう考えているのか、解説していきます。

SHIFT AIでは、ChatGPTやGeminiなどの生成AIを活用した、昇進・転職などに役立つスキルを学べるセミナーを開催しています。

また、参加者限定で、「最新AI情報キャッチアップガイド」「実務で役立つ生成AI時短術」「新時代のAI×デザイン活用ガイド」など、全12個の資料を無料で配布しています。

「これからAIを学び始めたい」「AIを使って本業・副業を効率化したい」という方は、という方は、ぜひ以下のボタンからセミナーに参加してみてください。

目次

もうすぐ実現する可能性のあるAGI

現在の激しいAIトレンドの背景には、OpenAIやAnthropicなどのフロンティアAI研究開発機関の関係者が、「AGI」の実現が近いと考えているという事実があります。

AGI(Artificial General Intelligence: 汎用人工知能)

AGIとは、大雑把に言えば 「人間が行うあらゆる認知タスクを、コストパフォーマンス良く実行可能なAIシステム」 のことを指します。

定義上、科学者、企業のCEO、トラックドライバーといった職業の仕事も含め、あらゆるタスクを遂行できるAIということです。

早ければ数年以内のAGI実現による、以下のような世界の急激な変化の可能性を本気で考えることを、英語圏で「AGI pilled(AGIピル)」と呼んでいるのです。

- 短期間での世界安全保障体制の変化

- 存亡リスクの高まり

- 不老技術

- 経済成長の極端な爆発

- 宇宙文明への進化等

たとえば、OpenAI CEOのSam Altmanは、以下のように述べ、AGIの構築方法を我々は把握できたと自信を覗かせています。

数年以内に自分自身よりも賢いAIシステムが開発され、自律的に大きな(科学的)発見が行われる。

そして最近は、2028年にはAGIが存在する世界になるとも発言しています。

また、Anthropic CEOのDario Amodeiは以下のように述べています。

ほぼすべての人間よりも賢いAIが2026/27年までに開発される可能性が高く、数百万台のGPU上で稼働する「データセンター内の天才たちの国」が誕生する。

GoogleDeepMindのCEOのDemis Hassabisも、上記二人よりは少し遅いですが、「AGIは今後5~8年で実現可能だ」と述べました。

また、バイデン元大統領の国家安全保障補佐官は以下のように述べています。

今後数年間で、人工知能が大惨事をもたらすかどうか、そしてAI軍拡競争で中国とアメリカのどちらが勝利するかが決まるだろう。

元AI特別顧問も以下のように述べています。

私は、驚異的に高性能なAIシステムが登場すると考えています。私は”汎用人工知能(AGI)”という言葉があまり好きではありませんが、それが適用されるようなAIが今後数年以内に登場するでしょう。

このように、多くの人物が、「もしAGIが実現すれば、産業や技術の発展は根本から変革される」と予想しています。

さらに、アメリカのGDP成長率が現在の数%から、有史以来前代未聞の25%以上になるというレポートも出ています。

上記に加え、以下のような可能性も指摘されています。

- 科学的発見の速度は少なくとも10倍になる

- 今後10年で100年分の進歩が起こる

- 「圧縮された21世紀」と呼ばれる時期が到来する

- ほとんどあらゆる病気が治療され、寿命が150歳以上になる

識者の中には、以下のように分析する者もいます。

直感的には信じられないような物理世界における急激な変化が発生し、AGI以後わずか10年程度でカルダシェフスケールタイプ1文明(現在の人類のエネルギー消費量の1000倍を消費する文明)に到達することは最もらしい。

一方で、AGIのような超人的なAIシステムが開発されると、人類の絶滅といったような極端なリスク、「存亡リスク」も指摘されています。

AGIピルを理解する4つのエッセイ

AGIピルの世界観を理解できる4つのエッセイがあり、紹介したいと思います。

どれもこの数年で描かれたもので、近年のAGIピル世界観の根拠になっていると言えるでしょう。

Situiational Awareness

1つ目は「なぜAIの性能が今のタイミングで高くなっているか」を明確に説明する「Situiational Awareness」と呼ばれるエッセイです。

このエッセイは、2024年6月に元OpenAIのLeopold Aschennbrenerによって書かれました。

エッセイでは、2027年までにAGI、2028/29年までに超知能が開発される理由が説明されています。

さらに、以下のシナリオが赤裸々に、主に国家安全保障というリスクを強調したエッセイが記されています。

- AGI誕生後、人類史上類を見ない経済成長の相転移(GDP30%以上)と国家間の緊張の急激な高まりに突如突入する

- AGI誕生により、国家安全保障を中心に文字通り、「人類史が変わる」

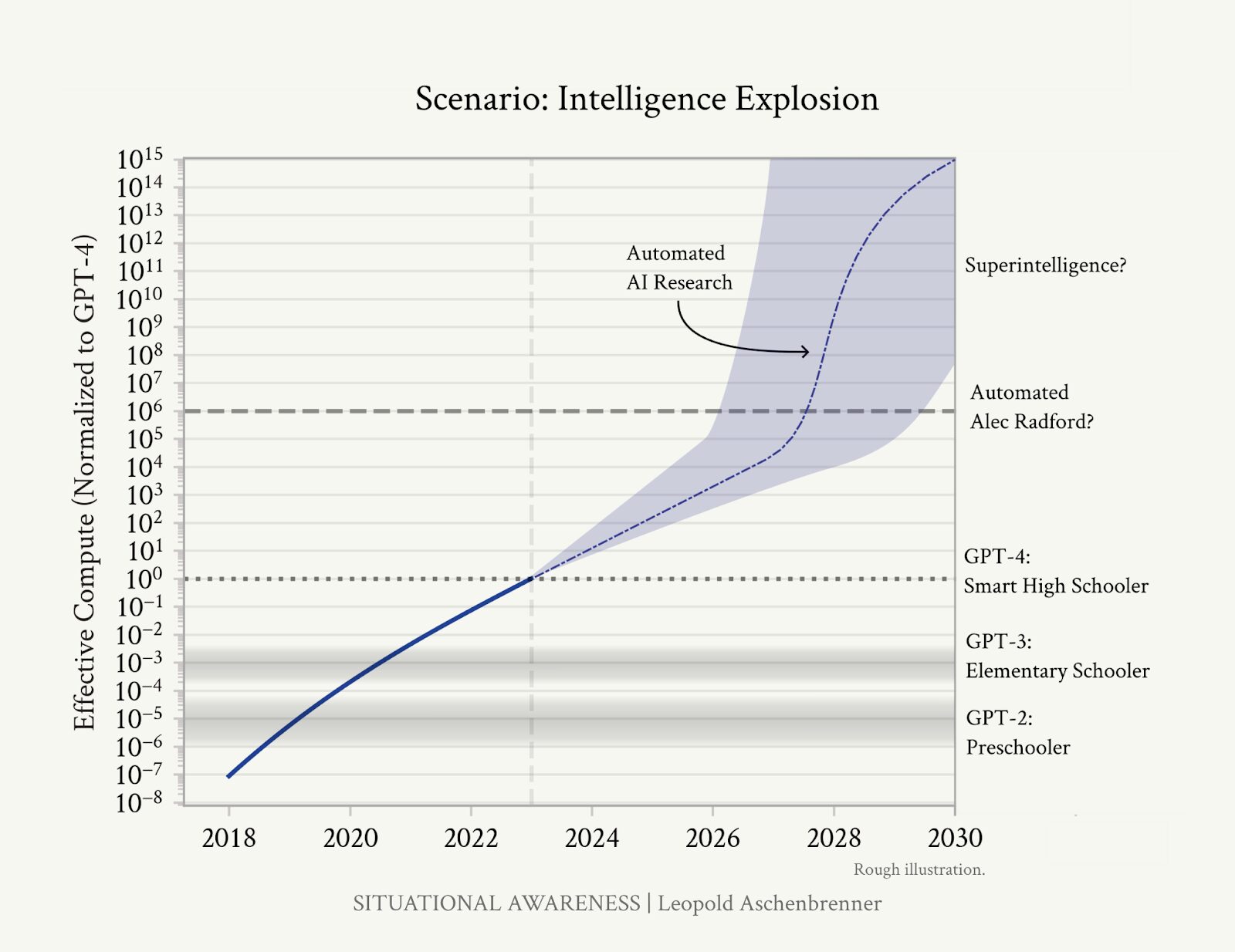

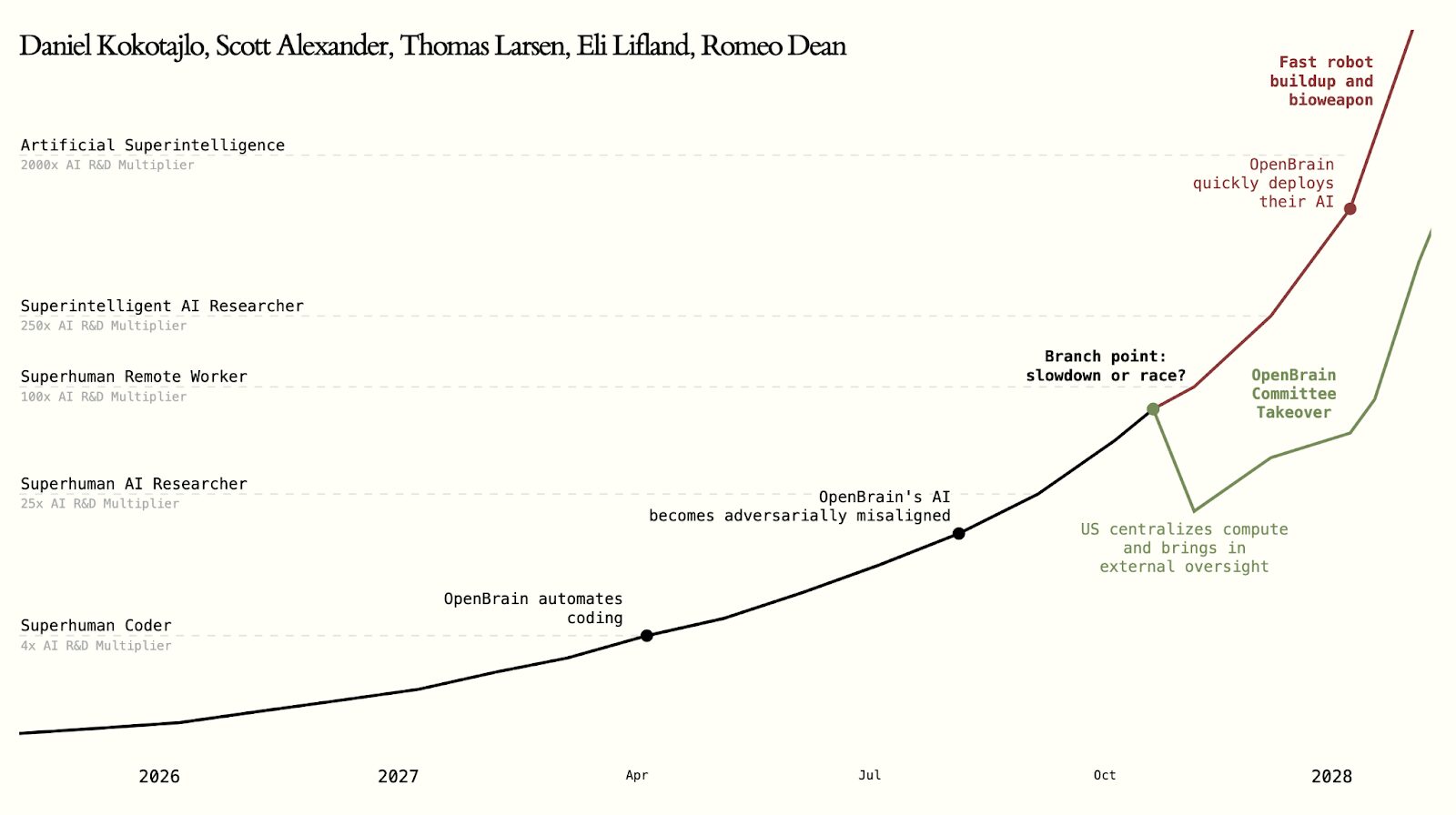

このエッセイの鍵となる図が以下です。

横軸が年代で、縦軸が性能≒実効計算量(Effective Compute)と言われるものです。

このエッセイにおける「実効計算量」は、AIシステムのトレーニングに使用される計算量を純粋なハードウェアのみならず、アルゴリズムの改善も考慮し、実効的な値に換算したものです。

たとえば、アルゴリズムのAIシステムの改善が1OOMs(orders of magnitude)=10倍あれば、10倍少ない純粋なハードウェアの計算量で同等の元のAIシステムの性能に達するとする、大まかな指標です。

エッセイでは、以下のように予想されています。

- 2027年末までにGPT-4の10^6(100万)倍の実効計算量がAIトレーニングに投入される

- AI研究の自動化(Automated AI Research)が可能になるレベルになる

上記の予想は、大体今までGPT-2からGPT-4への性能飛躍が10^6程度あったため、GPT-4から再びその飛躍があったら相当賢いAIができるのではないか?という直感的な類推からきています。

その後、2027年末頃に、AI研究を自動化するAIが自己改善を急速に行い、わずか1-2年で小学生(Elementary Schooler)と天才的なAI研究者(Alec Radford:GPTシリーズの基礎を築いたAI研究者)の知能差と同等にまで拡大します。

つまり、人類最高のAI研究者と超知能の間に、「小学生と天才の差と同様の知能格差が生じる可能性がある」と、このエッセイは生々しく説明しており、AGIピルの理論的支柱になっていると言えるでしょう。

またSituational Awarenessは、AGIや超知能開発を「20世紀の核開発競争におけるマンハッタン計画並の覚悟を持って国家が推進するべき理由」も克明に説明しており、安全保障上のリスクが中心に警告されています。

Machines of Loving grace

2つ目のエッセイは、2024年10月に出されたAnthropicのCEO Dario Amodeiによる「Machines of Loving grace」です。

AGIピルの世界観における「ユートピア的」な側面を描いたエッセイと言えるでしょう。

具体的には、以下の予想が記されています。

- 数年以内に強力なAI(≒AGI)が開発される

- 僅か5~10年で人間の寿命は150歳、望めば半永久的に生きられる

- 精神疾患のほとんどが治癒できる

- 体重外見を制御できる

- 世界の最貧国にまで健康上の利点が急速に広がる

- 殆どの感染症、癌を撲滅し、アルツハイマーも予防できる

強力なAIが何百万台のGPUで稼働するデータセンターを「データセンターにいる天才達の国」と比喩し、このデータセンターがもたらすインパクトは、21世紀の50-100年の生物医学の進歩を5~10年に圧縮すると予想しています。

楽観的な予想だけでなく、実験の遅れ、官僚機構の遅さなどに対する対策も詳述されています。

エッセイではあくまで、以下のようなAIリスクを回避できた場合に、強力なAIがもたらす想像を絶するメリットをあえて詳細に推測している、と言えるでしょう。

- AI技術の悪用

- 固定した価値観によるハレーション

- ミスアライメント

- 戦争のエスカレーション等

1つ目で紹介した、国家安全保障のリスクを予測するLeopold Aschenbrennerのエッセイとは対照的で、このエッセイは慎重ながらも大きな希望に満ちています。

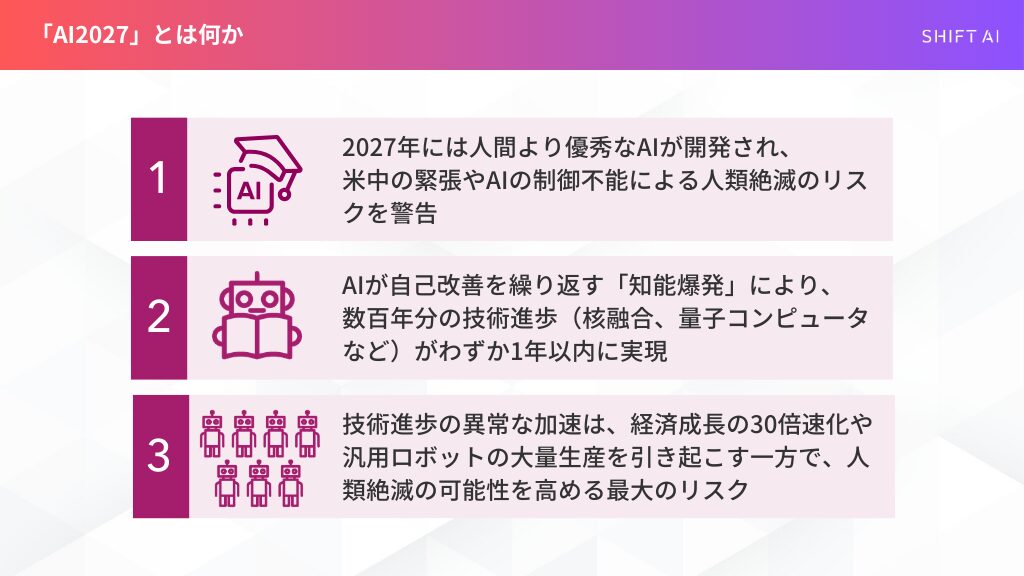

AI 2027

3つ目に、AI予測シナリオレポート「AI 2027」です。

2025年4月に元OpenAIのDaniel Kokotajloらによって出されました。

AI2027では、1つ目で紹介した「Situational Awarenessが実際に起こったらどうなるか?」を物語形式で読めるように描かれており、「AGIピル」的な世界観を理解するのにおすすめです。

AI 2027では、計算資源をスケーリングしていき、AI自身がAI研究できるように学習を推し進めることで、AI研究がどんどん加速していきます。

初期はAIはバブルかもしれないといった懐疑的な意見が大半だったのが、2026年になるとAIは次の革命だという意見が大半になり、2027年になると人間よりも優秀なAIが開発され、アメリカ政府も騒然とします。

米中の緊張も高まる中、以下の2つのシナリオに分岐します。

- AIが制御不可能になり人類が絶滅するシナリオ

- 一時的に停止してAIのアライメントに成功するシナリオ

特に注目するべきは、「AIが再帰的に自分自身を改善することで、賢くなれる上限まで急速に知能が高まってしまう点」です。

このように、AI自身によって限界まで賢くなることを「知能爆発」といいます。

知能爆発が起きると、AI2027では「数百年千年分の技術進歩がたった1年以内に起こってしまう」と想定されています。

読者の皆さんもSF用語として聞いたことのあるかもしれませんが、以下のような技術が1年で急速に開発されていくのです。

- 核融合技術

- 量子コンピュータ技術

- ナノマシン

- マインドアップローディング

また技術だけではなく、産業の拡大スピードも異常なほど速くなっていきます。

1年以内に、1ヶ月で100万台の汎用ロボットが生産されるようになり、経済成長のスピードも30倍速くなっています。

知能爆発の中で、複雑な実験設備を必要とする科学技術への投資が起こりつつ、技術発展もさらに加速していきます。

一方で、知能爆発が急峻に起こることで、人類の絶滅も起こりやすくなり得ると言えるでしょう。

1つ目のSituational Awarenessが国家安全保障上のリスクを警鐘しているとしたら、AI 2027は人類の絶滅という最大のリスクとそれを回避した場合の、莫大なSF的ユートピアが実際に起こる蓋然性が高いと思わせるエッセイになっています。

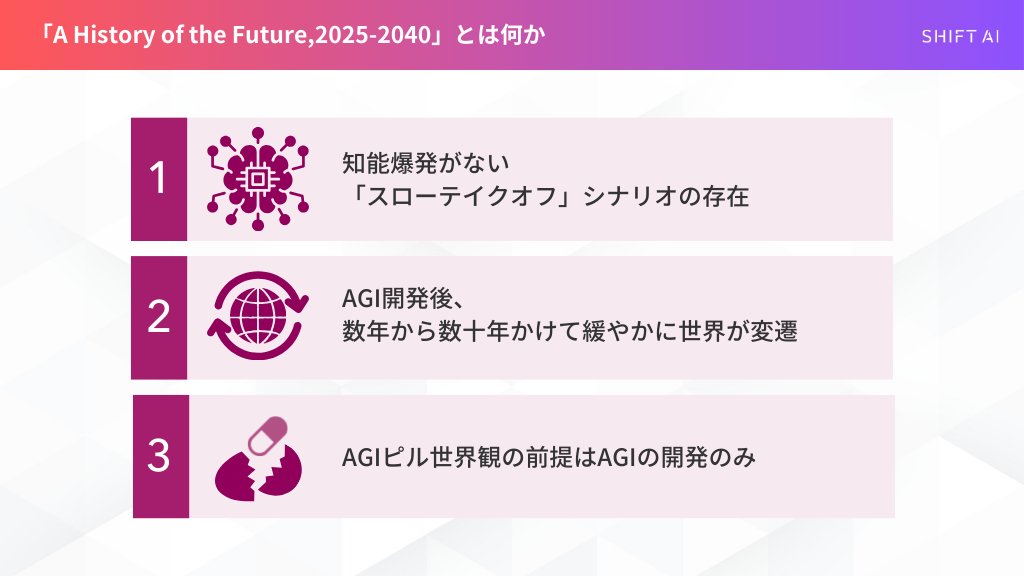

A History of the Future, 2025-2040

4つめのエッセイはメジャーではありませんが、AI 2027のようなシナリオよりも、AIの性能向上のスピードが「遅い」パターンを描いていると言える「A History of the Future, 2025-2040」です。

知能爆発が起こらず、緩やかに強力なAIが世界を5~10年スパンで変えていくシナリオです。

AI2027のように1年以内の急激な産業爆発、技術爆発は描かれませんが、以下の内容が予測されています。

- 2030年代半ばにはヒューマノイドの数が数十億台になる

- 2040年代にはなんと4兆台のロボットが年間生産される

- やがて製造業の規模は1000倍になる

5-10年で起こる、急速な技術と産業の拡大が様々な政治的文化的変遷とともに、詳細に物語として描かれています。

つまり、知能爆発が起きない世界でのAGIピルな「スローテイクオフ」シナリオとなっていると言えるでしょう。

重要なのは、AGIピル的な世界観は知能爆発、即ちAIがAIを研究することですごい速度で自己改善が起こることは前提ではないということです。

AGIピル世界観の前提は、「AGIが開発されるということだけ」です。

AGIが開発されると、数年でSF的なことが起きるのか、数十年でSF的なことが起きるのかの違いはありますが、それでも普通の世界観からしたら、SF的なものが起きることはとてもすごいことなのです。

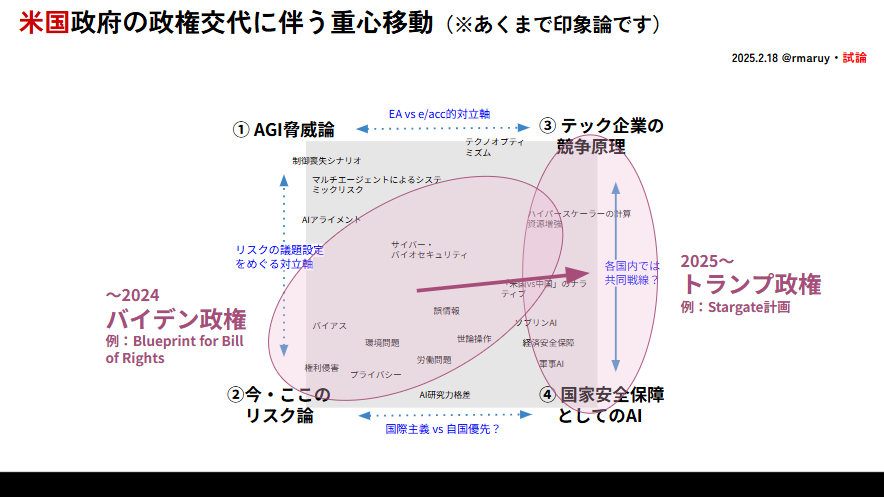

AI規制から安全保障へ

上記のエッセイ群は、ここ数年テック界隈で衝撃を呼び、それに呼応するように、AIが経済や軍事の国家安全保障の中核的な課題となりつつあります。

この流れは、OpenAIやAnthropicといった企業にとどまらず、米英政府、EU、中国 にまでこの数年急速に波及しています。

そして、各国がAI規制を緩和し、AI開発を加速する動きを見せているのです。

さらに、トランプ政権になってAI規制は更に緩和する方向にシフトしています。

実際にOpenAIは、2025年1月にStargate計画を発表し、周辺領域の規制も緩和する方向でトランプ政権は動いています。

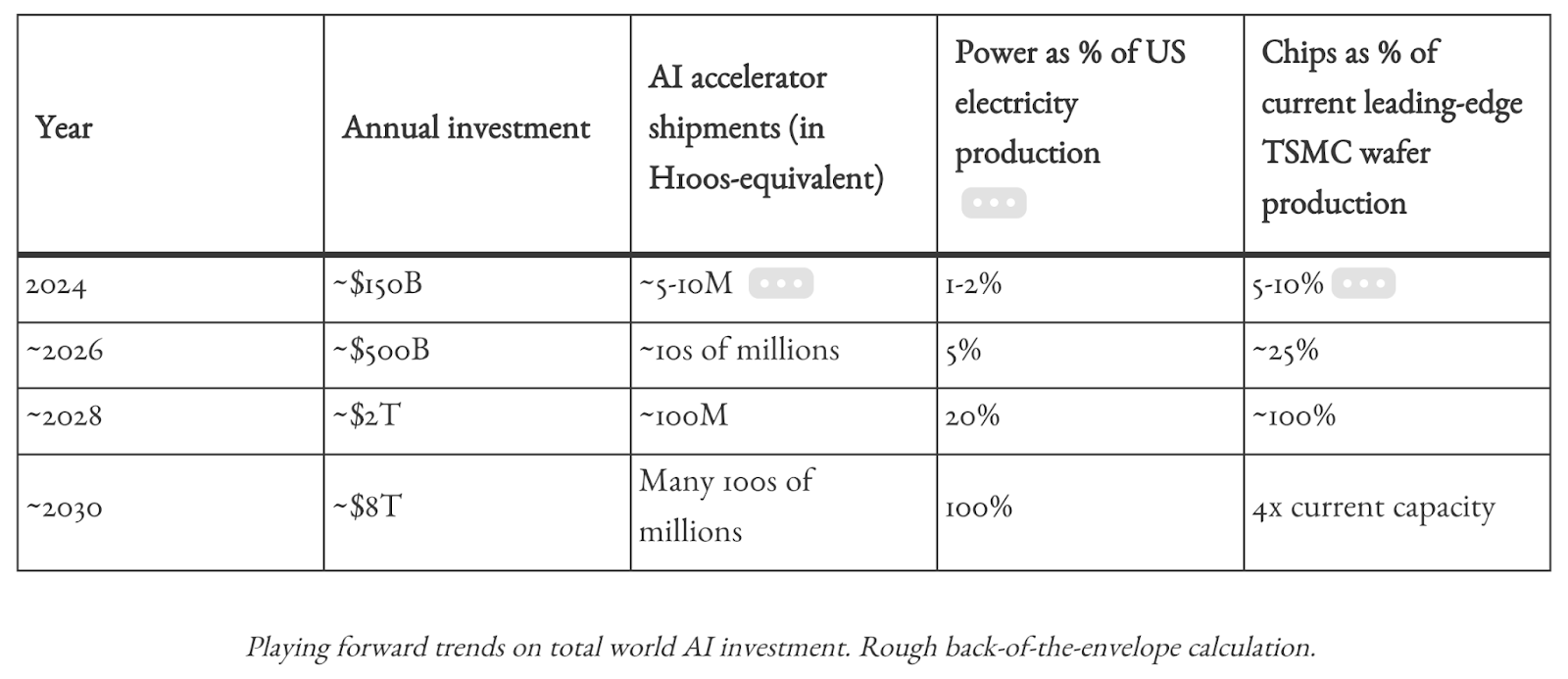

こうした莫大な投資の動きは、1つ目のLeopold Aschenbrennerのエッセイで指摘されていたトレンドそのものです。

最終的に、「10兆ドル規模のAIインフラ投資が必要になる」というサムアルトマンや、孫正義、G42 CEOらの発言も、以下のLeopold Aschenbrennerの表の通りの、2030年頃の発展を想像しているのだと考えられます。

もしAGIが数年以内に開発され、10兆ドル規模のAIインフラ投資が実現すれば、2030年には「人類の総人口を超える数の、人間以上に賢いAIエージェント」が存在する未来 も現実味を帯びてくるでしょう。

そしてAGI/超知能の出現は、人類史を変える出来事であると同時に、各国にとっては軍事安全保障の問題となります。

とくに、超知能による圧倒的な技術革新は、以下の戦略的リスクを現実のものとする可能性があります。

- 現行の核抑止体制の崩壊(核兵器・ステルス潜水艦の先制無力化)

- 中国による先制攻撃(極端なケースでは、特殊作戦部隊によるAI関連施設への攻撃)

- AI主導の新たな戦争の可能性

20世紀の軍事技術の発展を10年足らずで経験したらどうなるか、想像してみてください。

数年後には、馬・ライフル・塹壕戦から現代の戦車部隊へ。

さらに数年後には超音速戦闘機・核兵器・大陸間弾道ミサイル(ICBM)の大群へ。

さらに数年後には、敵が気付く前に敵を殲滅できるステルス技術と精密兵器へと移行していたでしょう。

こうした急激な変化が、今後AI技術によって数年単位で現実化する可能性があります。

X riskとアライメント・ガバナンスの遅れ

世界的なAI安全保障重視のトレンドが、AGIの数年以内の開発を可能にすれば、AI Safetyコミュニティにとっては痛手となるでしょう。

AI Safetyコミュニティ:AIをできる限り安全に開発することを支持する傾向にあるコミュニティ

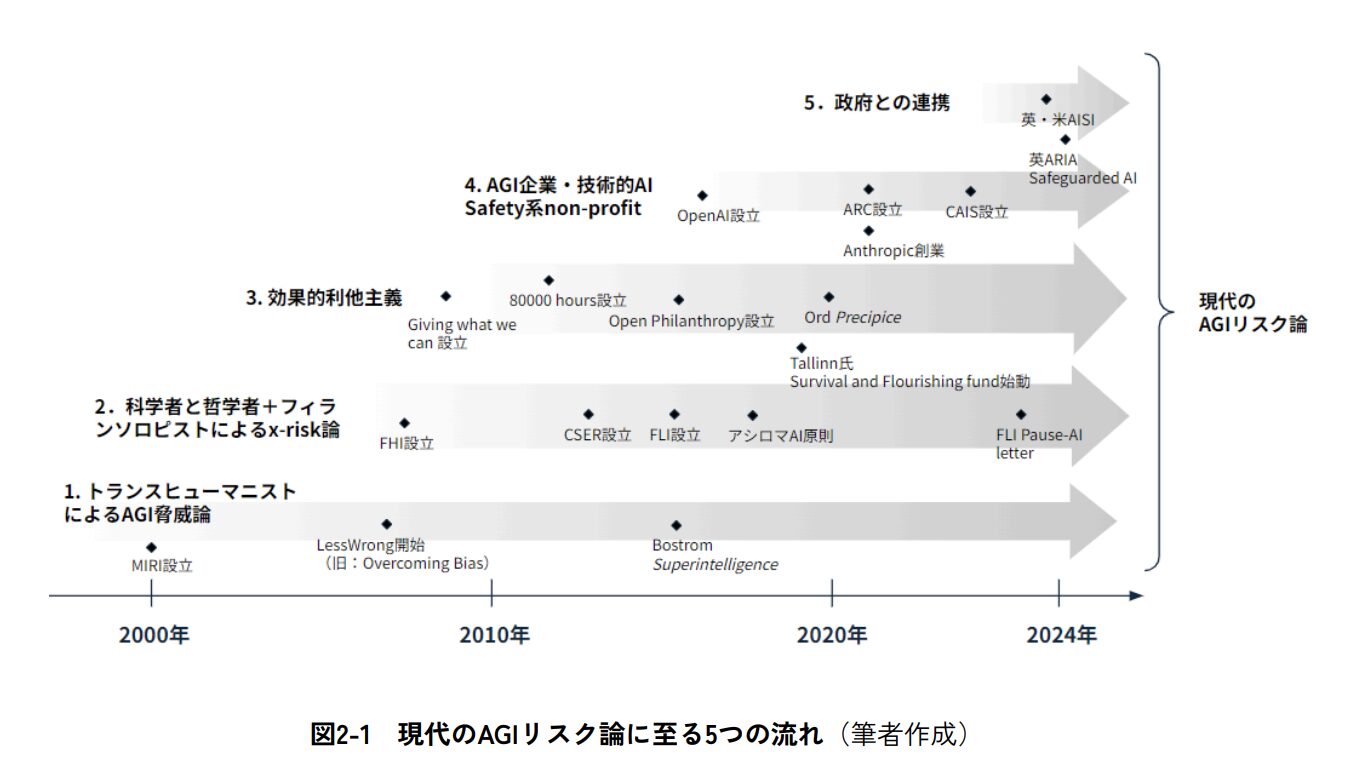

AI Safetyコミュニティは、上記のAGIリスク論に至る5つの流れのうち、主に1〜3を指します。

詳しく歴史的背景を知りたい場合は丸山氏の資料や私の資料1,2を参照すると良いでしょう。

AI Safetyコミュニティは、2023年の3月にGPT-4以上の能力を持つAIシステムの開発を半年ストップすることを呼びかけていましたが、もはやその訴えは事実上無視され、世界はAIの開発の加速方向に舵を切りつつあります。

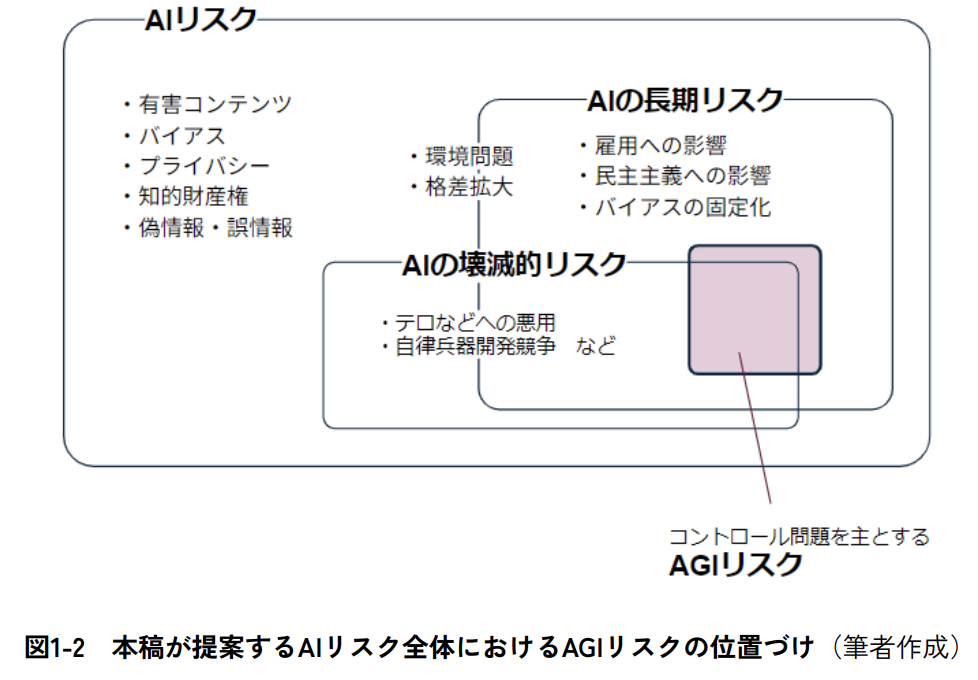

彼らが最も懸念しているのは、AGIや超知能が人間の意図しない動作をすることによる破局的なシナリオや人類の絶滅です。

今起きていることは、人間による戦争・悪用リスクや権威的な政府による圧政リスクとは別に「AI自身が自律的に人類に危害をもたらす可能性である」と言えます。

前の記事でも説明したように、全体的には現在の急速なAIの能力の発展に対し、AIの意図を人間の意図に沿わせる研究分野であるAIアライメント研究や国際的なAIガバナンス状況は追いついていません。

世界各国は「AI競争」に突き進んでいますが、「国家の存続に関わる安全保障問題」と同時に、このような「人類の存続に関わる安全保障問題」 という二重のリスクが存在していると言えるでしょう。

まとめ

ChatGPTがリリースされてから数年で目まぐるしい勢いでAIの進歩は発展していますが、その先に見えているビジョンには「AGIピルな世界観」があります。

「AGIがいつできるか?」には議論があり、また自己改善が急速に起こる知能爆発が起こるかどうかにも議論がありますが、一度AGIが開発されると急速な技術と産業の変化が予想されています。

AGIがもたらす変化とは、単にちょっと科学技術や経済の成長が高まるという程度ではありません。

誰もがSF的だと感じるような技術が数年から数十年で開発され、数百年数千年先だと誰もが考えるような太陽系全体を植民地化する宇宙文明産業が、たった数十年以内に到達するというような莫大な変化です。

それはあたかも狩猟採集時代の人間がニューヨークのど真ん中に突如として放り込まれるような驚きを感じるでしょう。

そしてそのような発展が、AGIの開発以後数年から数十年で起きる可能性が高いと考えられているのです。

AGIという言葉はより広まってきましたが、AGIがもたらすインパクトを正しく捉えている人は多くありません。

本記事でAGIがもたらすインパクトの大きさを少しでも感じていただけたら幸いです。

もし、もっとAGIピルの理論的な根拠、たとえば本当に技術や産業がそんなに急速に拡大するのか?を知りたい方は、Forethoughtのこのエッセイを読むことをお勧めします。

SHIFT AIでは、ChatGPTやGeminiなどの生成AIを活用した、昇進・転職などに役立つスキルを学べるセミナーを開催しています。

また、参加者限定で、「最新AI情報キャッチアップガイド」「実務で役立つ生成AI時短術」「新時代のAI×デザイン活用ガイド」など、全12個の資料を無料で配布しています。

「これからAIを学び始めたい」「AIを使って本業・副業を効率化したい」という方は、という方は、ぜひ以下のボタンからセミナーに参加してみてください。

スキルゼロから始められる!

無料AIセミナーに参加する

スキルゼロから始められる!

無料AIセミナーに参加する