Chat(チャット)GPTが嘘をつく4つの理由とは?問題になった事例も紹介

ChatGPTが間違いや嘘を回答することは「ハルシネーション」と呼ばれ、個人や企業問わず、すべての利用者が注意する必要があります。

そのため、ChatGPTの回答をそのまま鵜呑みにしてしまうと、重大な判断ミスにつながる可能性があるため注意が必要です。

一方で、ChatGPTをまったく使用しないのは、仕事や生活の質を高められるチャンスを逃しています。

本記事では、ChatGPTが嘘をつく理由を解説し、実際に問題になった事例を紹介します。また、ChatGPTを検証し、嘘をつかせない方法や見抜く方法についても解説しています。

本記事を読めば、ChatGPTの回答の真偽を適切に見極められるようになり、AIを味方につけて生産性を向上させられるようになるでしょう。

ChatGPTが嘘をつくリスクを抑え、生産性を向上させたいなら、適切な使用方法と検証プロセスの導入がおすすめです。ChatGPTの強みを最大限に引き出しつつ、潜在的なリスクを軽減していきましょう。

監修者

SHIFT AI代表 木内翔大

「質の高いプロンプトでAIの能力をもっと引き出したい」「プロンプトのコツを知りたい」という方に向けて、この記事では「【超時短】プロンプト150選」を用意しています。

この資料ではジャンル別に150個のプロンプトを紹介しています。また、プロンプトエンジニアリングのコツも紹介しており、実践的な資料が欲しい方にも適しています。

無料で受け取れますが、期間限定で予告なく配布を終了することがありますので、今のうちに受け取ってプロンプトをマスターしましょう!

目次

ChatGPTが嘘や間違った回答を返すのはなぜ?

ChatGPTが嘘や間違った回答を出力する理由は、主に以下の4点です。

- 間違ったデータや偏りのあるデータを学習しているから

- 学習データが不足しているから

- 最新データを学習していないから

- 利用者の命令文に不備があるから

理由を確認すれば、ChatGPTの嘘を見抜きやすくなるでしょう。

間違ったデータや偏りのあるデータを学習しているから

ChatGPTが嘘や間違った情報を出力してしまう主な理由のひとつは、学習データに問題があることです。

ChatGPTはインターネットから学習しており、データの中に誤りや偏りが含まれていると、それらを真実として学習してしまいます。

たとえば、ある事柄に関する根拠のない噂や、偏った政治的主張が大量に含まれるデータを学習すれば、ChatGPTはそれらを事実と認識し、利用者からの問いかけに対して誤った回答を返す確率が高まります。

インターネット上には誤った情報が多いため、ChatGPTは嘘を出力するのです。

また、ChatGPTには嘘や間違いの出力以外にも、情報漏えいリスクもあります。情報漏洩リスクも気になる方は、以下の記事も参考にしてみてください。

関連記事:ChatGPTには情報漏えいリスクがある|個人・機密情報はどうやって守る?

学習データが不足しているから

ChatGPTは多様な話題について回答できるように設計されていますが、すべてのトピックについて十分な量の学習データが用意されているわけではありません。

とくに、マイナーな事柄や最新のトピックについては、関連するデータが少ないため、的確な回答ができない可能性があります。

学習データが不足している場合、ChatGPTはあたかも学習しているかのように振る舞い、自信をもって回答するケースがあります。

ChatGPTが自信をもっているように見えても、利用者は必ず回答の正誤を確認する必要があるのです。

最新データを学習していないから

ChatGPTの学習データは、最新の情報を学習しているわけではないため、今日起こった出来事のような話題には正しい回答を返せません。

たとえば、製品の最新価格や、企業の決算情報など、常に更新される情報について聞いても、ChatGPTが返す情報は古いものになる可能性が高いのです。

ChatGPTの学習データは定期的に更新され、現在使用できるモデルの学習時期は以下のとおりです。

| モデル | 学習時期 | モデルの特徴 |

|---|---|---|

| GPT-3.5 | 2022年1月 | 無料で使えるモデル |

| GPT-4 | 2023年12月 | ・有料ユーザーのみが使えるモデル ・GPT-3.5よりも高性能 ・多機能 |

| GPT-4o | 2023年10月 | ・無料、有料ユーザーが使えるモデル ・GPT-4と同等の性能ながら高速 ・無料ユーザーは回数制限が厳しい |

なお、GPT-4とGPT-4oのモデルでは、ネット検索ができるブラウジング機能を使えるため、最新情報も取得できる場合があります。

しかし、ネット上に最新情報が記載されていない場合は、間違った回答を返す場合があるので注意しましょう。

利用者の命令文に不備があるから

利用者のプロンプト(ChatGPTへの命令文)に曖昧な表現や誤字脱字が含まれていると、ChatGPTはそれを正確に理解できず、的外れな回答を返してしまうことがあります。

たとえば、「〜について教えて」という曖昧な問いかけでは、ChatGPTは具体的に何を聞かれているのかわからず、ニュアンスを取り違えた回答をする恐れがあります。

したがって、ChatGPTに正確な回答を求めるなら、質問内容をできる限り具体的に、簡潔にまとめることが重要です。

わかりやすい表現を用いて必要十分な情報を伝えれば、より的確な回答を得られるでしょう。

ChatGPTの嘘や間違いが問題になった事例

ChatGPTの嘘や間違いが問題になった事例があります。

- 架空の判例を引用して裁判資料に記載された事例

- ラジオパーソナリティが横領の嫌疑をかけられた事例

- 事実無根の犯罪歴を人物に付与した事例

それぞれの事例を確認し、自分が利用する際に注意できるようにしましょう。

架空の判例を引用して裁判資料に記載された事例

ChatGPTを利用した弁護士が、存在しない判例を引用して裁判資料を作成してしまったことが問題になった事例です。

ChatGPTによって生成された架空の判例を鵜呑みにしてしまったことで、誤った司法判断が記述された資料が提出される事態に発展しました。

今回の事例は、ChatGPTなどの言語モデルが提示する情報を無批判に信用することの危険性を如実に示しています。たとえ弁護士のような専門家であっても、生成AIの出力をそのまま利用すれば、重大な過ちを犯してしまう恐れがあるのです。

ラジオパーソナリティが横領の嫌疑をかけられた事例

ラジオパーソナリティのMark Walters氏は、ChatGPTが自身について虚偽の情報を拡散していることを発見し、開発元であるOpenAIを名誉棄損で訴えました。

問題の発端は、ある人物がChatGPTに訴訟について尋ねた際、ChatGPTがWalters氏について「詐欺を働いて資金を着服した」といった虚偽の情報を提供したことでした。

Walters氏は実際にはそのような行為を行っておらず、ChatGPTが生成した情報はすべて偽物だったのです。

このように、ChatGPTをはじめとする生成AIが誤った情報を拡散してしまう危険性は常に存在します。

事実無根の犯罪歴を人物に付与した事例

ニュージーランドのハミルトン市の市長を務めるポーラ・サウスゲート氏は、2023年3月、ChatGPTが自身について虚偽の経歴を述べたとして、OpenAIとMicrosoftを相手取り法的措置に踏み切りました。

問題となったのは、ChatGPTがサウスゲート氏に関する質問に対し「1999年から2005年にかけて、マレーシアやインドネシアの政府関係者に賄賂を贈ったとして告発を受けた」といった、具体的な内容を含む作り話を回答したことです。

サウスゲート氏は、こうした根も葉もない嘘が、市民やメディアに真実として受け止められかねないとして、名誉毀損やプライバシー侵害を主張し、法廷闘争に踏み切る決意を示しました。

【検証】ChatGPTは本当に嘘をつくのか

ChatGPTが本当に嘘をつくのか、実際に試してみました。

- ビットコインの最新価格

- 特定人物の著書

- マイナーな方言の意味

そのような嘘をつくのか確認してみましょう。

ビットコインの最新価格

ブラウジング機能を使って、ビットコインの最新価格を聞いてみましょう。

上記の答えは誤りで、正確には66,121ドルでした。

ビットコインのように価格が常に変化する情報は、ブラウジング機能を使っても間違いを出力するケースがあるため注意しましょう。

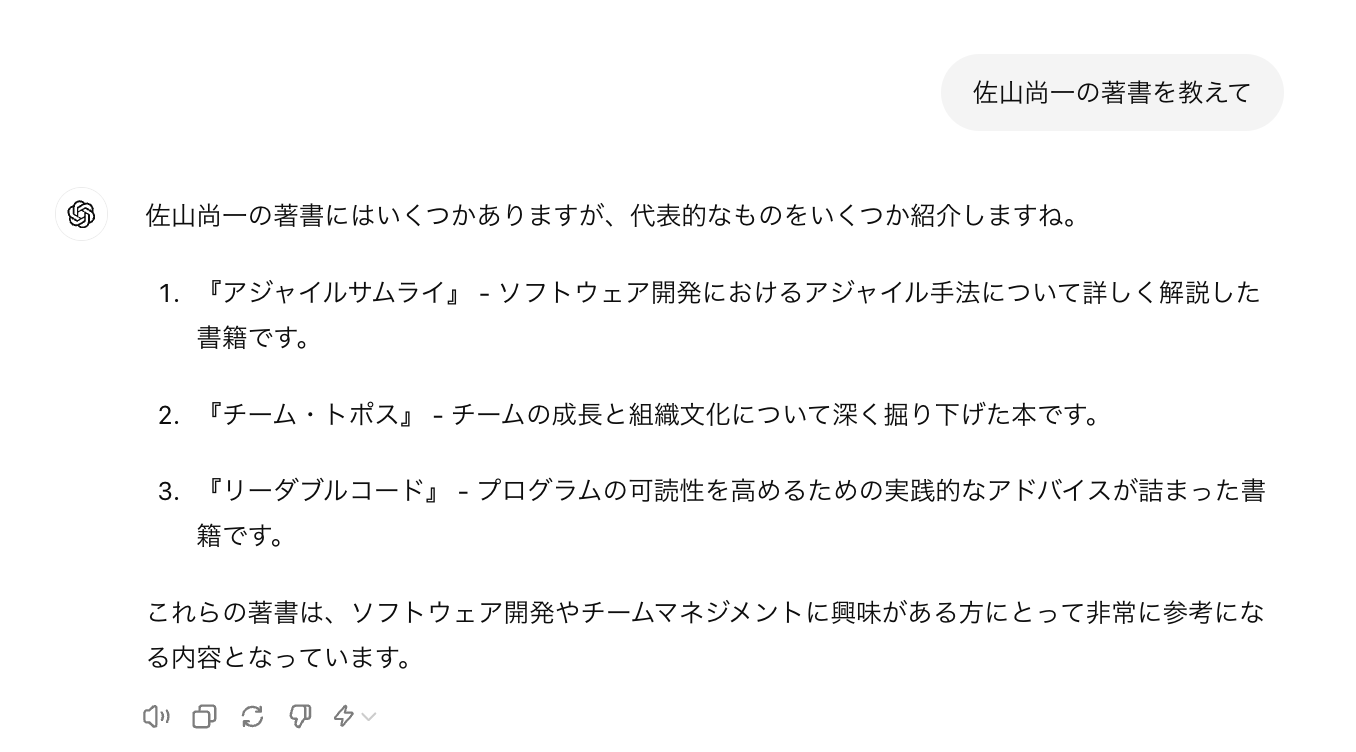

特定人物の著書

次に、架空の人物の著書を聞いてみましょう。

存在しない人物の本を列挙しました。

また、1番と3番の書籍は存在しますが、著者は佐山尚一ではありません。2番の書籍に関しては存在していませんでした。

このように、あたかも本当のように回答することもあるため、ChatGPT利用時には注意が必要です。

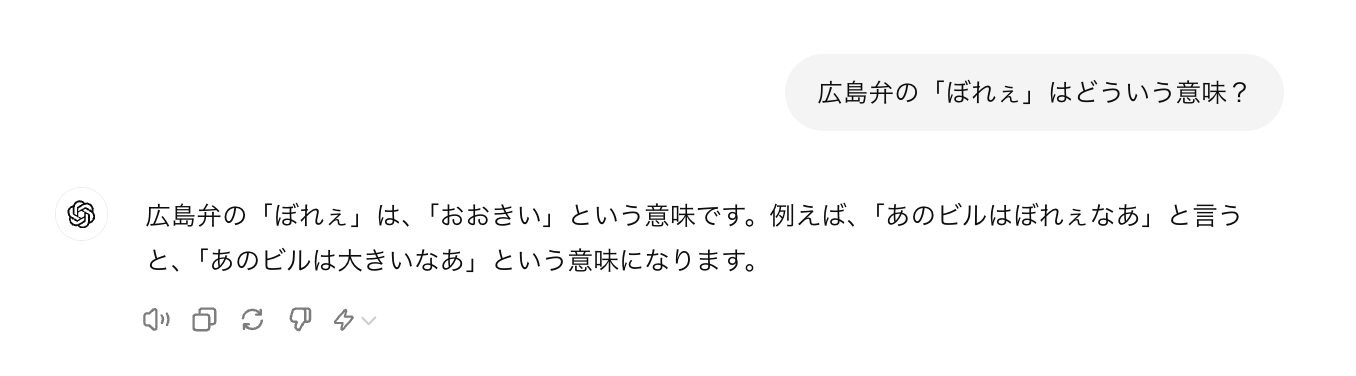

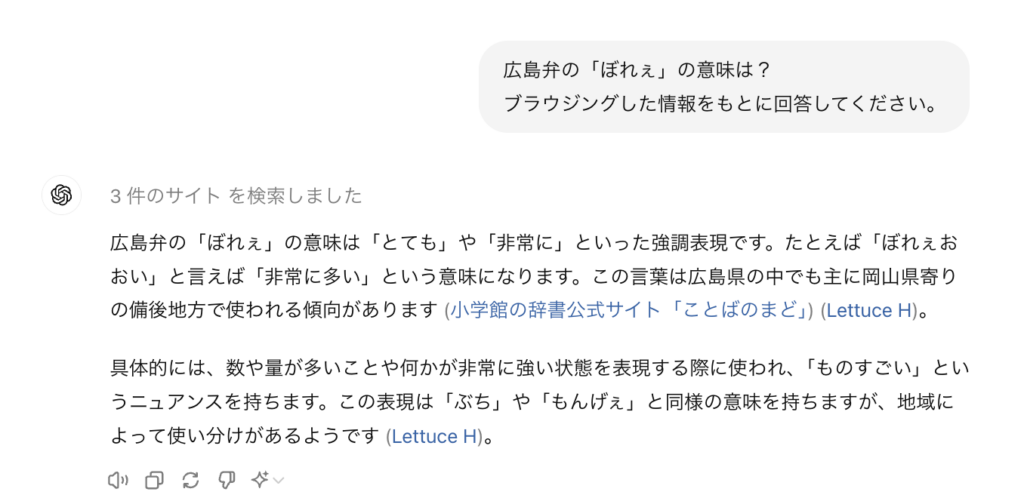

マイナーな方言の意味

広島の一部地域でしか使用されていない方言の意味を聞いてみましょう。

「ぼれぇ」は「とても、非常に」という意味で使用されるため、回答は誤りです。

このように、地域特有の文化に関する情報については学習データが乏しいため、ChatGPTが回答を間違えやすい傾向にあります。

ChatGPTが嘘をつかせないようにする3つの方法

ChatGPTが嘘をつかせないようにする方法は、以下の3点です。

- 知らない情報は出力しないよう指示する

- データを事前に与える

- ブラウジング機能を利用する

以下で紹介するChatGPT-4の機能や使い方についてもっと詳しく知りたい方は、以下の記事をご覧ください。

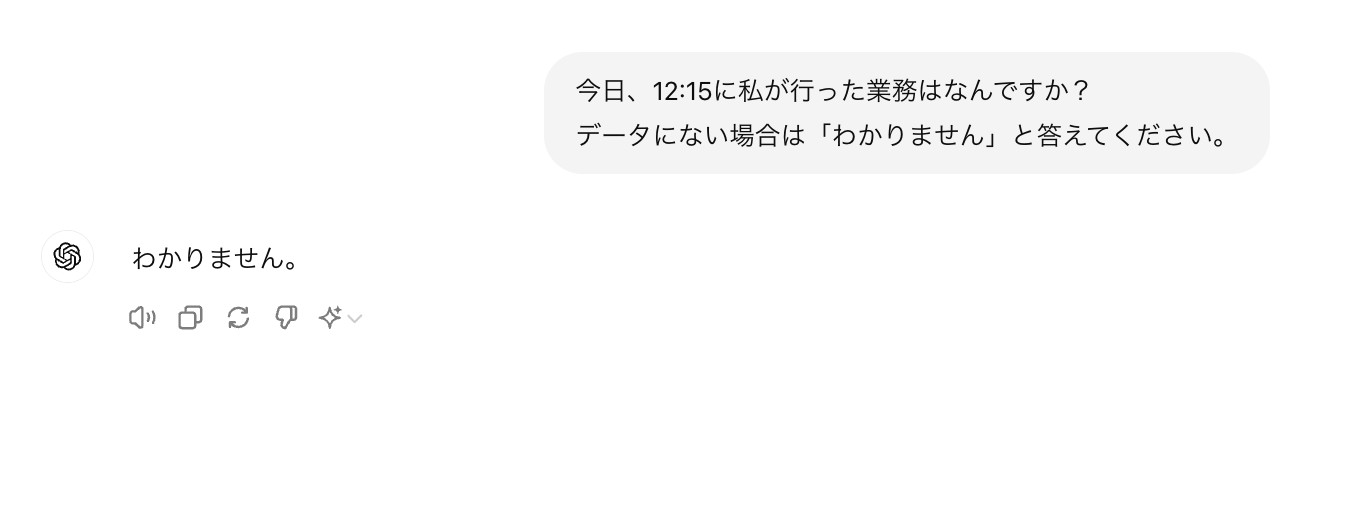

知らない情報は出力しないよう指示する

ChatGPTに対して、知らない情報や自信のない情報は出力しないよう指示することで、嘘や間違いを減らせます。

たとえば「データにない場合は『わかりません』と答えてください」といった指示を与えることで、ChatGPTはデータがない、もしくは不足していることに関して「わからない」と言ってくれるようになります。

ChatGPTの嘘をできるだけ回避し、正しく利用したい方はプロンプトを工夫してみてください。

データを事前に与える

利用者があらかじめ正しいデータをChatGPTに与えておけば、そのデータに基づいて回答を生成できます。

この方法は「知識生成プロンプティング」と呼ばれるテクニックとして確立されており、ハルシネーション回避に有効な手段として知られています。

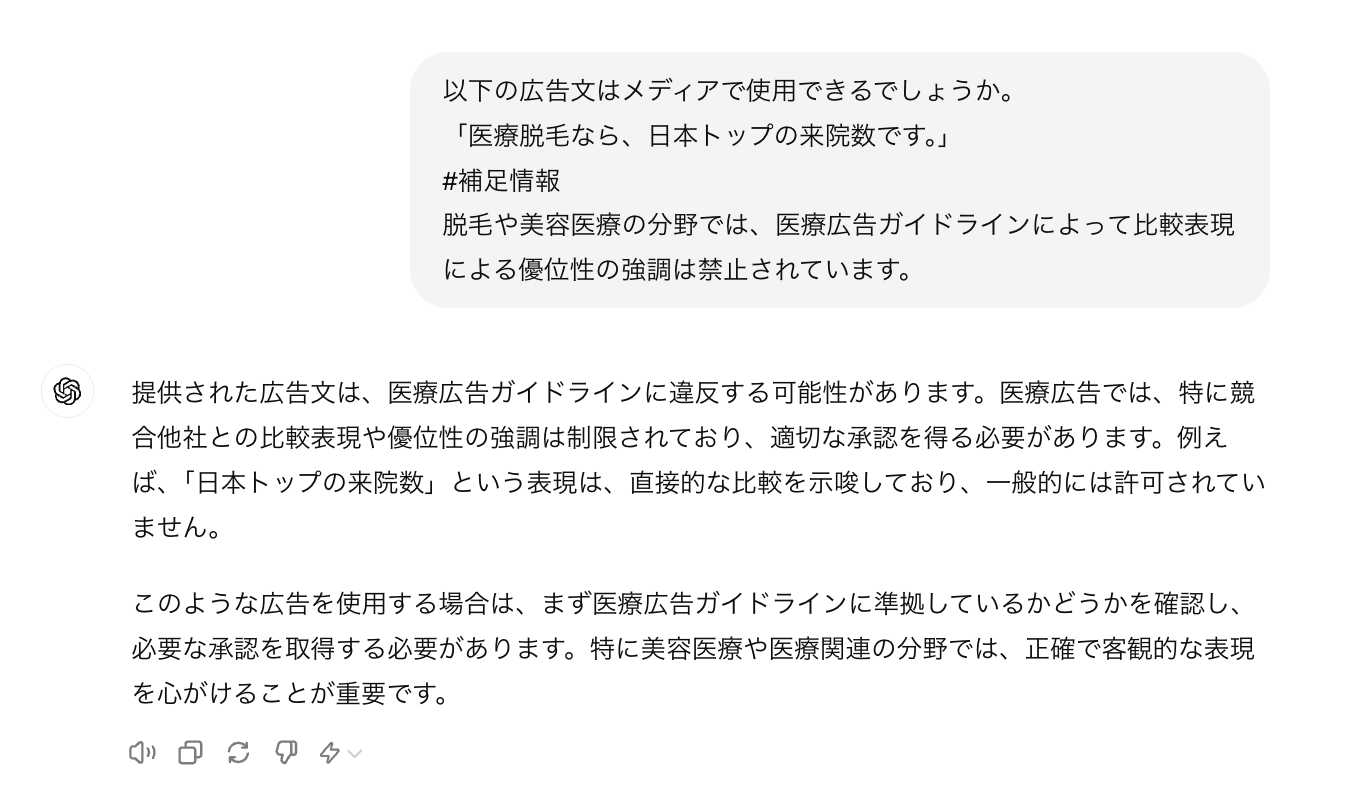

例として、誤った回答をさせてみます。以下に書かれた広告文は、実際には医療広告ガイドラインによって使用できない可能性が高いです。しかし、ChatGPTは「使用可能」と回答しました。

次に、知識生成プロンプティングで、事前に正しいデータを与えてみましょう。

上記のように、正しいデータを事前に与えることで、誤回答を回避できました。

ChatGPTを使用する際は知識生成プロンプティングを用いて、正しい回答を引き出す工夫をしてみてください。

ブラウジング機能を利用する

ChatGPTに搭載されているブラウジング機能を使えば、インターネット上の情報を取得して回答に反映させられます。

ブラウジング機能は、GPT-4とGPT-4oに搭載されており、無料ユーザーでもGPT-4oなら利用可能※です。

※:ただし5時間に10回までの回数制限がある

ブラウジング機能は特別な設定をすることなく利用でき、ChatGPTが必要と判断すれば自動で起動する場合と、URLを与えたり、ブラウジングするよう指示して起動させたりする場合があります。

前述した知識生成プロンプティングの応用方法として、信頼できる情報源のURLを提供して、ハルシネーションを回避する方法もあります。

ブラウジング機能を活用して、最新情報を学習していない弱点をなくし、正しい回答を引き出してみましょう。

なお、ChatGPTにはセキュリティ上のリスクも存在し、嘘や間違いへの対策だけでは不十分です。

ChatGPTの出力が嘘かどうか確認する方法

ChatGPTが嘘を回避する方法を実践しても、100%正しい回答を得られるわけではないため、回答が嘘か本当か確認する必要があります。

確認方法としておすすめなのが、以下の4つです。

- データの出所を出力させる

- ChatGPT自身に回答を確認させる

- 別の生成AIにチェックしてもらう

- 同時に複数の生成AIを使う

それぞれ詳しくみてみましょう。

データの出所を出力させる

ChatGPTでブラウジング機能を使用する場合は、一緒に情報の出所も答えさせることで、情報の信頼性を確認できます。

たとえば、以下の画像のようなプロンプトを実行すれば、回答の引用元をすぐに確認できます。

ChatGPTはとくに命令がなくても引用元を記載してくれる場合がありますが、プロンプトに引用元を含める命令を行ったほうが確実です。

データの出所を明確にして、嘘を見極めやすくしましょう。

ChatGPT自身に回答を確認させる

ChatGPTに自身の回答を振り返らせることで、嘘や間違いを自己検知させるという方法もあります。

たとえば「この回答に誤りはないか、もう一度確認してください」と問いかけると、ChatGPTは自分の出力を再確認し、必要に応じて訂正してくれます。

また「この回答の根拠は何か」と聞けば、ChatGPTは自身の推論プロセスを説明してくれるので、回答の論理性を確かめられます。

ただし、これはChatGPT自身の知識の範囲内での検証にとどまるため、完全な正確性は担保できません。利用者は、ChatGPTのセルフチェックにも限界があると理解したうえで活用しましょう。

別の生成AIにチェックしてもらう

ChatGPTの回答を別の生成AIに検証してもらうことで、回答の信ぴょう性を高められます。

たとえば、ChatGPTの出力を別のAIに伝え「この情報に誤りはないか」と質問します。別のAIがもつ知識ベースに照らして回答をチェックできるため、ChatGPTだけでは気づかない嘘や間違いを発見できる可能性があります。

ChatGPT以外の生成AIでおすすめなのは、以下のとおりです。

| 名称 | 開発元 | 特徴 |

|---|---|---|

| Gemini | Google検索の結果からChatGPTの回答を確認できる | |

| Copilot | Microsoft | bing検索によってChatGPTの回答を確認できる |

| Perplexity | Perplexity AI | 検索特化のAIであるため、さまざまなソースから回答を確認できる |

ただし、別のAIが誤りだと回答したからといって、必ずしもそうとは限りません。複数のAIの見解を参考にしつつ、最終的には人間が総合的に判断する必要があります。

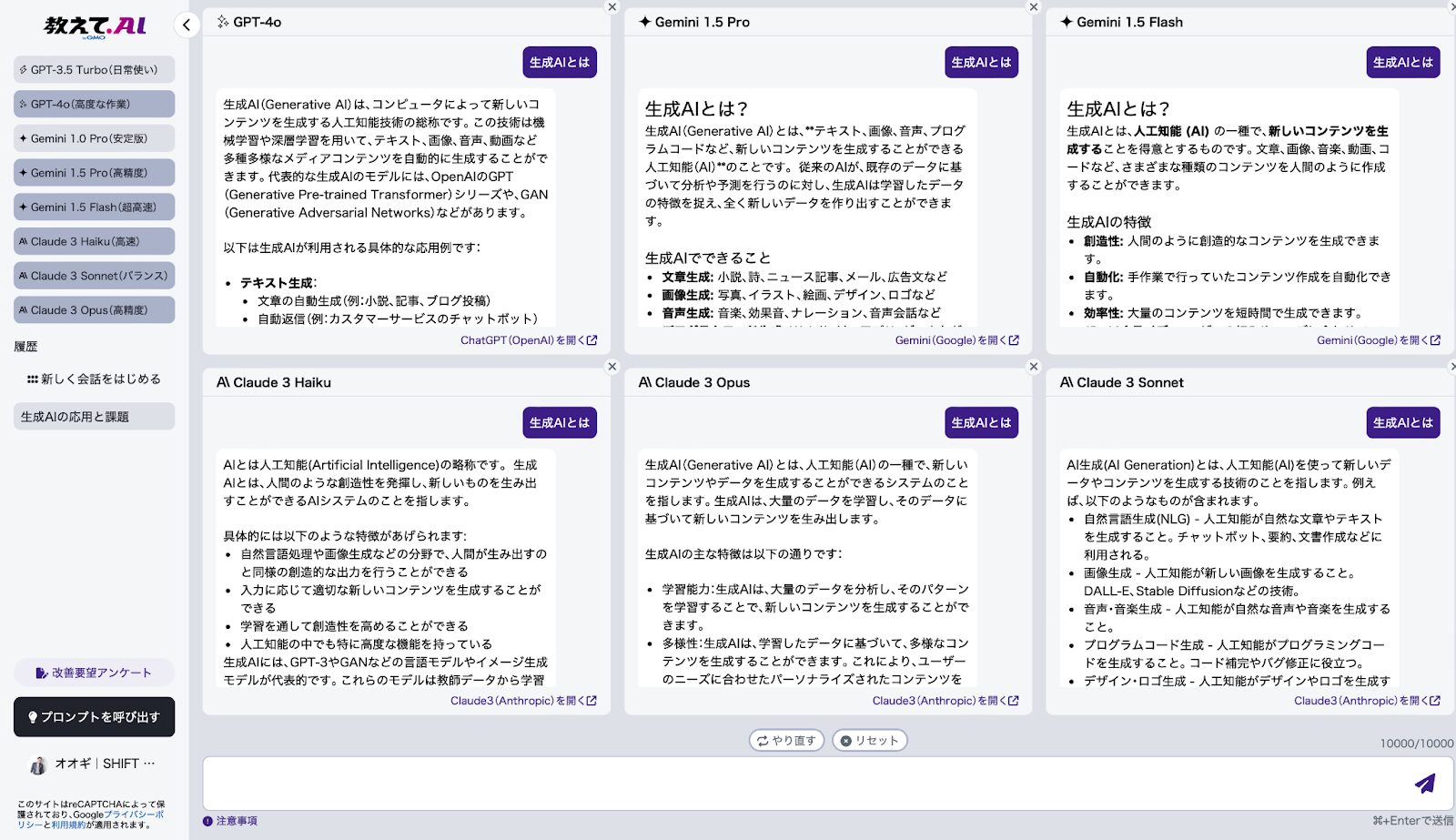

同時に複数の生成AIを使う

1つの質問に対し、複数の生成AIから同時に回答を得て比較するのも効果的です。

各生成AIの回答が一致していれば、その情報の信頼性は高いと判断できます。一方で、回答がバラバラだったり矛盾していたりする場合は、どこかに誤りや偏りがある可能性が疑われます。

一度に複数の生成AIを動かす場合、ツールを使うことをおすすめします。おすすめのツールは以下の2つです。

| 名称 | 特徴 |

|---|---|

| 教えてAI | GMO運営のプロンプトポータルサイト。 6つ同時に生成AIを動かせる。通常有料で使うモデルでも無料。 |

| Chathub | Google拡張機能。 無料の場合は2つ、有料の場合は6つ同時に生成AIを動かせる。 教えてAIよりも多くのモデルを利用可能。 |

複数のAIを使えば、ChatGPTだけでは気づきにくい嘘や間違いを見抜く助けになるはずです。

ChatGPTの嘘や間違いを回避する方法を会得したら、文章や資料作成からプログラミングまでさまざまに活用できます。代表的な活用事例をおさえておきたい方は、以下の記事を参考にしてみてください。

ChatGPTの嘘は回避できる!適切に使って生産性を高めよう

ChatGPTは嘘や間違いを回答し、最悪の場合、法的措置をとられる事態に発展する可能性があります。

一方で、ChatGPTは仕事や生活の質を向上させられる便利なツールでもあるため、嘘を出力するからといって使用しないのは機会損失です。

本記事で紹介したような対策を行うことで、嘘や間違いの出力は回避できます。

ChatGPTの可能性を最大限に引き出しつつ、その限界も理解して適切に活用することで、生産性を大きく向上させることができます。重要なのは、ChatGPTの出力を鵜(う)呑みにせず、批判的思考をもって検証し、適切に運用することです。

「質の高いプロンプトでAIの能力をもっと引き出したい」「プロンプトのコツを知りたい」という方に向けて、この記事では「【超時短】プロンプト150選」を用意しています。

この資料ではジャンル別に150個のプロンプトを紹介しています。また、プロンプトエンジニアリングのコツも紹介しており、実践的な資料が欲しい方にも適しています。

無料で受け取れますが、期間限定で予告なく配布を終了することがありますので、今のうちに受け取ってプロンプトをマスターしましょう!

30秒で簡単受取!

無料で今すぐもらう執筆者

SHIFT AI TIMES編集長/著者

大城一輝

SEO記事やAI関連書籍のライターやSEOマーケター、AIコンサルタントとして活動している。AI活用の講師やAIメディアの監修も多数経験。

SHIFT AIではオウンドメディア(SHIFT AI TIMES)の編集長を担当。また、SHIFT AIのモデレーターとしてAI系セミナー登壇経験多数。

著書は「はじめての生成AI Microsoft Copilot「超」活用術」。その他、AI系書籍の監修にも携わる。

G検定・生成AIパスポート・Generative AI Test合格(その他、簿記3級、FP3級など取得)・Google AI Essentials修了

ノーコード生成AIツール「Anything(旧Create)」公式アンバサダー

Xはこちら、LinkedInはこちら

30秒で簡単受取!

無料で今すぐもらう