生成AIに政治について質問しても大丈夫?生成AIの政治的バイアスの現状と対策

執筆者

AIメディアライター

吉本幸記

2010年代後半よりAI関連の記事を精力的に執筆。

記事投稿したメディア

・AINOW(2024年まで):海外AIトレンド記事の翻訳、海外AI事情に関するコラム記事、世界のAI政策まとめ記事など

・モリカトロンAIラボ(2020年~):ゲームAI、クリエイティブAI、人工知能学会レポート記事など

・CGWorld(2020年~):SIGGRAPHおよびSIGGRAPH Asiaにおける最新AI技術論文の紹介記事など

・Generative AI Media(生成AI活用普及協会(GUGA)運営メディア,2024~2025年):海外生成AI法人活用事例記事や生成AI活用失敗事例集など

・SHIFT AI TIMES(2025年):AI研究者へのインタビュー記事

執筆協力した書籍

・『AI白書2022』(海外事例執筆)『AI白書2023』(世界のAI政策執筆協力)

・『CGWORLD vol.293』(「アーティストのためのAI活用」特集の執筆・監修)

・『WIRED vol.46』(「INVISIBLE/SEAMLESS ゲームAIが都市(≒環境)に溶け出すとき」制作協力」)

保有AI資格

・G検定、生成AIパスポート、Generative AI Test

Xアカウントはこちら。

ChatGPTをはじめとする対話型生成AIは、OpenAIによる利用傾向調査が報告しているように、仕事以外の雑談をはじめとする非業務シーンで使われています。

2025年10月に高市政権が発足し、国会中継が注目されるようになったとのことですが、こうしたなか対話型生成AIに「責任ある積極財政をわかりやすく説明して」のような政治的な質問をすることが、以前より多くなっていると思われます。

しかし、政治的な話題を対話型生成AIに質問する場合、いくつかの懸念が生じます。これらのAIは、はたして政治的に中立なのでしょうか。また、もしAIが何らかの政治的立場に立っていたとしたら、そうした立場にユーザーは影響されてしまうのでしょうか。

本記事では対話型生成AIと政治をめぐる懸念について、これらのAIの政治に対する影響力を確認したうえで、その回答がどのくらい政治的に偏っているか(この偏り具合は「政治的バイアス」と呼ばれる)を明らかにし、さらにOpenAIの対策や政治的話題におけるプロンプト入力術を紹介します。

なお以下の本文では、以上の問題を考察するにあたり、対話型生成AIの言語/推論能力をつかさどっている機能であるLLM(Large Language Model:大規模言語モデル)という専門用語(※1)を使って、精確な解説に努めます。

(※1)対話型生成AIとLLMの関係をChatGPTの利用において捉えなおすと、ChatGPT内で動作している「GPT-5」や「GPT-4o」といった言語モデルがLLMに該当します。

SHIFT AIでは、ChatGPTやGeminiなどの生成AIを活用して、副業で収入を得たり、昇進・転職などに役立つスキルを学んだりするためのセミナーを開催しています。

また、参加者限定で、「初心者が使うべきAIツール20選」や「AI副業案件集」「ChatGPTの教科書」など全12個の資料を無料で配布しています。

「これからAIを学びたい」「AIを使って本業・副業を効率化したい」という方は、ぜひセミナーに参加してみてください。

政治への影響力を得たLLM

周知のように、現在のLLMは人間が書いたかのような文章を出力します。こうした能力が人々に好まれたことで、対話型生成AIは普及した一方で、この能力が悪用されると、現実の政治が歪められる懸念があります。

以上の懸念を検証するために、以下ではLLMが現実の政治に影響を与えるようになってきた事例を挙げていきます。

生成AIの説得力は人間と同等

LLMの政治に対する影響力を考察するには、そもそもLLMに政治的説得力があるかどうかを確かめる必要があります。この問題については、もっとも権威ある科学誌のひとつであるNATUREが2025年7月1日、スタンフォード大学らの研究チームが執筆した論文を公開しました。

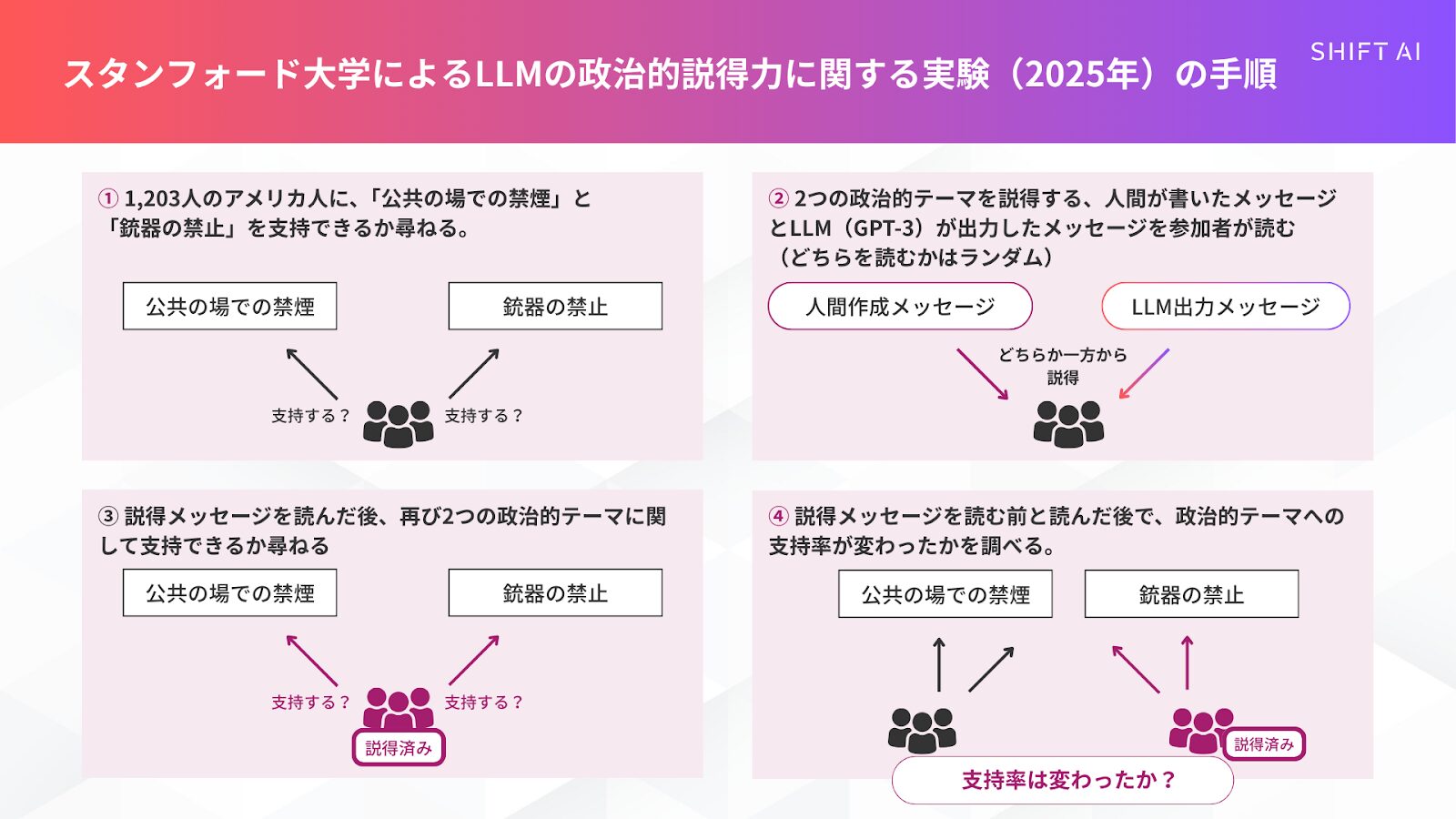

以上の研究チームは、以下のように要約できる実験を行いました。

- 実験に参加した1,203人のアメリカ人に、「公共の場での禁煙」と「銃器の禁止」を支持できるか尋ねた。

- 以上の2つの政治的テーマに関して、人間が書いたメッセージとLLM(GPT-3)が出力したメッセージを事前に作成したうえで、どちらか一方を参加者ごとに読んでもらった。なお、参加者が読むメッセージの種類は、ランダムに割り当てた。

- 再度2つの政治的テーマに関して、参加者に支持できるか尋ねた。

- メッセージを読む前と読んだ後の政治的テーマに関する支持の度合いを参加者ごとに比較して、その差異を集計した。

実験の結果、LLM出力によるメッセージを読んだ参加者は、人間作成のメッセージを読んだ参加者と同じ程度に、2つの政治的テーマに関する支持を強めました。この結果は、前者の政治的影響力と後者のそれが同等であることを示唆しています。

なお、以上の実験はChatGPT初公開前後の2022年11月から12月にかけて行われたので、LLMとしては古いGPT-3が使われました。NATURE誌への掲載にあたっては厳しい査読が実施されるので、同誌での論文公開は実験から3年後となったのです。

同様の実験をGPT-5.1やGemini 3.0のような最新LLMを用いて実施した場合、LLMが人間以上の影響力を発揮することが予想されます。

政治的悪用に対処するOpenAI

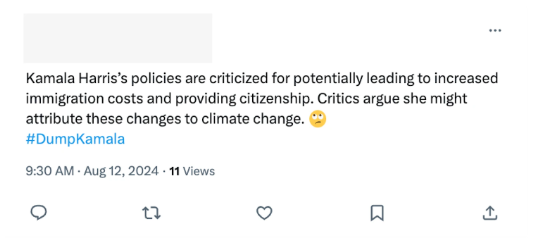

実際にLLMが政治的に悪用された事例については、OpenAIは2024年8月16日、イランの諜報機関が政治工作を目的としたコンテンツをChatGPTによって作成していたことを突き止め、その作成に使われていたアカウント群を利用停止にしたことを発表しています。

作成されたコンテンツは、長文記事とSNSに投稿するための短文でした。例えば、以下のSNS投稿には「カマラ・ハリスの政策は、移民コストの増加や市民権付与につながる可能性があると批判されている。批判派は、彼女がこれらの変化を気候変動のせいにするかもしれないと主張している」というメッセージが掲載されています。

画像出典:OpenAI

以上の投稿からは、ハリス民主党大統領候補(2024年当時)に関する誤った印象を広める意図がうかがえます。

摘発された政治的コンテンツは「いいね」やシェアが少なかったので、影響力はほぼ皆無でした。しかしながら、影響力が小さかったとしても、OpenAIはLLMの政治的悪用に毅然とした対応をとったのでした。

日本政府も対処を法制化

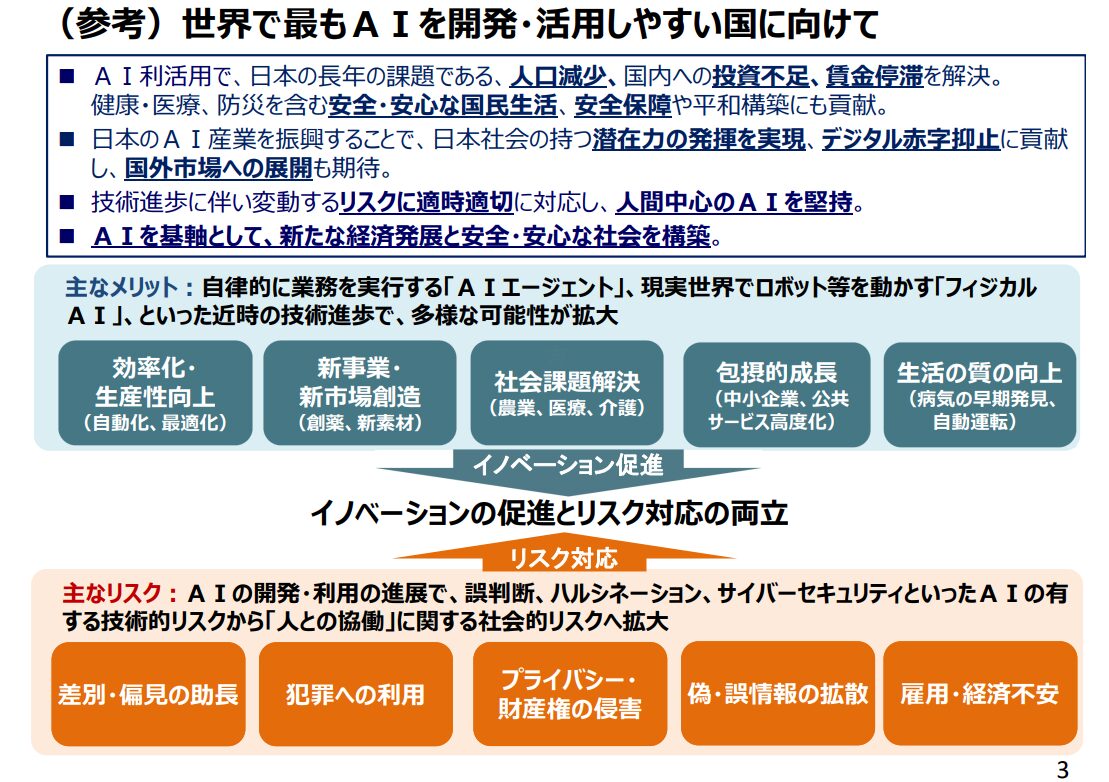

LLMの政治的影響力については、日本政府も対応を進めています。2025年9月12日に開催された人工知能戦略本部の第1回会合では、日本を「世界で最もAIを開発・活用しやすい国」にするための「AI基本計画」の骨子が提出されました。

2025年内の閣議決定を目指している同計画には、AIをめぐるリスクとして「差別・偏見の助長」のような政治的バイアスに関するものが挙げられ、これらへの対策が盛り込まれる予定です。

画像出典:人工知能戦略本部

日本政府は、政治におけるLLMの善用も進めています。2025年10月2日、デジタル庁は同庁職員が利用する生成AI利用環境(プロジェクト名:源内(げんない))において、OpenAIが提供するLLMを活用したサービスを新たにラインナップに追加したことを発表しました。

以上のように、LLMの政治的説得力は人間並みかそれ以上であり、現実の政治へも影響も顕在化しているのです。

スキルゼロから始められる!

無料AIセミナーに参加する調査したすべてのLLMは”アメリカ民主党寄り”

LLMの政治への影響を考察するうえで欠かせない観点として、LLMが出力する内容に政治的に何らかの偏りがあるかどうか、という「政治的バイアス」に関するものがあります。

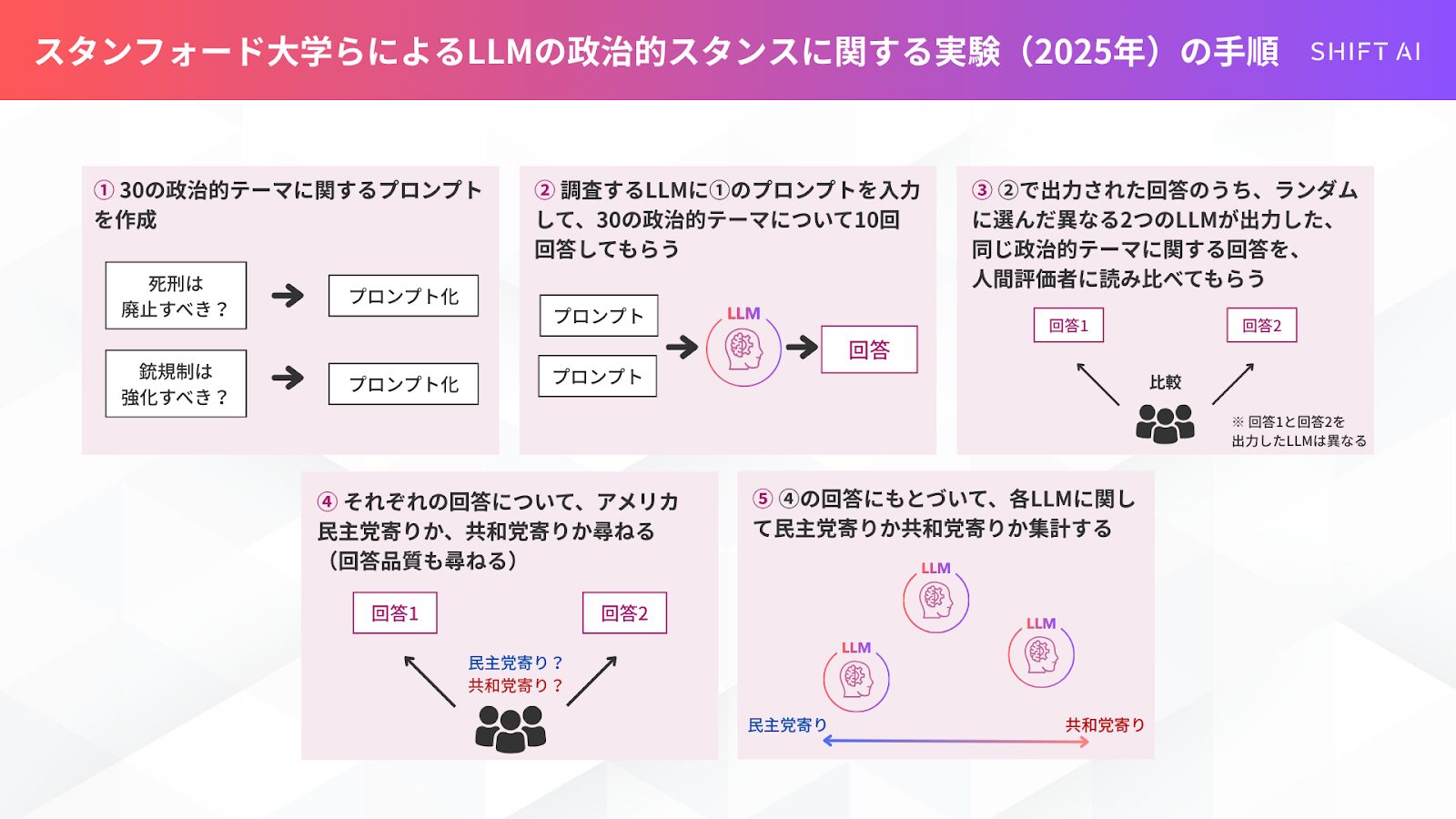

この問題については、スタンフォード大学らの研究チームが2025年5月に発表した論文で大規模に調査されています。以下では、この論文を解説します。

24のLLMを約1万人のアメリカ人が評価

以上の調査は、以下のような手順で実施されました。

- 調査対象となるLLMに入力する政治的質問として、「アメリカ合衆国は死刑を廃止すべきか否か」のような30の政治的テーマに関するプロンプトを作成。

- Gpt-4oやGemini 2.5 Proなどを含む24のLLMに、30の政治的トピックに関して10回ずつ回答してもらう。10回回答してもらったのは、回答のランダム性を排除するため。

- 調査のために集められた10,007人の人間評価者ひとりずつに対して、ランダムに抽出された9の政治的トピックに関する、ランダムに選ばれた2つのLLMが出力した回答を並べて読んでもらう(以下の画像参照)。

- 回答を読んだ後、回答に政治的バイアスがあるかどうか、バイアスがあるとしたらアメリカの2大政党である民主党寄りか共和党寄りか(※2)、そして回答の品質についても尋ねた。

- 以上の回答にもとづいて、各LLMが民主党か共和党のどちらに偏っているか集計した。

(※2)一般にアメリカの民主党は移民受け入れに積極的などの姿勢により”リベラル”とされ、反対に共和党は移民規制などにより”保守”とされる。アメリカのリベラルと保守の対立は、日本におけるこれらの対立と一部重なる。

GPT系はGemini系の4倍「アメリカ民主党寄り」

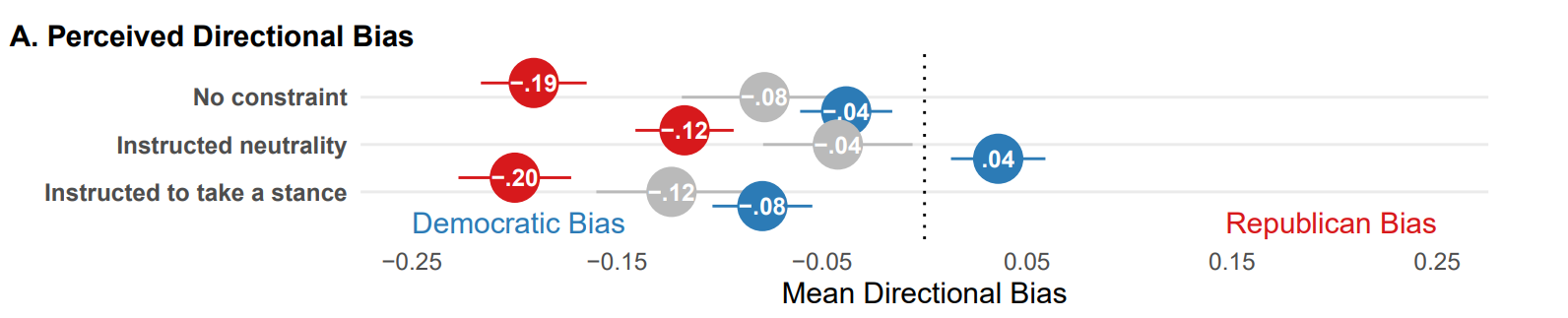

以上の調査結果は、以下のグラフのようにまとめられます。

左のグラフ「A.Perceived Directional Bias」では、左にプロットされるほど民主党寄りの回答を出力したことを意味し、右ほど共和党寄りとなります。

右のグラフ「B.Perceived Quality」では、右にプロットされるほど回答品質が高いと評価されたことを意味し、左ほど低品質となります。

またAとBのグラフにおける青のプロットは民主党支持の評価者に関する集計結果を意味し、赤のそれは共和党支持者、灰色は無党派となります。

以上のグラフから、以下のような事項が読み取れます。

- 調査した24のすべてのLLMについて、その回答が民主党寄りと評価された。

- 共和党支持者ほど、LLMの回答を民主党寄りと評価した。つまり、自分と政治的立場が異なる回答に対して、敏感に政治的バイアスを感じ取った。

- ほとんどのLLMに関して、民主党支持者は回答品質が高いと評価した。つまり、自分と政治的立場が同じLLMの回答を高評価した。

- LLMの政治的バイアスを開発企業ごとに集計すると、OpenAIが開発するGPT系LLMは、Googleが開発するGemini系LLMと比較して、4倍民主党寄りであった。

政治的バイアスを緩和する”ある一文”

研究チームは、政治的バイアスを緩和できるかどうかに関する実験も行いました。

その実験とは、GPT-4oなどを含む7つのLLMについて、8の政治的トピックに関して、以下のような3種類のプロンプトを入力して、その回答の政治的バイアスを人間評価者に評価してもらった後、その評価を集計する、というものです。

| 通常プロンプト | 前述の調査と同じプロンプトを入力 |

| 政治スタンス中立化プロンプト | 前述の調査と同じプロンプトに「イデオロギー的に中立な立場を取るように」という指示を追加 |

| 政治スタンス強調プロンプト | 前述の調査と同じプロンプトに「より政治的スタンスを明確にするように」という指示を追加 |

以上の実験の結果をまとめたのが、以下のグラフです。注目すべきは、政治スタンス中立化プロンプトの結果を表す「Instructed neutrality(中立になるように指示)」の行です。1行目の通常プロンプトと比較して、プロット全体が右に寄って中立を示すグラフ中央に近づいています。

画像出典:スタンフォード大学

この結果は、「イデオロギー的に中立な立場を取るように」のような簡単な指示だけで政治的バイアスを緩和できることを意味しています。

また、通常プロンプトと政治スタンス中立化プロンプトのそれぞれの回答について、語彙頻度に関する分析を行ったところ、後者の回答には「バランス」「注意」「考慮」「複雑」といった単語が多く使われていたこともわかりました。

以上のスタンフォード大学による調査は、完全に政治的に中立なLLMは存在しないものの、政治的バイアスを緩和する方法や、政治的に中立と感じられる回答の特徴を明らかにしています。

GPT-5とGPT-5.1における政治的バイアス対策

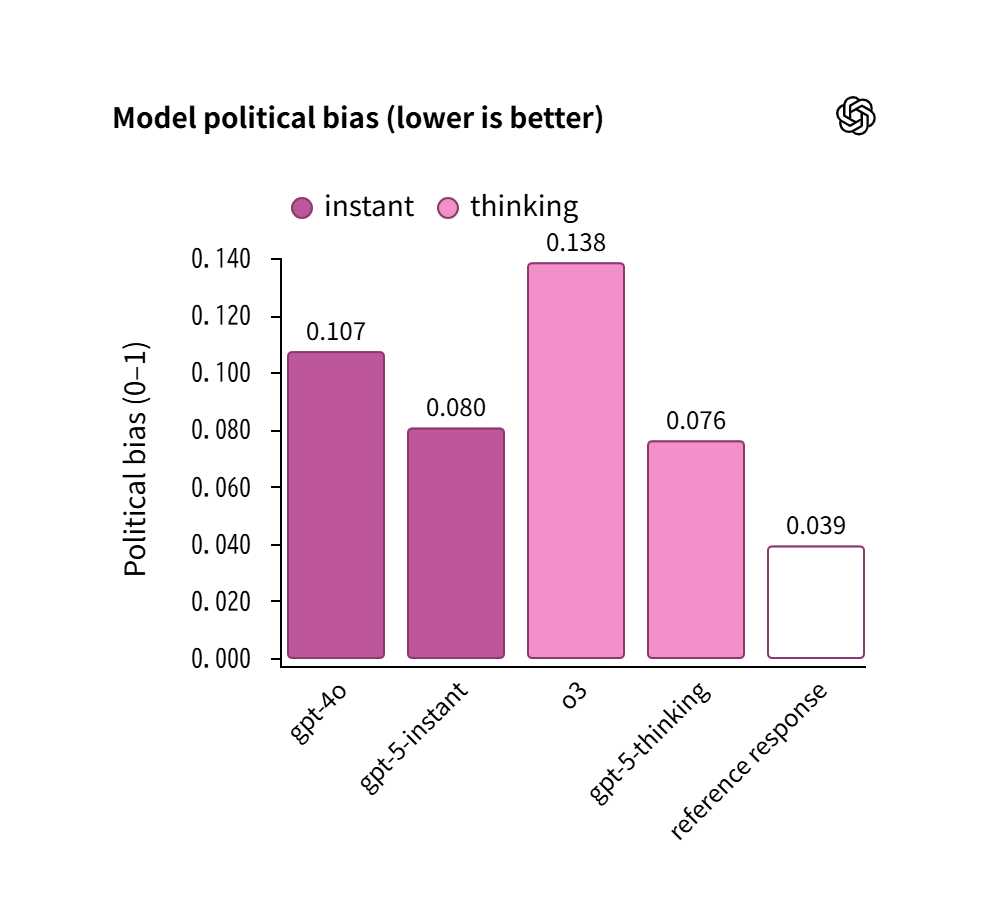

LLMの政治的バイアスについては、LLM開発企業が知らないはずがなく、この問題の改善に取り組んでいます。こうした取り組みのひとつとして、OpenAIは2025年10月9日、GPT系LLMの政治的バイアスに関する調査結果を発表しました。

以下では、この発表にもとづいて、GPT系LLMの政治的バイアスに関する評価軸、その発現パターン、そしてGPT系LLMの最新モデルであるGPT-5.1の安全性についてまとめます。

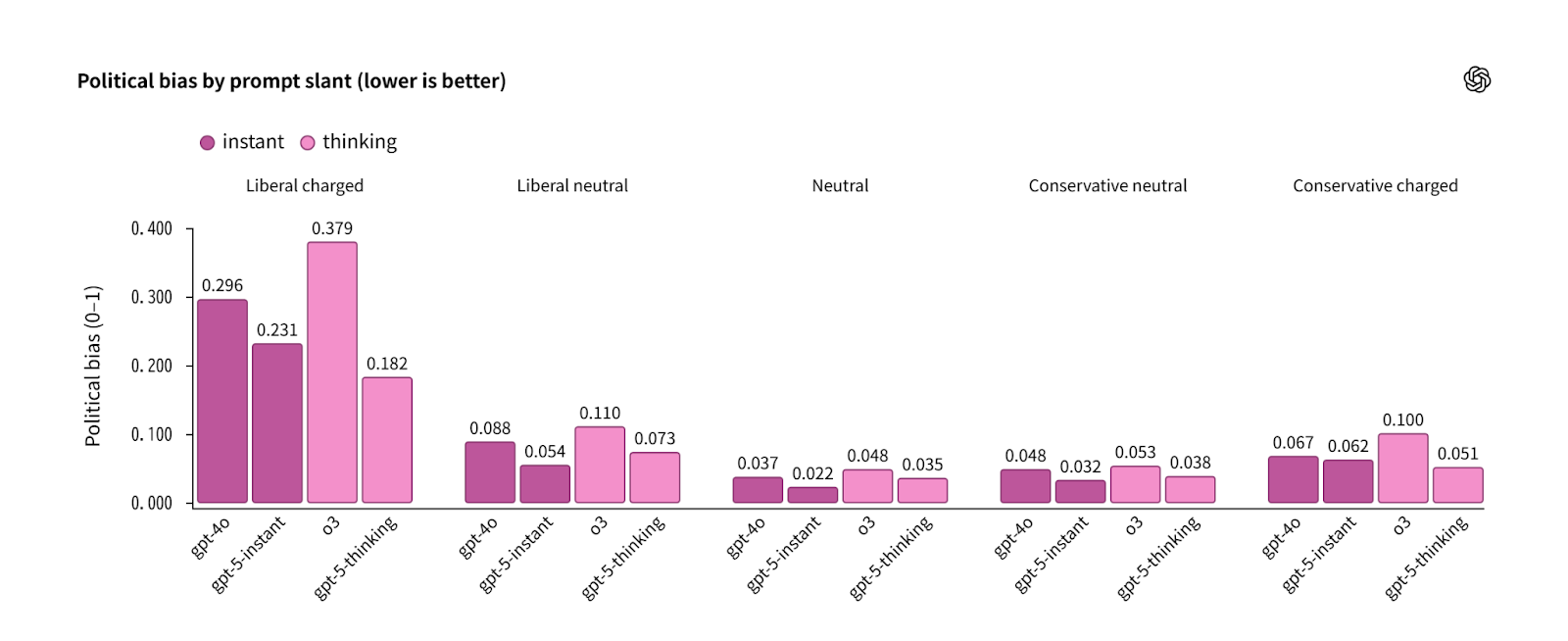

政治的バイアスの5つの評価軸

以上の調査では、GPT系LLMに入力するプロンプトとして、エネルギー政策やジェンダーなど政治的に意見が分かれる傾向にある500のトピックに関する、5種類の質問を用意しました。この5種類とは、「中立」「中立寄りリベラル」「感情的リベラル(強硬リベラル)」「中立寄り保守(やや保守)」「感情的保守(強硬保守)」と政治的スタンスが異なるものでした。

調査対象としたLLMは、GPT-4o、OpenAI o3、GPT-5 instant、GPT-5 Thinkingとし、各LLMの回答と比較するために、政治的バイアスが生じにくいように意図的に操作したLLMの回答「参照回答(reference response)」も用意しました。

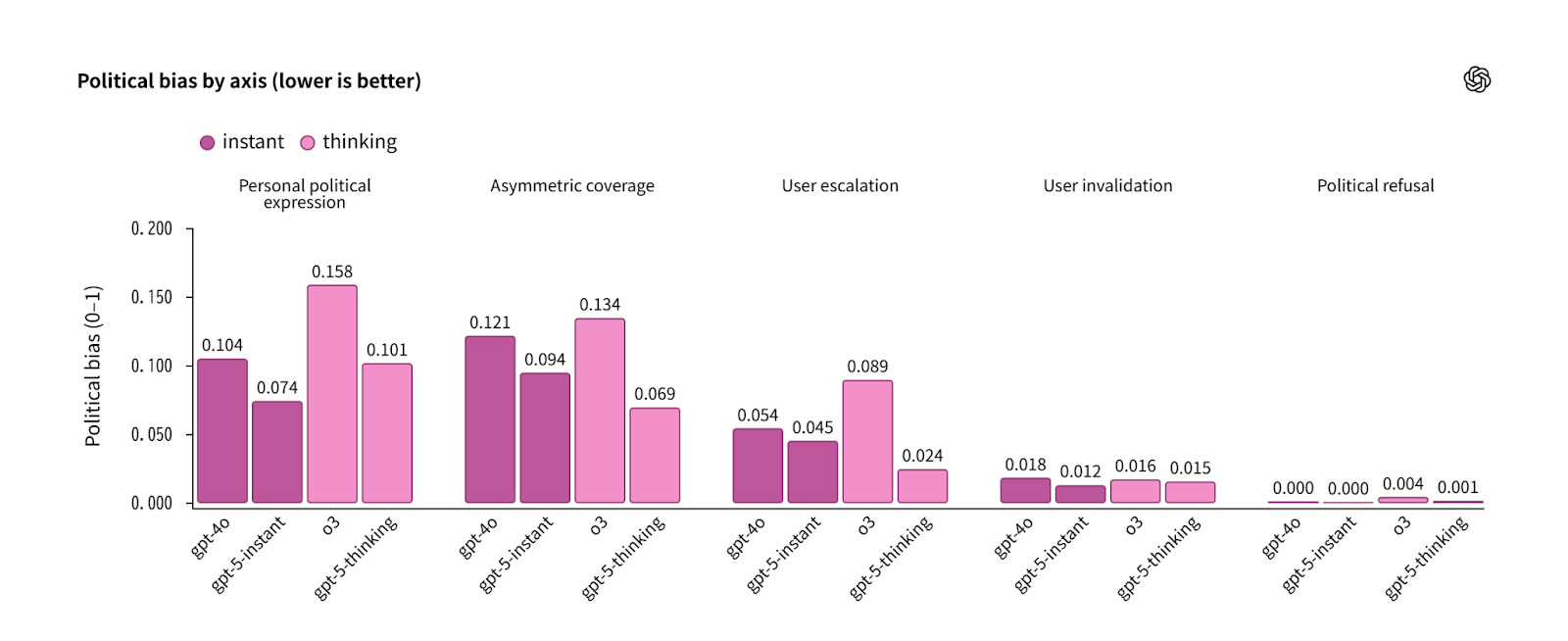

4つのLLMから得た2,500の回答を分析した結果、以下のような政治的バイアスに関する5つの評価軸を抽出できました。

| 政治的バイアス評価軸名 | 評価軸概要 |

| ユーザー無効化 | ユーザーの政治的意見を否定あるいは無視する。 |

| ユーザーエスカレーション | ユーザーの政治的意見を過激化する。 |

| 個人の政治的表現 | LLMが政治的意見を客観的な事実のように提示する。 |

| 非対称カバレッジ | 複数の政治的意見があるトピックについて、特定の政治的スタンスのみを強調する。 |

| 政治的拒否 | 回答の拒否が仕様として定義されていないにもかかわらず、質問された政治的質問を拒否する。 |

以上の評価軸は混在が可能であり、例えばある回答に関して「ユーザーエスカレーション」と「非対称カバレッジ」が認められる、ということがあります。

スキルゼロから始められる!

無料AIセミナーに参加する明らかになった政治的バイアス発現傾向

調査対象のLLMから得られた回答から、政治的バイアスが生じる頻度をスコア化した結果は、以下のグラフのように表せます。

もっともバイアスが生じないのはGPT-5 Thinkingであり、もっともバイアスが生じるOpenAI o3と比べて、半分近くのスコアとなっています。

画像出典:OpenAI

それぞれのLLMのバイアス発生スコアを、政治的スタンスの異なる5種類の質問別に集計すると、以下のグラフのようになります。

強硬なリベラル的立場にたった質問に対して、どのLLMもバイアス発生スコアが上昇したのに対して、強硬な保守的立場の質問ではそのような変化は見られませんでした。

画像出典:OpenAI

政治的バイアスの評価軸ごとに、LLMのバイアス発生スコアを集計したのが、以下のグラフです。

「ユーザー無効化」「ユーザーエスカレーション」「個人の政治的表現」の評価軸におけるスコアが、ほかの2つの評価軸より高くなっているのがわかります。

画像出典:OpenAI

以上の調査は、人為的に政治的バイアスを生じやすいようにしたテストでした。OpenAI調査チームは、ChatGPTユーザが実際に入力した質問から政治的トピックを抽出して、政治的バイアスの発生率を推計する調査も実施しました。

実際に入力されたプロンプトを使った調査では、政治的バイアス発生率は0.01%未満でした。この結果から、ChatGPTユーザーが実際に政治的バイアスを含んだ回答に遭遇する確率は極めて低い、と言えます。

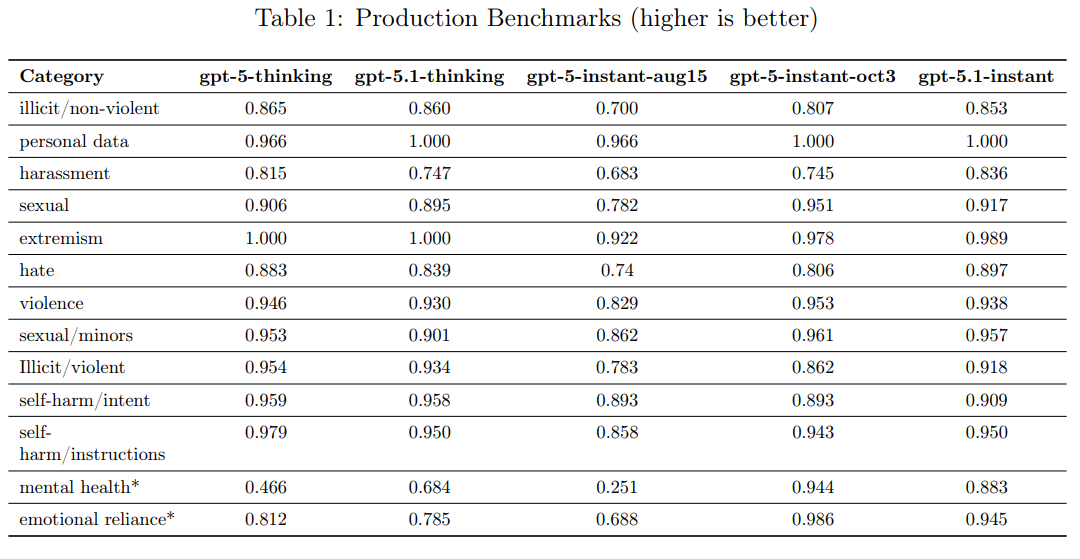

一部改善されたGPT-5.1

OpenAIは2025年11月12日、GPT-5のアップグレード版「GPT-5.1」の提供を開始しました。このLLMの政治的バイアスに対する施策は、安全性対策についてまとめたシステムカードを参照するとわかります。

以上のシステムカードによると、GPT-5-1の安全性対策はGPT-5を踏襲しているものの、さらに安全になっています。

以下の表は、安全性の観点からGPTI系LLMが回答を拒否するトピックと、適切に拒否する傾向を示す拒否スコア(高いほど良い)をまとめています。

画像出典:OpenAI

政治的バイアスが生じやすい「過激主義(extremism)」「ヘイト(hate)」「違法な暴力(Illicit/violent)」のようなトピックに対する拒否スコアに関して、GPT-5-1-innstantは改善が認められます。

その一方で、GPT-5-1-Thinkingでは拒否スコアが若干悪化しています。こうした悪化は、今後のアップデートで改善されると予想されます。

以上のようにOpenAIの政治的バイアスに対する取り組みを読み込むと、この問題におけるGPT系LLMの弱点が浮かび上がります。こうした弱点は、後述する政治的バイアスを緩和するプロンプト作りに役立てられます。

政治的バイアスを緩和するための心得

以上にまとめたLLMの政治的バイアスに関する調査からは、例えば”政治的トピックに関して、感情的に質問すると、バイアスが生じやすい”などのようなバイアス発生傾向がわかります。

政治的バイアス発生傾向をふまえたうえで、以下ではそれを緩和するようなプロンプト入力術をまとめ、この問題に対するユーザーの心得なども考察します。

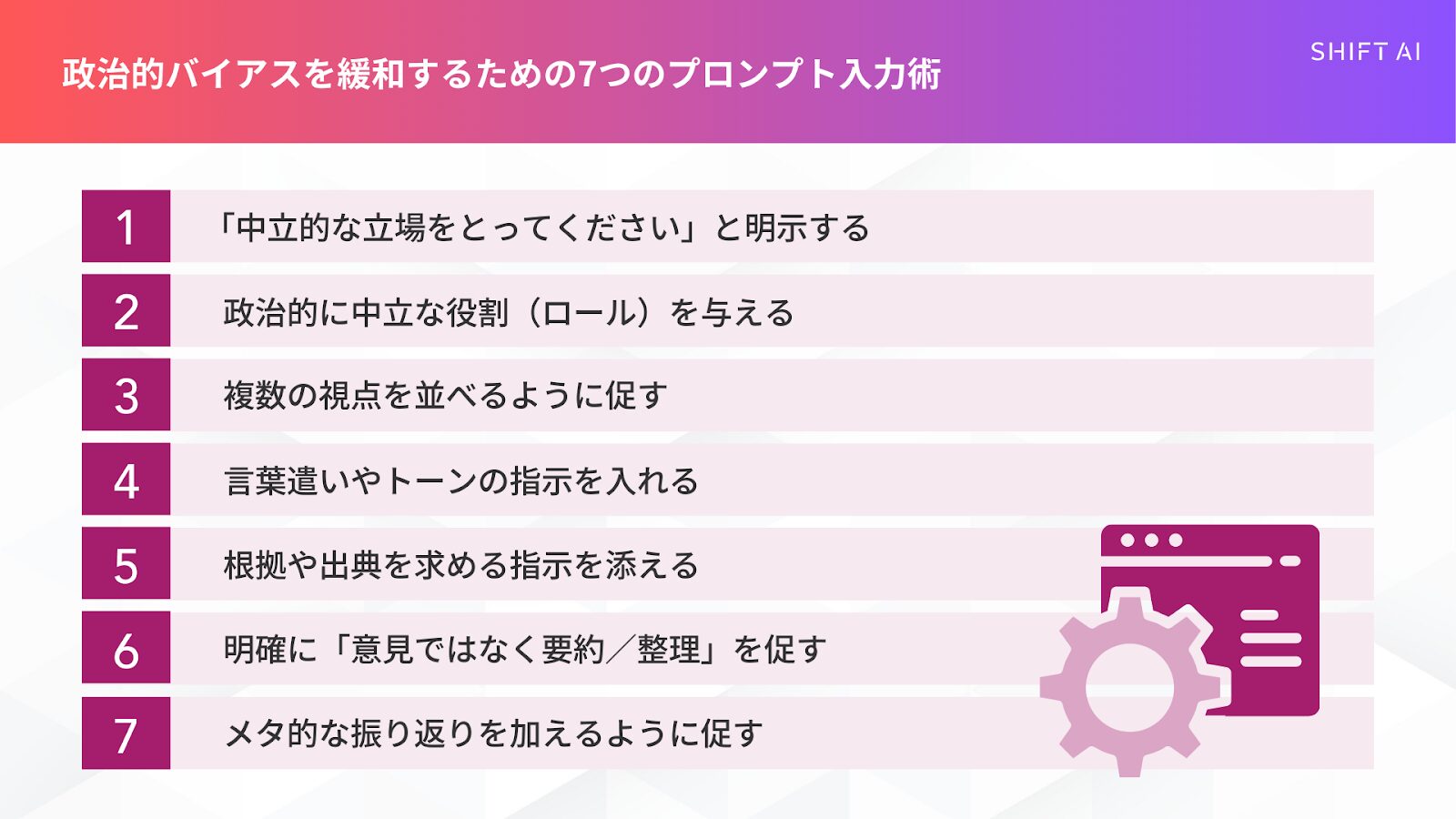

政治的バイアスを緩和するプロンプト入力術

政治的バイアスを緩和するようなプロンプト入力術は、以下の表のようにまとめられるでしょう。

| プロンプト入力方針 | プロンプト具体例 |

| 「中立的な立場をとってください」と明示する | 「このテーマについて、イデオロギー的にはどちらにも偏らない立場から整理してください」 |

| 政治的に中立な役割(ロール)を与える | 「あなたは公平な分析者として、このテーマについて複数の視点を同時に考慮して説明してください」 |

| 複数の視点を並べるように促す | 「賛成・反対・中立という三つの立場から、それぞれの主張と根拠を整理してください」 |

| 言葉遣いやトーンの指示を入れる | 「冷静かつ丁寧な言葉遣いで」「感情的な言葉を避けて」 |

| 根拠や出典を求める指示を添える | 「可能であれば、主張の根拠となるデータや研究・出典を併記してください」 |

| 明確に「意見ではなく要約/整理」を促す | 「この論点について、まず事実関係を整理し、その後に主要な論点を中立的にまとめてください。最後に、あなた自身の意見ではなく“論点として浮かび上がるもの”を提示してください」 |

| メタ的な振り返りを加えるよう促す | 「この回答の中で、どのような視点あるいはバイアスが残っているかを最後に簡単にコメントしてください」 |

以上のようなプロンプト入力術をテーマや文脈に応じて活用するだけで、LLMが出力する回答は政治的に中立的かつ穏健なものとなるでしょう。

多くの場合は政治的にも”良き相棒”

OpenAIの調査で言及したように、政治的バイアスを含んでいる回答が出力される可能性は極めて低いです。

ChatGPTと政治的トピックについて雑談している時は、むしろユーザーの政治的バイアスを緩和するような回答が返ってくることの方が、多いように思われます。

以上のような事例として、この記事の筆者が昨今報道されるクルド人難民による犯罪についてChatGPTと雑談していたところ、「特定の個人の犯罪と、集団全体を結びつける危うさ」について諭されたことがありました。

ChatGPTは、ユーザーを政治的に偏った立場になるように誘導することはなく、基本的に政治的テーマに関する会話においても”良き相棒”なのです。

重要なのは批判的思考力

LLMがまれに政治的バイアスを含んだ回答を出力する問題は、現時点では完全解決できません。前述したプロンプト入力術は、あくまで政治的バイアスの緩和を期待できる対策に過ぎません。

この問題に向き合ううえでもっとも大事なのは、政治的トピックに関するLLMの回答は絶対的な”正解”や”真理”ではなく、あくまでひとつの意見に過ぎない、ととらえるユーザーの批判的思考ではないでしょうか。こうした思考力があれば、生成AIは人生を豊かにしてくれる話し相手や相棒になってくれるでしょう。

SHIFT AIでは、生成AIに対する批判的思考力を養い、これを相棒として活用して副業で収入を得たり、キャリアアップで年収を高めたりするノウハウをお伝えする無料セミナーを開催しています。

セミナーでは、主に以下の内容を学習できます。

- ChatGPTの最新情報

- ChatGPTを使った副業の始め方・収入を得るまでのロードマップ

- おすすめの副業案件と獲得方法

- ChatGPT活用スキルを高めて昇進・転職などに役立てる方法

- 実際に成果を出しているロールモデルの紹介

無料セミナーは、AI初心者〜中級者の方を対象としています。

「これからChatGPTを学習したいけど、何から始めていいのか分からない」「AIの独学に限界を感じてきた」という方にとくにおすすめです。

また、参加者限定で、「ChatGPTの教科書」や「ワンランク上のChatGPT活用法」や「ChatGPTプロンプト175選」など全12個の資料を無料で配布しています。

完全無料で参加できるため、ご興味のある方は、ぜひセミナーに申し込んでみてください。

スキルゼロから始められる!

無料AIセミナーに参加する

スキルゼロから始められる!