日本における生成AIの規制状況は?世界の動向や企業に求められる対応まで網羅

生成AIがビジネスの現場で急速に浸透する一方、世界各国では生成AIを規制する動きが広まっています。

「日本でも生成AIが規制されたらどうしたら良いのだろう…」

「生成AIのリスクや規制に対応するためには何をすれば良いのかわからない…」

といったように、生成AIの規制やリスクに備えた、長期的なAI活用戦略に頭を悩ませている企業も少なくないはずです。

生成AIの規制やリスク対策に無関心のままAI技術を導入すると、法的なリスクや信頼性の低下といった深刻な問題に直面しかねません。

また、プライバシー保護やデータ管理の不備によって顧客の信頼を失うこともあります。

本記事では、世界各国の生成AIに関する規制の動向から、日本における最新の規制状況、さらに企業が取るべき具体的な対応策まで詳しく解説します。

この記事を読むことで、生成AIをビジネスに取り入れる上でのリスクを回避し、規制に適応した体制を整えることができるようになるでしょう。

結果として、法的リスクを最小限に抑えながら、信頼できるAI活用企業としてのブランド価値を高める未来が見えてくるはずです。

生成AIの活用にはさまざまな問題点があります。

監修者

SHIFT AI代表 木内翔大

「質の高いプロンプトでAIの能力をもっと引き出したい」「プロンプトのコツを知りたい」という方に向けて、この記事では「【超時短】プロンプト150選」を用意しています。

この資料ではジャンル別に150個のプロンプトを紹介しています。また、プロンプトエンジニアリングのコツも紹介しており、実践的な資料が欲しい方にも適しています。

無料で受け取れますが、期間限定で予告なく配布を終了することがありますので、今のうちに受け取ってプロンプトをマスターしましょう!

目次

生成AIの規制や法制化は世界各国で進んでいる

生成AIは、短期間で飛躍的な進歩を遂げ、社会や経済のさまざまな分野で利用が進んでいます。

しかし、その急速な技術発展に伴い、世界各国で規制や法制化の必要性が強く認識されはじめました。

技術の進展がもたらすメリットを享受する一方で、プライバシー侵害や倫理的な問題が懸念されていることもあり、各国で生成AIの規制や法制化が進められています。

ここでは、生成AIの規制や法制化に関する世界各国の動向について紹介していきます。

以下の記事では、生成AI自体・ユーザー側の問題点や解決策、事例を紹介していますので、ぜひこの機会にチェックしてください。

生成AIの問題点やデメリット6選!解決策・実際の事例を解説

生成AIでの情報漏洩やフェイクニュースを耳にする今日。問題点やデメリット、解決策を知らないままでは危険です。しかしリスクだけ見ては、業務効率や生産性は向上しません。本記事では、生成AIの主要な6つの問題点と解決策、実際の事例を解説します。

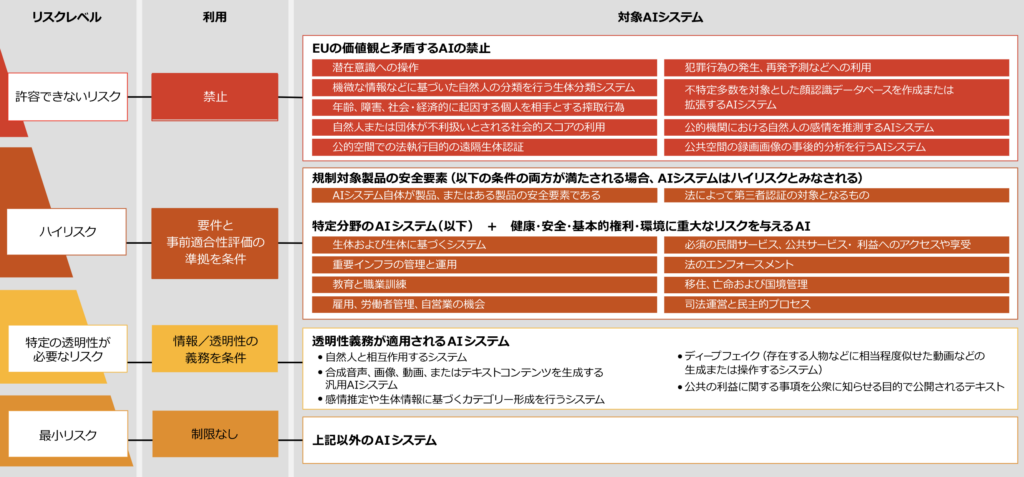

EUでは「欧州AI規制法」が成立

EUは、生成AIを含む人工知能技術の急速な発展に対応するため、2024年5月に「欧州AI規制法」(Artificial Intelligence Act)を成立させました。

この法律は、AI技術の開発と利用におけるリスクを抑制し、倫理的で安全な技術活用を促進することを目的としています。

出典:「欧州(EU)AI規制法」の解説

欧州AI規制法は、AIシステムをリスクレベルに応じて以下4つに分類し、それぞれに異なる規制を適用する点が特徴です。

- 「許容できないリスク」

- 「ハイリスク」

- 「特定の透明性が必要なリスク」

- 「最小リスク」

この法律の背景には、AIによる人権侵害やプライバシーの侵害、データの不正利用が深刻な問題となっていることが挙げられます。

とくに、高リスクとされる分野(例:公共インフラ、法執行、雇用関連)においては、透明性と説明責任を強化することが求められています。

また、許容されないリスクに該当するAIシステム(例:社会的信用スコアリングシステムなど)は、使用が全面的に禁止されている点もポイントです。

たとえば、高リスク分野でAIを利用する企業は、事前に厳格なリスク評価を行い、当局への報告を義務付けられます。これにより、AIが引き起こすリスクを最小限に抑え、消費者や市民の安全を確保することが狙いです。

この規制法の成立により、EU内の企業やAI開発者は、より慎重な技術開発が求められるようになりました。

EU市場で事業を展開する日本企業にとっても、この法規制に対応したAI技術の導入やリスクマネジメント体制の構築が急務となっています。

G7各国が生成AIの国政指針「広島AIプロセス」に合意

2023年5月に開催されたG7広島サミットにおいて、G7各国は、生成AIを含むAI技術の規制や倫理的利用に関する共通の枠組みを目指す「広島AIプロセス」に合意しました。

このプロセスは、生成AIの急速な進展に伴うリスクに対処し、国際的な協力のもとでAI技術の安全かつ責任ある利用を推進することを目的としています。

とくに、生成AIがもたらすデータプライバシーやセキュリティ、誤情報拡散の問題に対する規制強化が求められています。

広島AIプロセスの主なポイントは以下の2点です。

- 生成AIの開発と利用において透明性と説明責任を確保

- リスクを評価し、リスクのあるAI技術に対する規制や指導を行うための国際的な基準を策定

G7各国は、生成AIが社会に与える影響を考慮しつつ、技術革新と規制のバランスを保ちながら共通のルール作りを進める意向を示しました。

たとえば、生成AIがフェイクニュースの拡散やディープフェイクの作成に悪用される懸念に対して、各国はAI技術の倫理的な利用に重点を置いた規制を強化する方針としています。

この合意は、国際的な協調をもとに生成AIを健全に活用しつつ、技術の発展と人権保護、社会的安全の維持を両立させるものと言えます。

参考:広島AIプロセス

日本における生成AIの規制状況は?

日本における生成AIの規制は、世界的な動きと歩調を合わせつつも、技術革新と社会的影響のバランスを取りながら進展しています。

日本政府は、AI技術の利活用を推進する一方で、プライバシー保護やデータの適切な管理に関する規制の強化に取り組んでいます。

しかし、欧州のように厳格な規制を導入するというよりも、ガイドラインや自主的な枠組みを通じて、企業や研究機関の自主規制を促進するアプローチをしているのが現状です。

その背景には、生成AIが持つ技術的な可能性を最大限に活用し、国内産業の競争力を強化する意図があります。

たとえば、生成AIは教育や医療、製造業といったさまざまな分野で革新をもたらすと期待されている一方で、誤情報やフェイクコンテンツの作成、個人情報の乱用といったリスクも併存しています。

これに対応するため、日本政府は規制と技術開発のバランスを保ちつつ、技術の社会的な影響を最小限に抑える取り組みを進めているのです。

日本では、AI技術の利活用においてガイドラインが重要な役割を果たしており、企業や団体はこれらのガイドラインに従って技術開発や運用を進めることが推奨されています。

生成AIの透明性や説明責任を確保し、プライバシー保護やデータの適正利用に取り組みつつも、国内外の規制動向を常に把握しながら、適切な対応を取ることが、日本企業にとって重要な課題と言えるでしょう。

日本政府が策定したAIガイドライン

日本政府は、AI技術の倫理的な使用や安全性を確保しつつ、社会におけるAIの活用を支援することを目的として、いくつかのAIガイドラインを策定しています。

- AI利活用ガイドライン

- AI開発ガイドライン

- AI事業者ガイドライン

本章では、日本政府が公開しているAIガイドラインについて詳しく紹介していきます。

AI利活用ガイドライン

「AI利活用ガイドライン」は、AI技術の利活用を促進しつつ、そのリスクを適切に管理し、安全で安心な社会実装を目指すために総務省により策定されました。

このガイドラインの目的は、AIが社会に広く受け入れられる形で利用されるための指針を提供することにあります。

基本理念として「人間中心のAI社会の実現」「利用者の多様性の尊重」「AIの適切な社会実装の促進」が掲げられ、これらを基にAI技術が社会のニーズに合致する形で利用されることが推奨されています。

ガイドラインでは、AIの利用者が留意すべき10の利活用原則として以下の内容が示されています。

- 適正学習の原則

- 適正利用の原則

- 連携の原則

- 安全の原則

- セキュリティの原則

- プライバシーの原則

- 尊厳・自律の原則

- 公平性の原則

- 透明性の原則

- アカウンタビリティの原則

ガイドラインでは、「個人情報や機密情報をAIに入力しない」「生成された内容の正確性を確認する」など、具体的な留意事項も強調しているのでガイドラインを一通り読んで確認しましょう。

また、組織的な対応も不可欠であり、利用者向けの研修を実施し、AI技術の正しい活用方法を習得させることが重要とされています。

参考:AI利活用ガイドライン

AI開発ガイドライン

「AI開発ガイドライン」は、総務省がAI技術の開発に関する倫理的な基準や技術的な要件を示した指針です。

このガイドラインは、AI技術の開発者が技術革新を進める際に、社会的な影響やリスクを適切に考慮し、透明性のある技術開発を行うための枠組みを提供しています。

ガイドラインでは、AIの開発者は技術の設計段階から倫理的な側面を考慮し、開発したAIシステムが誤って人権を侵害することがないよう注意を払う必要があるとされています。

また、AIシステムが自動で意思決定を行う場合、その根拠やアルゴリズムが十分に説明可能であり、社会的に信頼されるものであることが求められます。

たとえば、AI技術を開発する企業は、データの公正性を確保し、差別や偏りが含まれない形でAIを学習させることが重要です。技術の透明性を維持するために、開発プロセスにおける検証手順やリスク評価が厳密に行われる必要もあります。

AI開発ガイドラインをもとにAI技術を開発することで、社会的に信頼されるAI技術の開発が可能となり、企業や研究機関が安心してAI技術を導入できる環境が整備されることが期待されています。

AI事業者ガイドライン

「AI事業者ガイドライン」は、総務省と経済産業省が共同でAI技術を利用する事業者や、AI開発者、AI提供者も対象に策定したものです。

ガイドラインは、「人間の尊厳が尊重される社会」「多様な背景を持つ人々が多様な幸せを追求できる社会」「持続可能な社会」という3つの基本理念を掲げており、AI技術が社会に与える影響に対して多面的に配慮した内容となっています。

また、AI技術の開発・提供・利用における以下の主要な7つの原則が示されています。

- 「人間中心」

- 「安全性」

- 「公平性」

- 「プライバシー保護」

- 「セキュリティ確保」

- 「透明性」

- 「アカウンタビリティ(説明責任)」

これらの原則は、AI技術がもたらす社会的なリスクを最小限に抑え、技術が社会にとって有益かつ信頼できるものとなるようにすることを目指しています。

とくに、プライバシー保護とセキュリティ確保は、生成AIを含むAI技術の利用が拡大する中で重要なテーマであり、透明性や説明責任の確保は、AIがどのように意思決定を行っているかをユーザーが理解しやすくするために不可欠です。

AI事業者ガイドラインは「広島AIプロセス」など、国際的なAI規制や議論も反映しており、日本国内でのAI技術の開発・利用にとどまらず、グローバルな視点を持つ企業にとっても有益な指針となっています。

これにより、日本のAI事業者や開発者は、国際的な競争力を維持しつつ、倫理的かつ責任あるAI技術の活用を進めることが可能です。

生成AIの規制が広がる中、企業に求められる対応は?

生成AIの規制が世界的に拡大する中、企業に求められる対応はますます重要になっています。

企業は生成AIの利用に伴うリスクを管理し、法的・倫理的な責任を果たすために、複数の側面で体制を整える必要があるでしょう。

- 日本政府のAIガイドラインをもとに、自社のガイドラインを策定する

- 各国の規制動向を把握し、対応する体制の構築

ここでは、企業が対応すべき、とくに重要な上記2点の事項に関して詳細に説明していきます。

日本政府のAIガイドラインをもとに、自社のガイドラインを策定する

企業が生成AIを活用する際は、企業が適切に生成AIを運用し、法令や社会的な責任を守るためにも、日本政府が策定したAIガイドラインをもとに、自社独自のガイドラインを策定することが重要です。

日本政府のAIガイドラインは、AI技術の透明性や公正性、プライバシー保護などを強調しており、これにもとづいて企業は自社のビジネスモデルや利用目的に合わせたルールを整備する必要があります。

たとえば、データの使用方法や生成されたコンテンツの品質基準、さらにAIシステムの運用体制を明確にすることが必要でしょう。

企業は、日本政府のガイドラインをしっかり理解した上で、自社に適した形でルールを整備し、組織全体で遵守することが不可欠です。

各国の規制動向を把握し、対応する体制の構築

生成AIの急速な普及に伴い、世界各国で規制の整備が進んでおり、企業はその動向を正確に把握し、適切に対応することが求められます。

欧州連合(EU)では、生成AIに対する厳格な規制法である「欧州AI規制法」が施行されており、AIの利用に関する透明性、説明責任、安全性が強く求められています。

こうした国際的な規制は、生成AIの開発や活用を行う企業に大きな影響を与えるため、常に最新の動向を追う必要があります。

まず、企業は自社が事業を展開する国や地域ごとのAI規制を把握し、それぞれの法令に従うための体制を整備することが不可欠です。

グローバル企業にとっては、国ごとに異なる規制に柔軟に対応するための統一的なガバナンス体制の整備が重要です。

たとえば、企業が欧州で生成AIを運用する場合には、透明性を確保しつつ、プライバシーやセキュリティを重視した規制遵守が求められます。

一方で、アジアや北米では異なる規制に準拠しなければならず、これに応じた体制や手順を整備することが必要です。

このように、対応体制を構築することで、企業は規制リスクを回避し、生成AI技術をより安心して活用できる環境を整えることができるでしょう。

規制やリスクに対応できるよう、ガイドラインを参考に安全な活用を

生成AIの利用が拡大する中、世界各国で規制の強化が進んでおり、企業はそのリスクに対応するための適切な対策が求められています。

プライバシー保護やデータ管理、倫理的なAI活用を行うためにも、組織全体で日本政府が公開しているガイドラインや規制にもとづいた取り組みを進めることが、生成AIの活用において不可欠と言えるでしょう。

また、各国の規制動向を適切に把握し、柔軟に対応するための体制を整えることも、企業にとっての大きな課題です

これにより、企業は法令遵守を確実に行ない、競争力を維持することが可能となります。

ガイドラインと法規制を適切に活用し、リスクを的確に管理することで、企業は生成AIを安全に導入できます。これにより、社会からの信頼を維持しつつ、持続可能な成長を実現することが可能となります。

「質の高いプロンプトでAIの能力をもっと引き出したい」「プロンプトのコツを知りたい」という方に向けて、この記事では「【超時短】プロンプト150選」を用意しています。

この資料ではジャンル別に150個のプロンプトを紹介しています。また、プロンプトエンジニアリングのコツも紹介しており、実践的な資料が欲しい方にも適しています。

無料で受け取れますが、期間限定で予告なく配布を終了することがありますので、今のうちに受け取ってプロンプトをマスターしましょう!

30秒で簡単受取!

無料で今すぐもらう執筆者

Chie Suzuki

SEO・インタビューライター歴4年以上。

AIを活用し、情報収集やライティングの時間を半分以上削減。

最近は動画生成AIで遊ぶのが趣味です。

30秒で簡単受取!

無料で今すぐもらう