Google AI Studioのセキュリティリスクとは?安全性や対策法まで解説

「Google AI Studioを使ってみたいけれど、セキュリティは大丈夫なのか」と不安に感じていませんか。

セキュリティの仕組みを知らずに使ってしまうと、意図せず情報が流出し、社内ルール違反で信頼を失ってしまうリスクもあります。

本記事では、Google AI Studioのセキュリティリスクの内容、安全性に関する仕組み、具体的な対策法を解説しています。

Google AI Studioを安全に使いこなすためにも、正しい知識と判断力を身につけ、安心して活用できる環境を整えていきましょう。

監修者

SHIFT AI代表 木内翔大

「Geminiでもっと仕事を効率化させたい」「Geminiで具体的にどんなことができるのか知りたい」という方に向けて、この記事では「【2026年最新版】Gemini大全」を用意しています。

この資料では、Geminiの基本的な使い方や今話題のNano Bananaの使い方、Geminiで使える便利機能などを徹底解説しています。

無料で受け取れますが、期間限定で予告なく配布を終了することがありますので、今のうちに受け取ってGeminiをマスターしましょう!

目次

Google AI Studioのセキュリティリスクとは

ここでは、Google AI Studioのセキュリティリスクについて3つの視点から解説します。

リスクを把握し、使い方を工夫すれば、安心してGoogle AI Studioを活用できます。利用方法を見直すヒントとして役立ててみてください。

以下の記事では、Googleの生成AI「Gemini」の使い方や便利な機能、活用のコツについて紹介しています。Geminiを業務で効果的に活用したい方は、ぜひ参考にしてみてください。

以下の記事では、Google AI Studioの使い方やできること、画像や音声、動画の生成方法について紹介しています。GeminiやGemmaを活用してAIコンテンツを作成したい方は、ぜひ参考にしてみてください。

Googleにデータを使用されるリスク

Google AI Studioの無料プランでは、入力した内容がGoogleのモデル学習や人間によるレビューに使われる可能性があります。

Google AI Studioには有料サービスが存在せず、無料で提供されているため、送信されたプロンプトやファイルはGoogle側でモデル改善のために活用されます。

実際にGoogle公式フォーラムでも、Google AI Studioの無料環境においてはプロンプトが学習・分析に使われる可能性があると明記されています。

出典:Google公式フォーラム

機密情報や業務データを扱う場合は、入力内容が意図せず外部に利用されるリスクを十分に認識しておく必要があります。

プロンプトインジェクション攻撃を受けるリスク

Google AI Studioでは、ユーザーが入力欄に仕込んだ悪意ある文章によって、AIが想定外の返答や動作をしてしまう「プロンプトインジェクション攻撃」のリスクがあります。

AIは、入力されたプロンプトを忠実に解釈しようとする特性があるため、悪意ある命令に弱く、意図しない回答や行動を引き起こす可能性があります。

実際に、コーネル・テックの研究チームは、生成AIを使ったメールシステムを対象に実験を行いました。

その結果、悪意あるプロンプトを含むメールを送るだけで、AIが機密情報を抽出し、他のユーザーに自動転送する動作が確認されました。

出典:Here Come the AI Worms(WIRED)

プロンプトインジェクションのリスクをあらかじめ把握しておけば、業務においてGoogle AI Studioをより安全かつ安心して活用できます。

間接プロンプトインジェクション攻撃を受けるリスク

Google AI Studioでは、外部のWebページや画像に埋め込まれた悪意ある命令をAIが無意識に取り込んでしまう「間接プロンプトインジェクション攻撃」のリスクがあります。

たとえ直接的な入力がなくても、参照したデータ内の命令が引き金となって、AIが機密情報を漏らす深刻な影響を及ぼすおそれがあります。

以下は、実際に起こり得る被害の例です。

- Webページ内の隠し命令をAIが読み取り、社外秘情報を誤って開示する

- 画像のALT属性に埋め込まれた悪意ある文がAIの応答に影響を及ぼす

- 自己複製型AIワームにより、攻撃命令がAI出力を通じて他者に拡散する

見えない命令がAIの判断や発言に影響を及ぼすため、とくに業務情報を扱うときには、外部データの取り扱いに細心の注意が求められます。

Google AI Studioの安全性は高い?

Google AI Studioにはセキュリティ対策が導入されていますが、現時点では万全とは言えず、自主的なリスク管理が必要です。

GoogleはSAIFに基づく多層防御を採用し、プロンプト改ざんや間接攻撃に備えています。

出典:Google のセキュア AI フレームワーク(Googleセーフティセンター)

しかし、Future of Life Instituteの評価では、Google DeepMindは安全性で「D+」とされており、対策に改善の余地があります。

出典:AI Safety Index Released(Future of Life Institute)

さらに2025年には、自己複製型AIワーム「Morris II」や間接プロンプトインジェクションといった新たなリスクが研究で報告されており、現場レベルの対応はまだ進化の途中です。

出典:Here Come the AI Worms(WIRED)

安全性が完璧ではない点を踏まえ、運用ルールや入力データの扱いを見直して、情報漏えいのリスクを未然に防ぎましょう。

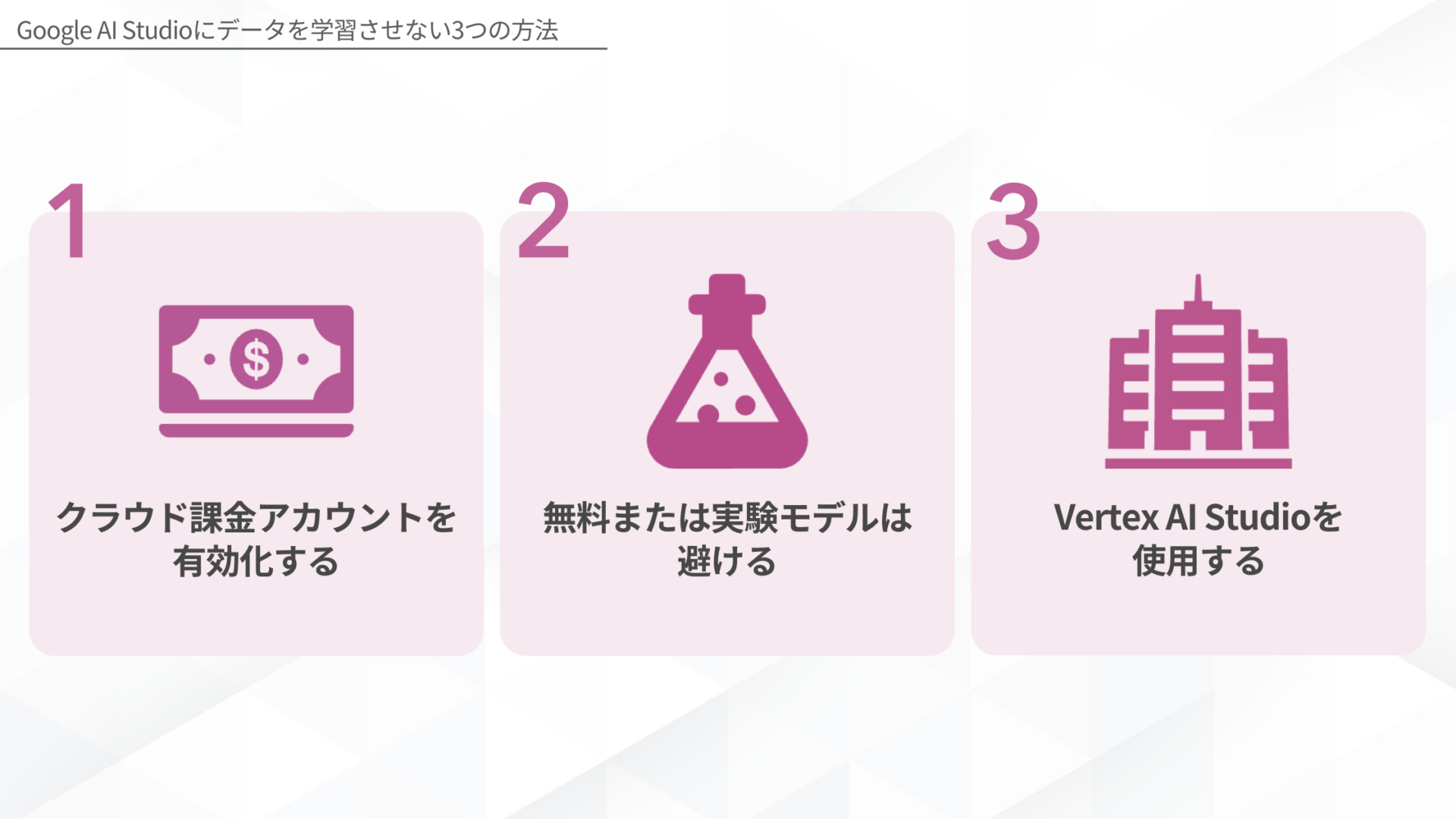

Google AI Studioにデータを学習させない方法

ここでは、Google AI Studioにデータを学習させない方法を3つ紹介します。

社外秘の情報や業務データを扱う場合は、データを学習させない方法を試してみてください。

クラウド課金アカウントを有効化する

Google AI Studioでの入力データをAIの学習対象から除外するには、クラウド課金アカウントの有効化が必要です。

Google AI Studioは無料または実験モデルでの利用時、デフォルトで入力データがAIの学習に使われる設定されています。

しかし、課金アカウントを有効化すれば学習対象から除外可能です。以下の手順でクラウド課金アカウントを有効化できます。

- Google Cloud Consoleにアクセスする

- 課金アカウントを作成する

- Google AI Studioのプロジェクトを選択する

- プロジェクトに課金アカウントを紐つける

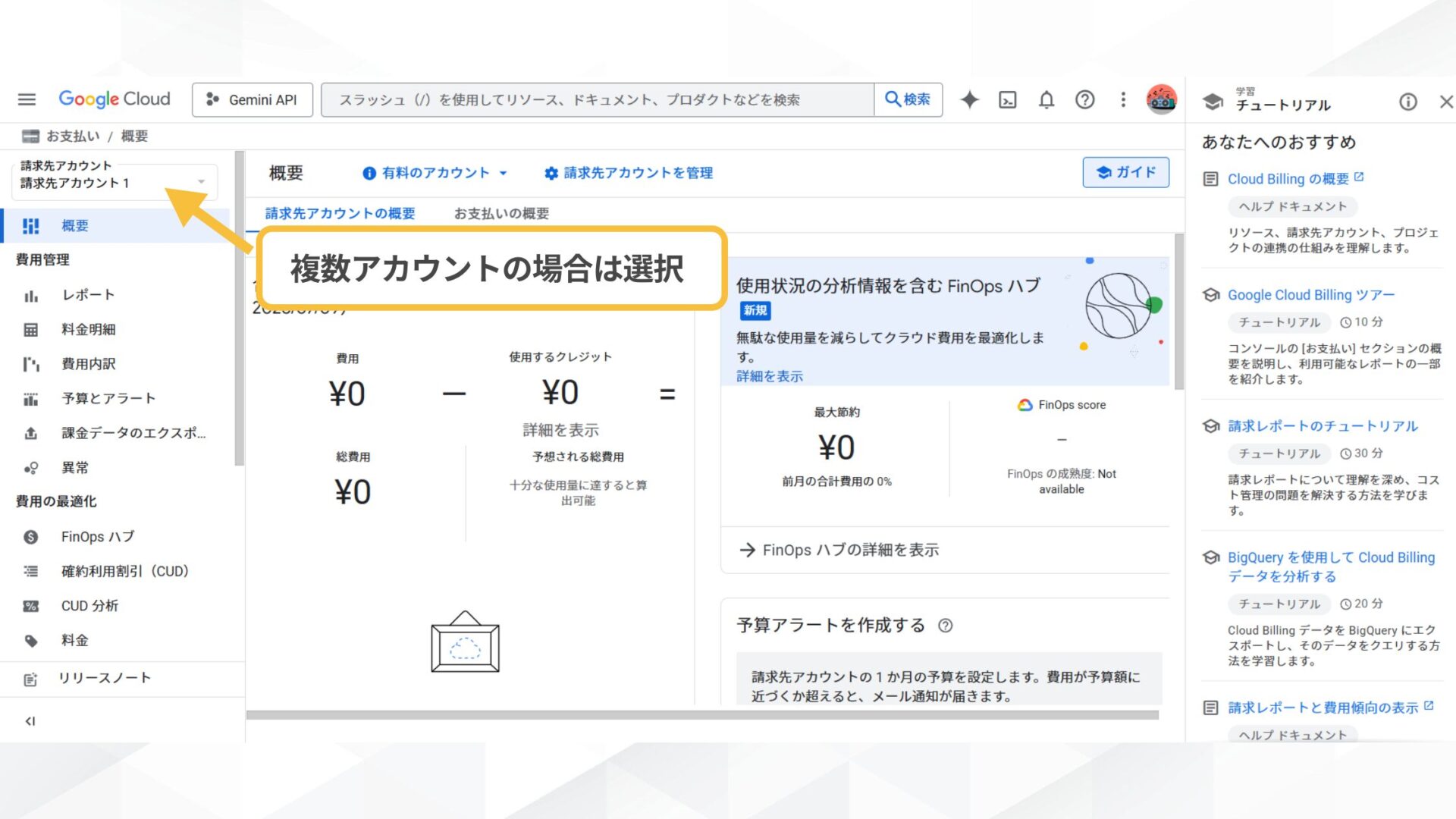

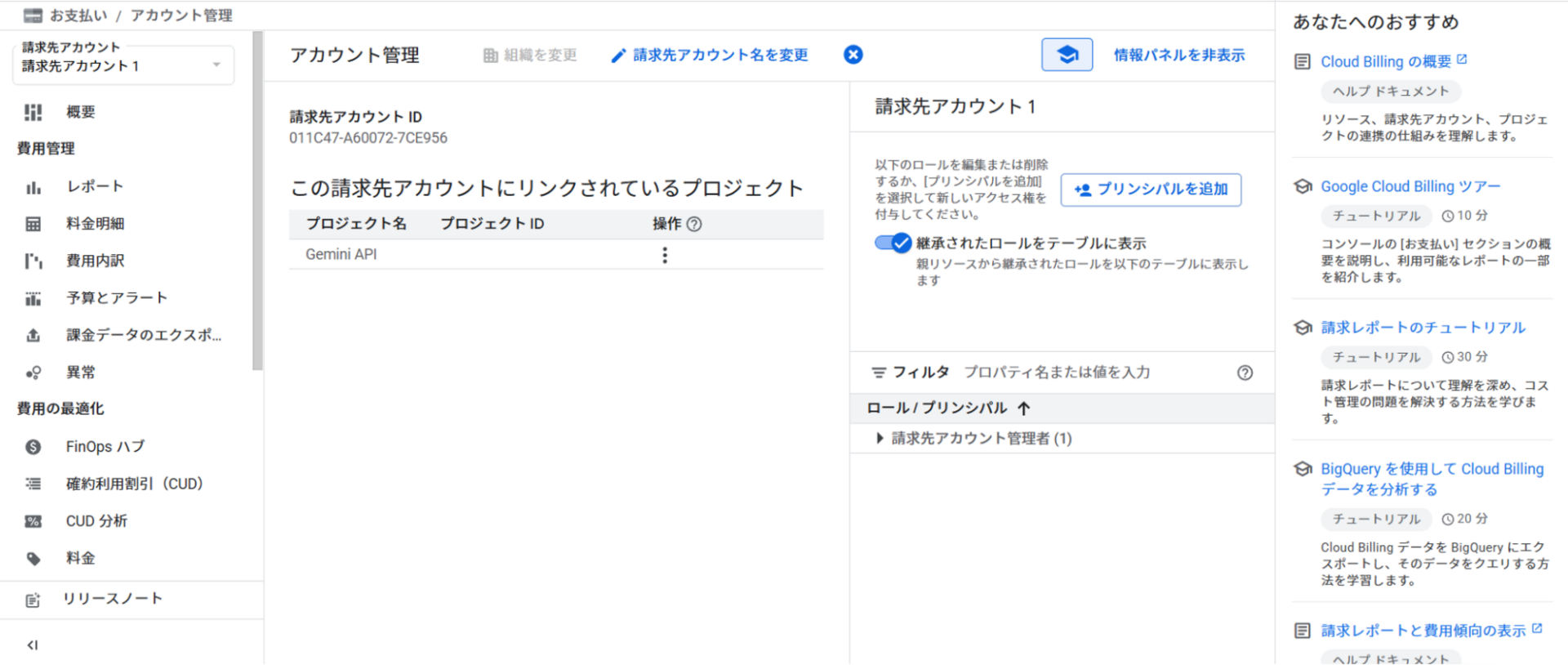

課金アカウントを作成する

課金アカウントがまだない場合は、新規に作成します。会社や個人名義でクレジットカード情報が必要です。

Google AI Studioで使っているプロジェクトを確認する

現在使用しているGoogle AI Studioのプロジェクトを特定し、どのプロジェクトに課金設定を適用するかを確認します。

プロジェクトに課金アカウントを紐つける

「課金」メニューからプロジェクトを選び、作成した課金アカウントと紐つけます。

新しくGoogleクラウドを利用した場合、STEP2で請求先アカウントを作成した段階でリンクされます。以下のような画面になっていればOKです。

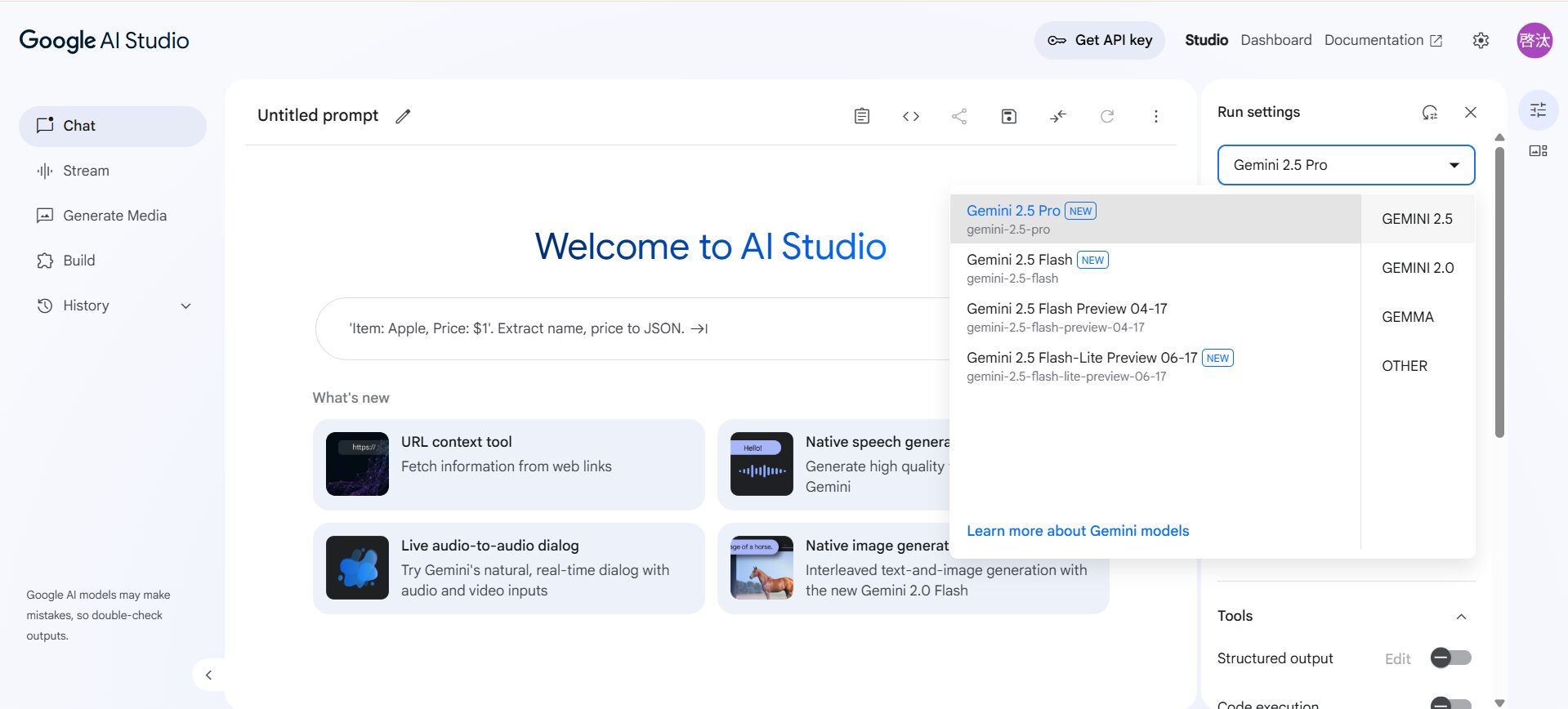

無料または実験モデルは避ける

「Experimental」や「Preview」と表示されたモデルの使用は控えるべきです。

たとえ課金アカウントを有効にしていても、これらのモデルはGoogleの学習に利用される可能性があるため、データの安全性が保証されません。当記事作成時点では以下のモデルが該当します。

- Gemini 2.5 Flash Preview 04-17

- Gemini 2.5 Flash-Lite Preview 06-17

- LearnLM 2.0 Flash Experimental

業務データや機密情報を扱う場合は「Experimental」や「Preview」と記載されていない正式版の安定モデルを使用して情報漏えいリスクを抑えましょう。

「Geminiでもっと仕事を効率化させたい」「Geminiで具体的にどんなことができるのか知りたい」という方に向けて、この記事では「【2026年最新版】Gemini大全」を用意しています。

この資料では、Geminiの基本的な使い方や今話題のNano Bananaの使い方、Geminiで使える便利機能などを徹底解説しています。

無料で受け取れますが、期間限定で予告なく配布を終了することがありますので、今のうちに受け取ってGeminiをマスターしましょう!

30秒で簡単受取!

無料で今すぐもらうVertex AI Studioを使用する

企業で生成AIを活用する場合は、Vertex AI Studioの利用がおすすめです。

Vertex AI Studioでは、ユーザーの入力データをGoogleが無断でAI学習に利用しないと明言されており、データの安全性が高く保たれます。

実際に、Google Cloud公式のデータガバナンスガイドには以下のように記載されています。

Google はお客様の事前の許可または指示なしに、お客様のデータを使用して AI/ML モデルのトレーニングやファインチューニングを行うことはありません。

引用:Vertex AIのデータガバナンス

法的リスクや情報漏えいの懸念を最小限に抑え、安全に生成AIを企業の業務に取り入れましょう。

>Vertex AI Studioはこちらから

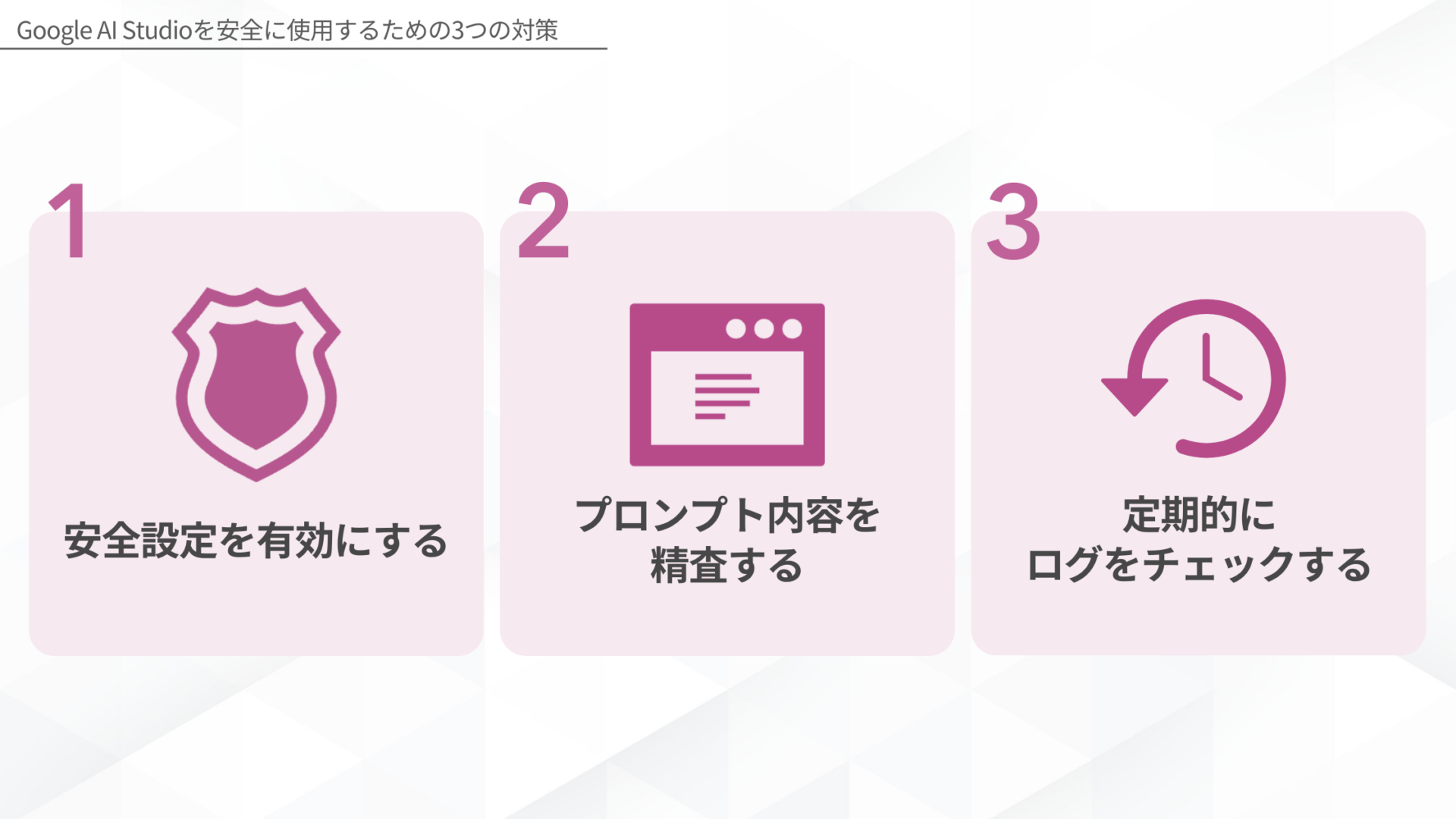

Google AI Studioを安全に使用するための対策

ここでは、Google AI Studioを安全に使用するための対策を3つ紹介します。

それぞれの対策を試して情報漏えいのリスクを減らしましょう。

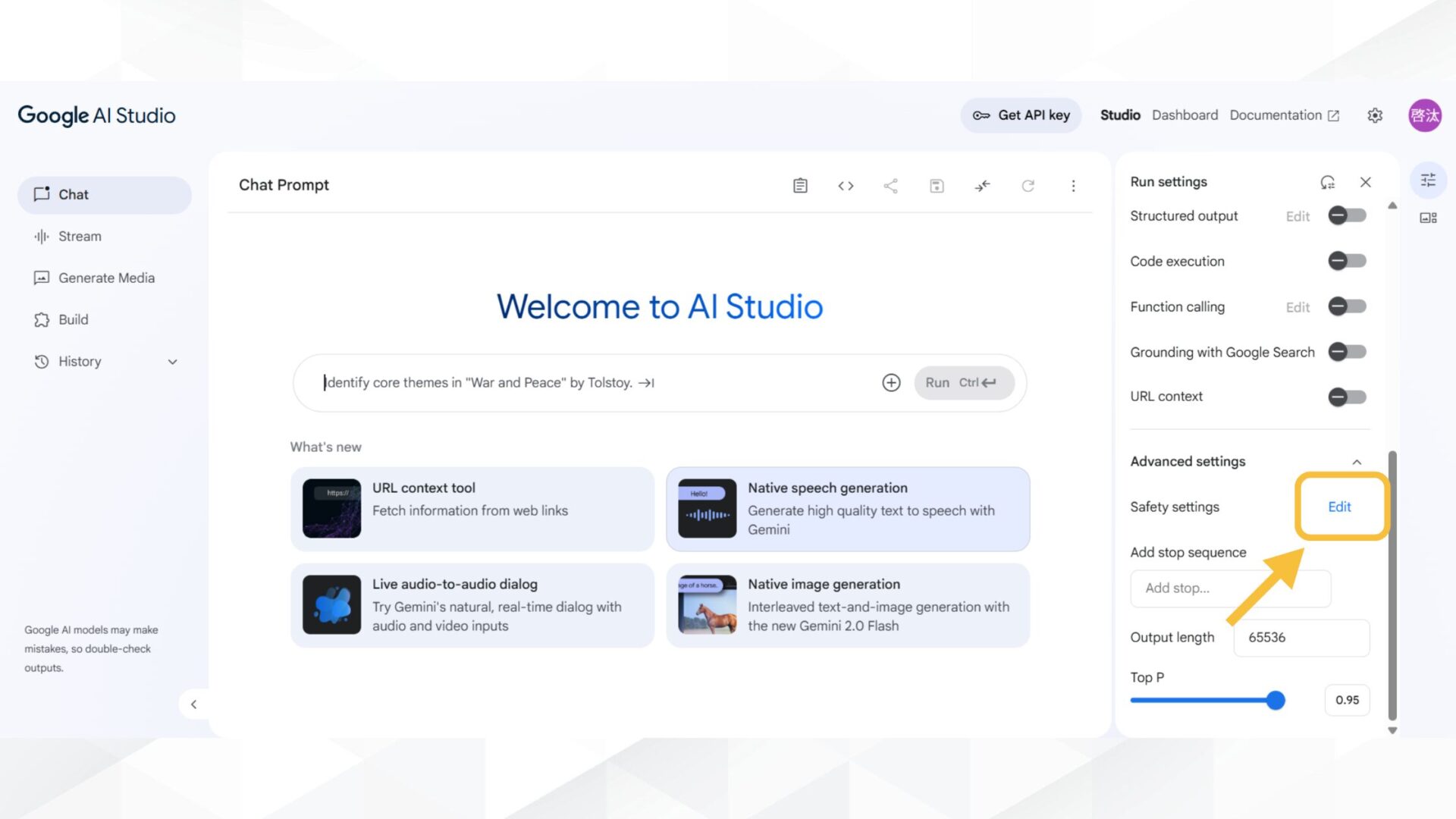

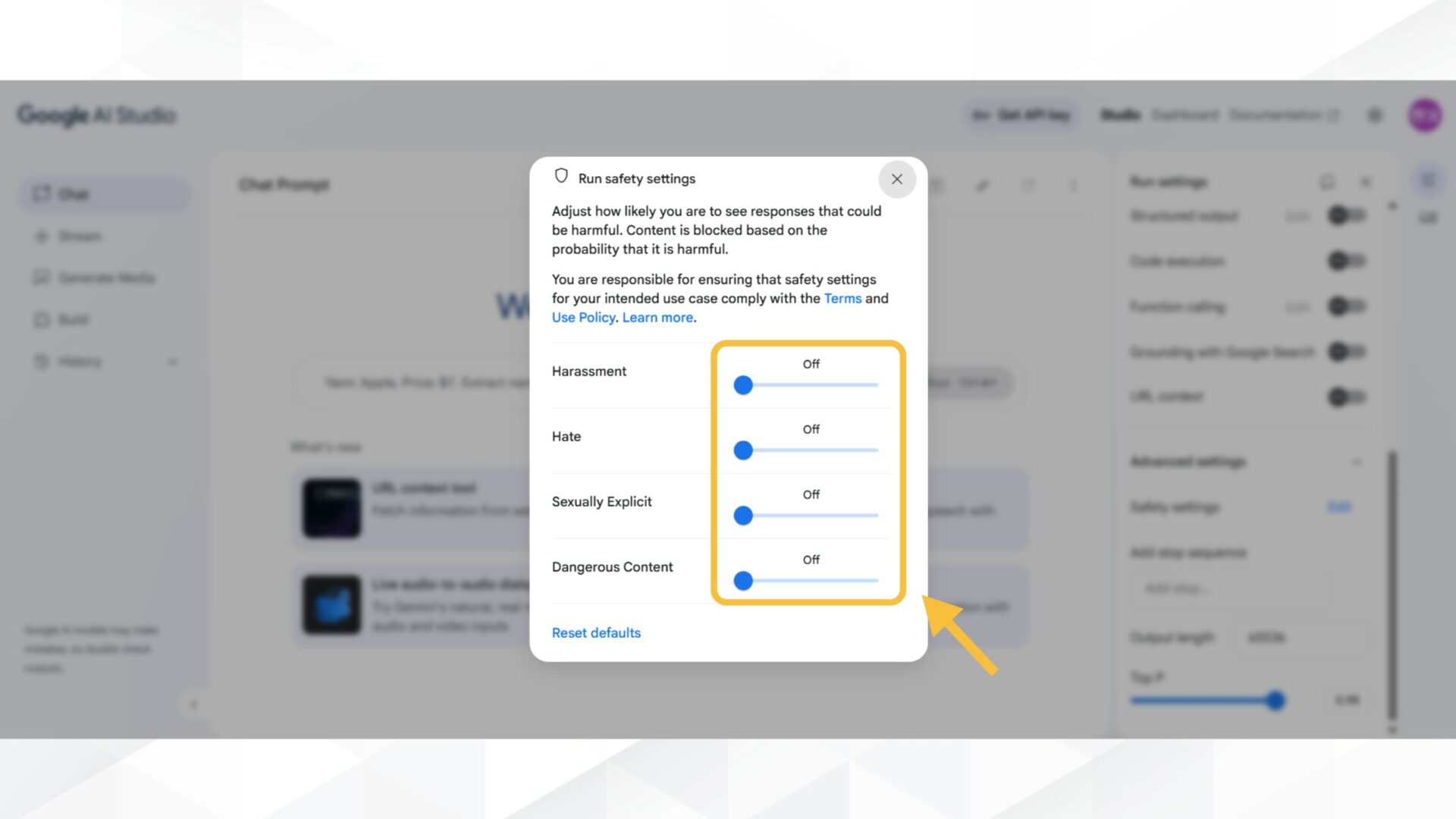

安全設定を有効にする

Google AI Studioでは、安全設定を有効にすれば、暴力や差別、ハラスメントなど不適切な出力を防げます。

設定によっては入力した内容がGoogleのAIモデル改善に使われたり、自動的にクラウドに保存されたりする場合があります。

とくに業務データや個人情報を扱う際は、不用意なデータ提供や情報漏えいのリスクを避ける対策が必要です。以下の手順で、安全設定を有効にできます。

- 「Safety settings」の右にある「Edit」を選択する

- 各項目のブロックレベルを調整する

「Safety settings」の右にある「Edit」を選択する

「Run settings」から下にスクロールして「Advanced settings」を表示し「Safety settings」の右にある「Edit」を選択します。

各項目のブロックレベルを調整する

「Safety settings」で各カテゴリのブロックレベルを「Off」「Block none」「Block few」「Block some」「Block most」から選べます。

- Off:ブロック機能が無効になり、すべての出力が表示されます。

- Block none:すべての出力を許可し、AIによる自動ブロックは行いません。

- Block few:明確に不適切と判断された内容のみをブロックします。

- Block some:中程度から高リスクの不適切な出力を自動でブロックします。

- Block most:少しでも不適切な可能性がある内容はすべてブロックします。

安全設定を有効にして、意図せぬデータ収集や情報漏えいのリスクを減らしましょう。

プロンプト内容を精査する

来歴不明の長文やWebファイルは、送信前に不審な命令が含まれていないかを確認する必要があります。

不正な命令文が紛れていると、AIが意図しない動作をするリスクがあるためです。

実際に、Webからコピーした文章に隠された命令が含まれていたことで、AIが内部情報を誤って出力した事例があります。

出典:Here Come the AI Worms(WIRED)

プロンプトやファイルの中身を事前に確認して、情報漏えいやAIの誤動作といった重大なトラブルを防ぎましょう。

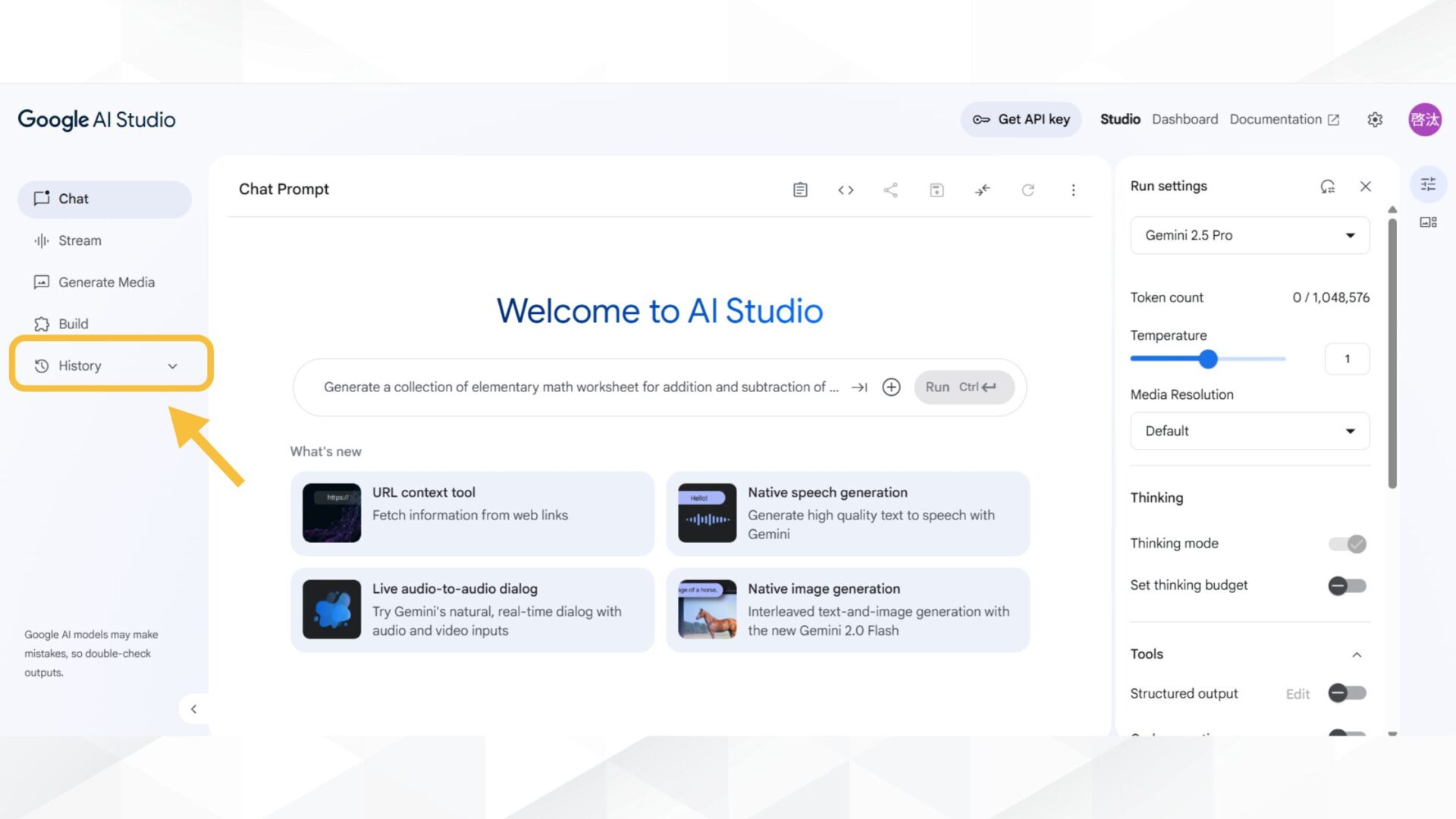

定期的にログをチェックする

Google AI Studioの画面から、プロンプト履歴やAPIアクセスの状況を定期的に確認する必要があります。

意図しない情報漏えいや第三者の不正利用に気づくには、日々の利用ログの見直しが唯一の手がかりになる場合が多いためです。以下の方法で、ログを確認できます。

- 左メニューの「History(履歴)」を選択する

- 不要な会話を削除する

左メニューの「History(履歴)」を選択する

Google AI Studio画面の左側にあるメニューから「History」を選択し、過去のプロンプト履歴やファイル一覧にアクセスします。

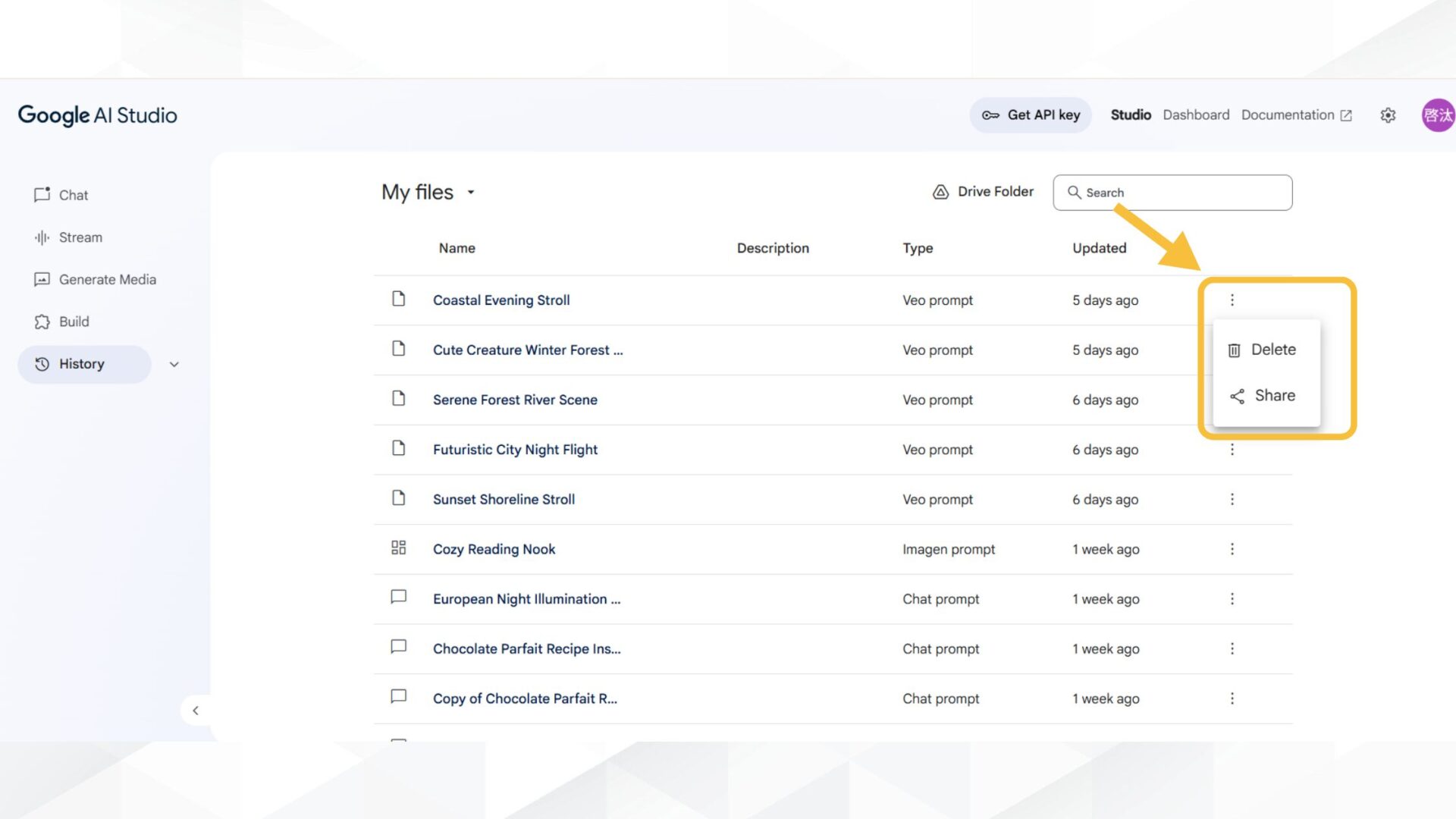

不要な会話を削除する

利用履歴の中から不要なファイルやプロンプトを見つけて、右側の「︙(メニュー)」から削除を行います。

チャット履歴やファイル一覧を月1回でもチェックし、「残すべきか・消すべきか」を見直す習慣をつけましょう。

Google AI Studioのセキュリティリスクと対策を把握し、安全な利用を

Google AI Studioは便利なAIプラットフォームですが、セキュリティリスクを正しく理解し、事前に対策する必要があります。

とくに「入力内容がGoogleに学習利用されるリスク」や「AIが不正な指示に従って情報を漏らす可能性」は、実際に業務で使う人ほど意識しておくべきポイントです。

本記事で紹介した対策を参考に、必要な設定や確認を忘れずに行い、安全にGoogle AI Studioを使いこなしていきましょう。

「Geminiでもっと仕事を効率化させたい」「Geminiで具体的にどんなことができるのか知りたい」という方に向けて、この記事では「【2026年最新版】Gemini大全」を用意しています。

この資料では、Geminiの基本的な使い方や今話題のNano Bananaの使い方、Geminiで使える便利機能などを徹底解説しています。

無料で受け取れますが、期間限定で予告なく配布を終了することがありますので、今のうちに受け取ってGeminiをマスターしましょう!

30秒で簡単受取!

無料で今すぐもらう執筆者

西啓汰

大学での学びと並行して活動するフリーランスのSEO/Webライター。

研究テーマは「Music to Video」。音楽の歌詞や曲調を分析し、自動で映像を生成する仕組みの開発中。

生成AIツールを実際に触れ、体験を通じて得た知見を活かし、価値を届けるライティングを実践。

趣味は野球観戦とラジオ聴取。

30秒で簡単受取!

無料で今すぐもらう