NotebookLMは情報漏えいのリスクがある!事例や4つの対策方法まで解説

NotebookLMを使用する中で情報漏えいに関して不安を感じていませんか。

NotebookLMを使うときは資料をインターネット上に預けるため、情報漏えいのリスクがまったくないとは言い切れません。

本記事では、NotebookLMで起こりうる情報漏えいのリスクや実際に発生した生成AIの漏えい事例、対処法を詳しく解説します。

事前にリスクを理解して、誤って情報漏えいをするリスクを減らしましょう。

監修者

SHIFT AI代表 木内翔大

「NotebookLMでもっと仕事を効率化させたい」「NotebookLMは便利そうだけど何ができるかいまいちわからない」という方に向けて、この記事では「【2025年最新版】NotebookLM大全」を用意しています。

この資料では、NotebookLMの基本的な使い方や本記事では紹介していない応用的な活用法などを徹底解説しています。

無料で受け取れますが、期間限定で予告なく配布を終了することがありますので、今のうちに受け取ってNotebookLMをマスターしましょう!

目次

NotebookLMは情報漏えいのリスクがある!

NotebookLM自体は高度なセキュリティ対策を施していますが、利用方法によっては情報漏えいのリスクがあります。

クラウドサービスである以上、外部からの不正アクセスや利用者の操作ミスによってデータが流出する可能性はゼロではありません。

実際に、NotebookLMをテスト運用中に誤って顧客リストをアップロードしてしまい、レビュー過程で機密情報が外部に流出する事故も発生しています。

利用者側の操作ミスや設定の不備によって、意図せず情報が外部に漏れてしまう可能性もあるため、利用時には十分な注意が必要です。

NotebookLMの使い方に不安がある方やより安全に活用したいと考えている方は、以下の記事を参考にしてみてください。

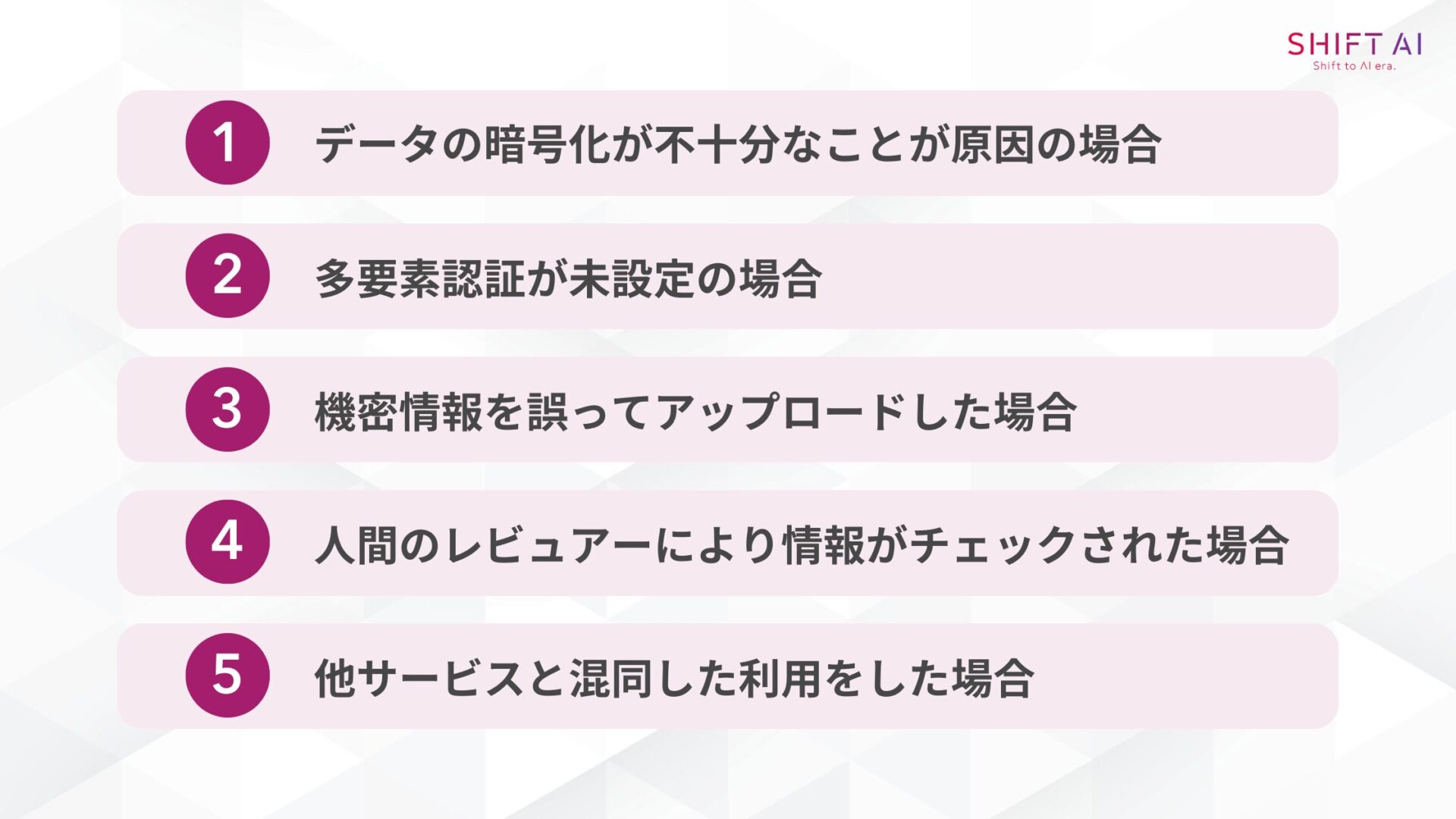

NotebookLMの情報漏えいリスクが起こる5つのケース

ここでは、NotebookLMを利用する際に情報漏えいが起こり得る5つのケースを紹介します。

いずれも、日常の業務の中でよく起こるケースです。NotebookLMを活用する前に、リスクをしっかり確認しておきましょう。

以下の記事では、NotebookLMを業務に活かす具体的な活用事例を18個紹介しています。「実際にどのように使えるのか知りたい」という方は、ぜひ参考にしてみてください。

データの暗号化が不十分なことが原因の場合

NotebookLMで扱うデータの暗号化が不十分だと、情報漏えいする可能性があります。

ネットワーク上を流れるデータが暗号化されていない場合、悪意ある第三者に盗聴・傍受され機密情報を読み取られるためです。

とくに、保存されたファイルが暗号化されていない状態で管理されている場合は、不正アクセスを受けたときに情報がそのまま抜き取られてしまいます。

データの暗号化に関するリスクを正しく理解しておくと、NotebookLMを安全に業務で活用できるでしょう。

多要素認証が未設定の場合

NotebookLMで多要素認証を設定していないと、アカウントを乗っ取られる可能性があります。

NotebookLMはGoogleアカウントを通じて利用するため、万が一パスワードが漏れてしまうと、他人があなたになりすましてログインし、ノートやチャット内容にアクセスできてしまうためです。

とくに、多要素認証が未設定のままだと、パスワード1つでログインできてしまうため、乗っ取りのリスクが高まります。

多要素認証を未設定にするリスクを理解しておくだけでも、情報漏えいのリスクは軽減できます。

機密情報を誤ってアップロードした場合

機密情報をNotebookLMに誤ってアップロードしてしまうと、情報漏えいに直結するリスクがあります。

インターネット上に一度アップロードしたデータは、自分の手元だけで完全に管理・削除をするのは難しいです。

たとえ削除操作をしても、サービスの仕様によってはバックアップやアクセスログにデータが一時的に残る可能性もあるためです。

とくに、顧客リストや技術資料などをうっかり読み込ませてしまうと、重大な漏えいにつながるおそれがあります。

迷った場合はアップロード前に社内ルールを確認することで、リスクを未然に防ぎましょう。

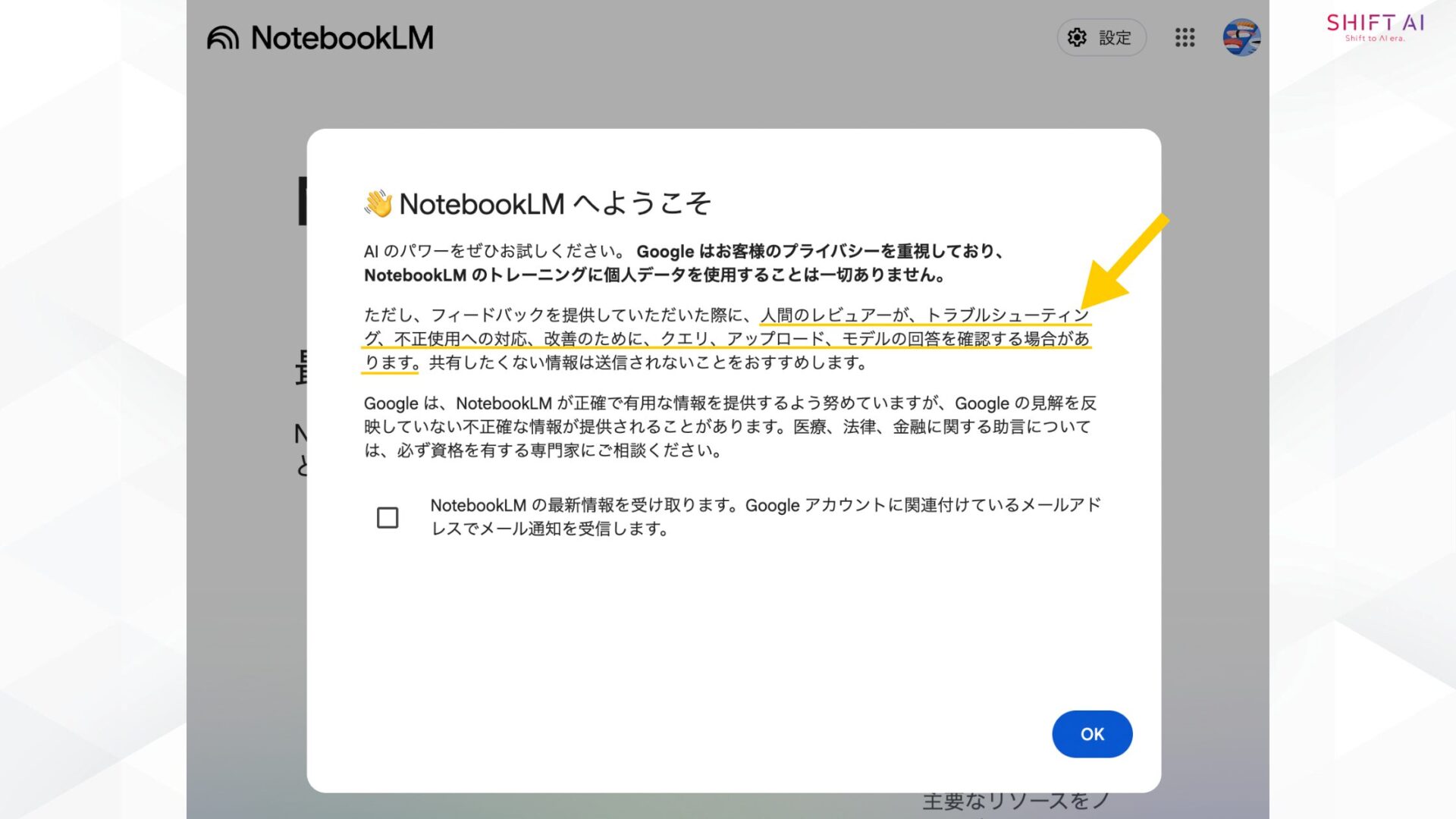

人間のレビュアーにより情報がチェックされた場合

NotebookLMでは、場合によって人間のレビュアーがデータを確認するため、その関与が情報漏えいのリスクにつながる可能性もあります。

機密情報をアップロードすると、レビュアーがその内容に触れる可能性があるためです。

アクセス権限の設定ミスや誤送信、他プロジェクトへの情報流用など、レビュアーの操作ミスが起きる可能性はゼロではありません。

NotebookLMを利用する前に、社外秘や個人情報を含むデータがないかを必ず確認し、取り扱いに細心の注意を払いましょう。

他サービスと混同した利用をした場合

NotebookLMを他のサービスと混同して使ってしまうと、意図せず大事な情報を共有してしまうリスクがあります。

Googleドライブや個人用のAIメモアプリと操作感が似ており、アカウントや用途を取り違えやすいためです。

プライベートのGoogleアカウントでNotebookLMを開いたまま業務用ファイルをアップロードすると、社外に情報が漏れる可能性があります。

NotebookLMを使う前には「今どのアカウントで、どのサービスを使っているか」を確認する習慣をつけましょう。

「NotebookLMでもっと仕事を効率化させたい」「NotebookLMは便利そうだけど何ができるかいまいちわからない」という方に向けて、この記事では「【2025年最新版】NotebookLM大全」を用意しています。

この資料では、NotebookLMの基本的な使い方や本記事では紹介していない応用的な活用法などを徹底解説しています。

無料で受け取れますが、期間限定で予告なく配布を終了することがありますので、今のうちに受け取ってNotebookLMをマスターしましょう!

30秒で簡単受取!

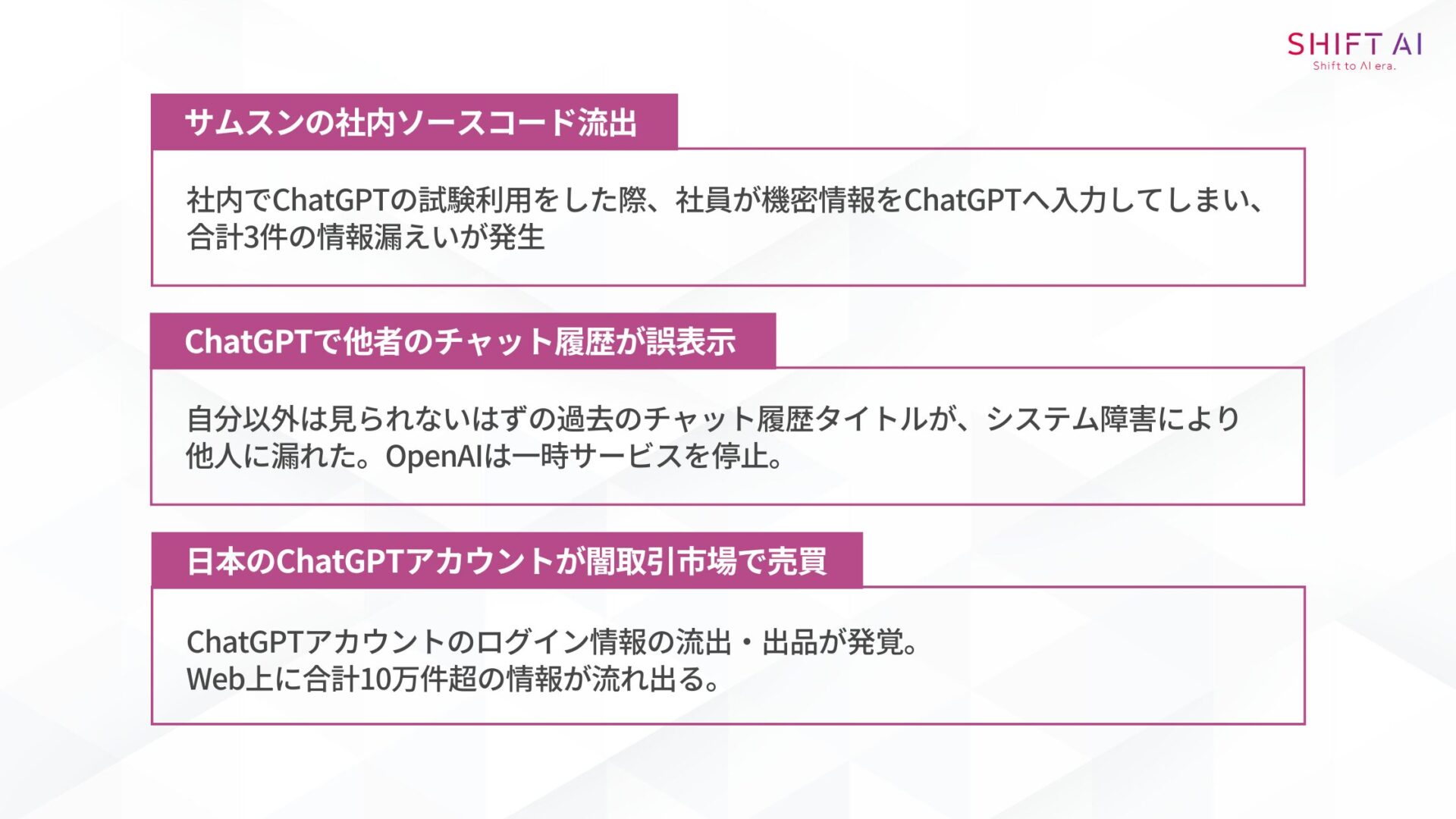

無料で今すぐもらう生成AIから情報漏えいが起きた3つの事例

ここでは、生成AIで実際に発生した情報漏えいの事例を3つ紹介します。

3つの事例を通して、情報が漏えいするとどのような問題が起こるのかを確認していきましょう。

サムスンの社内ソースコード流出

は2023年3月、大手企業サムスン電子で、社内機密情報がChatGPTに入力されたことによる漏えい事件が発生しました。

社内でChatGPTの試験利用を許可したところ、わずか20日間の間に社員が機密のソースコードや会議の記録をChatGPTへ入力してしまい、合計3件の情報漏えい事案が確認されたのです。

ChatGPTでは入力データが学習用に蓄積され、他の利用者への回答に利用される可能性があります。

たとえ有名企業でも従業員のちょっとした油断で情報漏えいが起こり得るため、機密情報を安易に外部AIへ入力しないようにしましょう。

ChatGPTで他者のチャット履歴が誤表示

ChatGPTのバグにより、利用者の履歴データが他の利用者から見えてしまう事故も発生しています。

2023年3月20日頃、ChatGPTのサービス上で一部利用者に他人のチャット履歴タイトルが表示されてしまう不具合が起きました。

本来自分以外は見られないはずの過去の会話タイトルが、システム障害により他人に漏れてしまったのです。

OpenAI社はこの深刻な事態を受けてChatGPTサービスを一時停止し、問題の修正に当たりました。

利用者側に落ち度がなくても、システムの不具合によってプライバシー情報が漏えいするリスクがある可能性を示した事例です。

定期的に提供元からのセキュリティアップデート情報を確認し、不具合が報告された際は重要データの利用を控えるなど慎重に対応しましょう。

日本のChatGPTアカウントが闇取引市場で売買

ChatGPTのアカウント情報が何者かに盗まれ、闇市場で売買されていた事例も確認されています。

シンガポールのセキュリティ企業Group-IBの調査によると、2021~2023年にかけて合計10万件超のChatGPTアカウントのログイン情報がWeb上に流出・出品されていました。

うち少なくとも661件が日本からの情報漏えいでした。

参照:日経ビジネス

盗まれたChatGPTアカウントに第三者が不正ログインできてしまうと、アカウントで過去にやり取りした会話履歴をすべて閲覧できます。

どんなにAI側のセキュリティが強固でも、利用者のIDやパスワードが流出すれば情報は筒抜けになるため、日頃から不審なログインがないか監視するなどの基本を徹底しましょう。

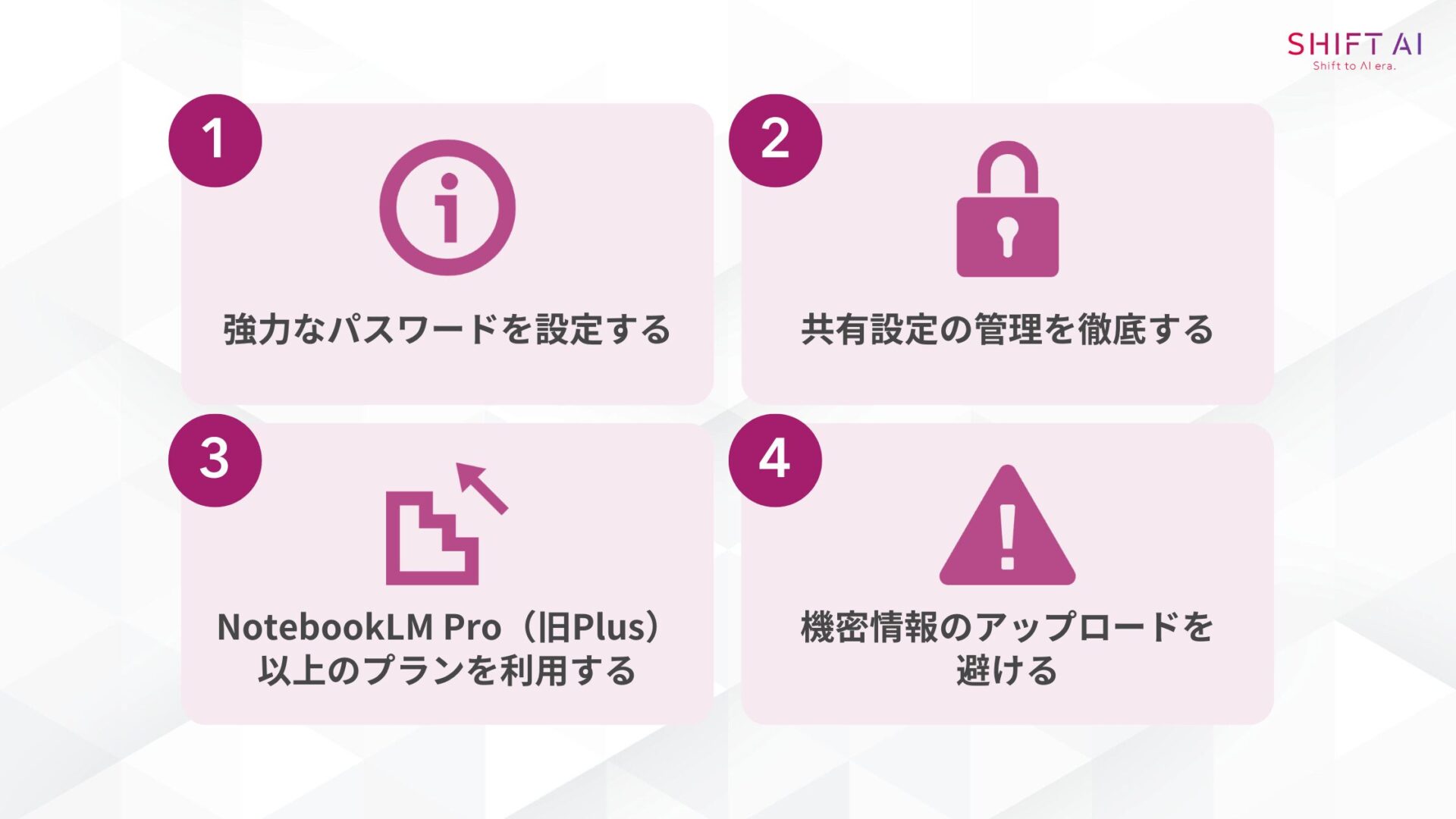

NotebookLMで情報漏えいをしないための4つの対策法

ここでは、NotebookLMで情報漏えいをしないために4つの対策法を紹介します。

NotebookLMを使い始める前に、対策を確認しておきましょう。

強力なパスワードを設定する

NotebookLMはGoogleアカウントで利用するため、アカウントが乗っ取られると、ノートブック内のすべての情報にアクセスされるリスクがあります。

そのため、Googleアカウントには推測されにくい強力なパスワードの設定が重要です。

以下のような方法でパスワードを強力にできます。

- パスワードマネージャーを活用する

- 二段階認証をオンにしておく

定期的なパスワード変更も有効ですが、使い回しの防止と強度確保の方がより重要です。まずは今一度、自分のアカウントのパスワード強度を見直してみましょう。

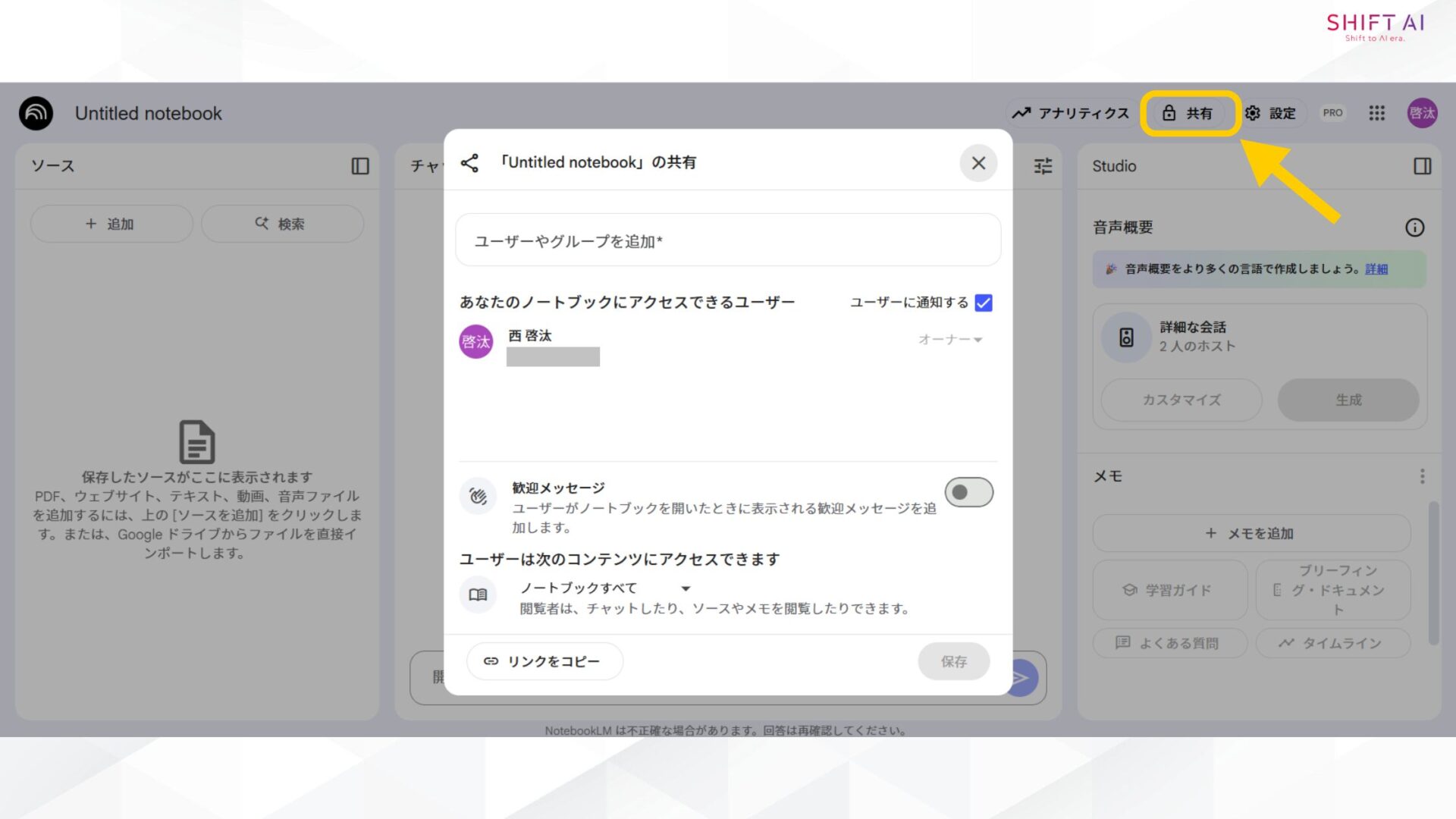

共有設定の管理を徹底する

NotebookLMではチームメンバーとノートを共有し共同編集する機能がありますが、共有する際は誰にどこまで権限を与えるか慎重に設定する必要があります。

共有相手が本当に必要な範囲の権限だけを付与し、機密性の高いノートは共有自体を極力避けるのが重要です。

万が一誤って社外に共有リンクを発行してしまうと、リンク経由で第三者に見られる可能性もあります。右上の「共有」から共有相手を確認できます。

初期設定は非公開にし、共有は本当に必要な相手だけに限定しましょう。

NotebookLM Pro(旧Plus)以上のプランを利用する

無償版でも基本的な機能は使えますが、情報漏えいのリスクを下げたい場合は、Pro(旧Plus)版以上の有料プランを選ぶべきです。

2024年にプラン名称が変更され、従来の「NotebookLM Plus」は現在「NotebookLM Pro」として提供されています。

Pro版では、データの暗号化やアクセス制御が強化されており、人間のレビュアーによるデータ確認も原則として行われません。

また、データはGoogle Cloudプロジェクト内で管理され、企業向けの高度な管理機能やコンプライアンス対応も備えています。

社内機密や個人情報を含むノートを扱う場合は、セキュリティの手厚い上位プランを選べば、ヒューマンエラーや不正アクセスのリスクを大幅に減らせるでしょう。

機密情報のアップロードを避ける

NotebookLMを使う際は、機密情報のアップロードを避ける必要があります。。

NotebookLMはインターネット上にデータを保存する仕組みのため、サーバー障害や人為的ミスによる漏えいリスクがゼロではありません。

たとえば、以下のような情報はアップロードを避けるべきです。

- 社外秘の業務資料

- 顧客や社員の個人情報

- 契約書や財務情報、会議資料などの重要文書

機密情報はローカル環境で管理すれば、万が一の漏えいを防ぎ、NotebookLMを安心して活用できます。

NotebookLMの情報漏えいリスクを考慮した運用を検討しよう

NotebookLMは、使い方次第で業務効率を大きく高められる便利なAIツールです。ただし、クラウドにデータを保存する以上、情報漏えいのリスクを完全にゼロにはできません。

本記事で紹介したように、リスクを正しく理解し、対策法を実践すれば、情報漏えいのリスクを大きく軽減できます。

まずは、紹介した4つの対処法を試してセキュリティ対策を始めましょう。

「NotebookLMでもっと仕事を効率化させたい」「NotebookLMは便利そうだけど何ができるかいまいちわからない」という方に向けて、この記事では「【2025年最新版】NotebookLM大全」を用意しています。

この資料では、NotebookLMの基本的な使い方や本記事では紹介していない応用的な活用法などを徹底解説しています。

無料で受け取れますが、期間限定で予告なく配布を終了することがありますので、今のうちに受け取ってNotebookLMをマスターしましょう!

30秒で簡単受取!

無料で今すぐもらう執筆者

西啓汰

大学での学びと並行して活動するフリーランスのSEO/Webライター。

研究テーマは「Music to Video」。音楽の歌詞や曲調を分析し、自動で映像を生成する仕組みの開発中。

生成AIツールを実際に触れ、体験を通じて得た知見を活かし、価値を届けるライティングを実践。

趣味は野球観戦とラジオ聴取。

30秒で簡単受取!

無料で今すぐもらう